por Luis Enrique Alcalá | Ago 7, 2006 | Física, Otros temas |

La exploración cada vez más penetrante del átomo. El neutrón de Chadwick. El creciente zoológico de partículas subatómicas. La noción de antipartícula. La fisión del uranio y la energía atómica. Lise Meitner y Enrico Fermi. El Proyecto Manhattan.

Kenneth Ford, quien presidiera el American Institute of Physics, acuñó la expresión zoológico de partículas para referirse al creciente número de “corpúsculos” más pequeños que un átomo. Escribiendo en la década de los sesenta, tenía noticia de los cientos de partículas producidas artificialmente en descomunales laboratorios conocidos como aceleradores de partículas. Luego de los experimentos iniciales en el mundo subatómico—debidos a Rutherford—en los que partículas producidas espontáneamente por radioactividad (proyectiles) “bombardeaban” un “blanco” material, la tecnología fue incorporando aceleradores artificialmente construidos de potencia cada vez mayor[1]. Al inicio, sin embargo, todo parecía ser relativamente simple, cuando se creía que las partículas subatómicas eran solamente tres: el protón y el electrón, ambos con carga eléctrica unitaria, y el neutrón, que como su nombre indica, no porta carga eléctrica. El protón y el neutrón habitaban el núcleo del átomo, de cuya masa son mayormente responsables, mientras que el electrón se encontraba en la corona circundante, aportando prácticamente nada a la masa atómica. (La masa de un protón equivale a la de 1.836 electrones. En términos prácticos, la masa de un átomo resulta de sumar el número de protones y el de neutrones contenidos en su núcleo, mientras que el “número atómico” corresponde al número de protones o su carga positiva total. En un átomo neutro, no un ión, el número de protones y el de electrones son idénticos).

La primera de las partículas descubiertas fue el electrón, por J. J. Thomson en sus experimentos de 1897, identificándolo como el constituyente elemental de lo que su discípulo, Ernest Rutherford, denominaría “radiación beta”, una de las tres formas de emanación presente en las sustancias radioactivas. Su existencia había sido predicha por G. Johnstone Stoney (1874) a partir de sus trabajos en electroquímica. (Electrólisis, electrodeposición, etc.)

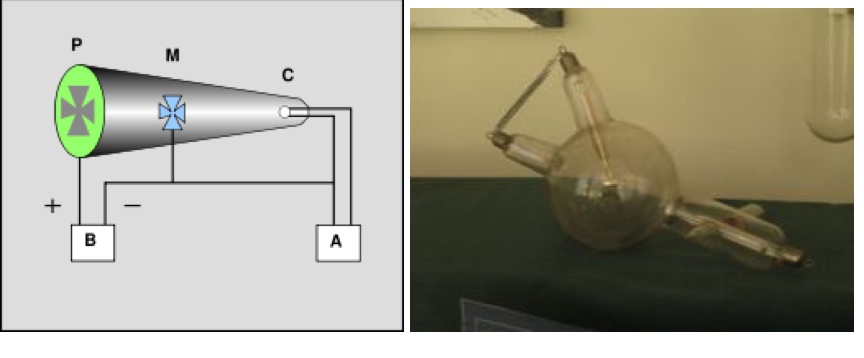

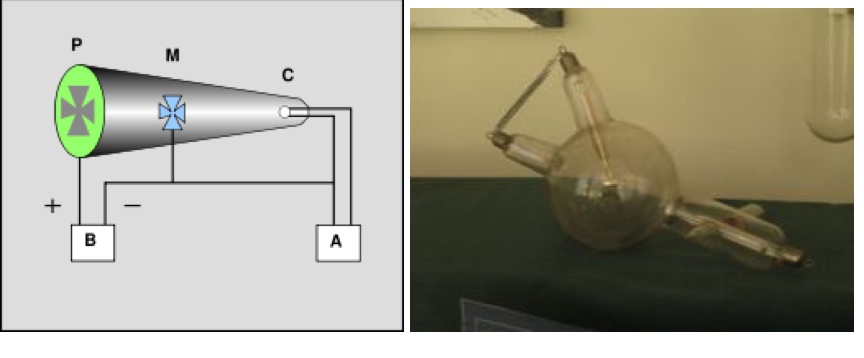

William Crookes proveyó el aparato que conduciría al descubrimiento del electrón: el “tubo de Crookes” o tubo de rayos catódicos. En esencia es un receptáculo “cónico” de vidrio al que se ha hecho el vacío y se le ha dotado de tres electrodos: un ánodo y dos cátodos. La superficie del ánodo se reviste con una sustancia fosforescente. (Usualmente, fósforo).

Representación esquemática y fotografía de un tubo de Crookes.

Entre el ánodo y el cátodo principal se ubica una “máscara de sombra” conectado a éste, con una forma particular. (Típicamente una cruz de Malta). Los “rayos catódicos” (radiación proveniente del cátodo) excitan el fósforo del ánodo, que brilla salvo en el área proyectada por la sombra.[2]

Fueron estos rayos catódicos los que Thomson estudió. Además de establecer su desviación por causa de campos eléctricos y magnéticos (lo que era característico de partículas con carga eléctrica), Thomson calculó la proporción de carga sobre la masa de estos “corpúsculos”, llegando a la conclusión de que esa relación era más de mil veces la de un ión de hidrógeno. De estos resultados pudo entonces Thomson “descubrir” (deducir) la existencia del electrón, que debía venir del interior del átomo. El revolucionario hallazgo le valió el Premio Nóbel de Física en 1906.

Trece años separarían este descubrimiento de la postulación de la segunda partícula subatómica, mucho más masiva que el electrón pero de igual carga eléctrica. A esta partícula se le daría el nombre de protón, y el honor de su descubrimiento correspondería en 1919—el año de la confirmación astronómica de la teoría general de la relatividad—a Rutherford, el alumno de Thomson.

Antes del hallazgo Eugen Goldstein había teorizado, a partir de las conclusiones de Thomson, que siendo los átomos eléctricamente neutros debían existir en su seno partículas cargadas positivamente que compensaran o anularan las cargas negativas de los electrones. De hecho, inició la cacería del protón sin conseguirlo. (Obtuvo partículas de carga positiva dentro de un tubo de Crookes modificado, pero midió masas variables para las mismas al cambiar los gases del aparato. Eran iones y no protones lo que había observado). El testigo pasó a manos de Rutherford.

Primeramente, el neozelandés adjudicó los nombres de radiaciones alfa, beta y gamma a las tres emisiones del uranio. Luego postuló que la radiación alfa, formada por partículas de carga positiva, estaba compuesta, en realidad, por núcleos de átomos de helio. (1899).

Entra entonces en la escena la “cámara de niebla” inventada por Charles Wilson en 1912, que permitió refinar las observaciones del electrón. Consiste de una cámara llena de vapor de agua por la que se hace pasar radiación. Cuando las partículas poseen carga eléctrica inducen a su paso la ionización y condensación de las moléculas de vapor, lo que deja una estela visualmente discernible.[3]

La cámara de niebla de Wilson de 1912

Rutherford había observado (1918) que al bombardear nitrógeno con partículas alfa sus detectores de centelleo[4] parecían indicar la presencia de iones de hidrógeno, y concluyó que éstos sólo podían provenir del nitrógeno. En consecuencia, aventuró la hipótesis de que el nitrógeno debía “contener” núcleos de hidrógeno. Esta interacción de partículas alfa con el nitrógeno fue también observada en una cámara de niebla, la que registró bifurcaciones que a veces invertían completamente la dirección de una partícula alfa incidente. Al comprobar que estos trazos invertidos correspondían a la huella que dejarían iones de hidrógeno, y que en el interior del receptáculo de nitrógeno había ahora oxígeno (una transmutación como la que habían soñado los alquimistas), Rutherford propuso (1919) que el núcleo de hidrógeno estaba constituido por una sola partícula subatómica de carga eléctrica equivalente a la del electrón: el protón.

Razonamientos ulteriores llevaron a Rutherford a conjeturar la existencia de otra partícula subatómica que sería eléctricamente neutra y de masa equivalente a la del protón para explicar las características de la partícula alfa, que poseía dos cargas eléctricas unitarias pero tenía una masa cuatro veces la del protón. Este “neutrón” tendría que esperar su comprobación experimental por parte de otro físico inglés[5], James Chadwick, en 1932.

Ya en 1930 se sabía que el bombardeo de ciertos elementos livianos (litio, boro, berilio) con partículas alfa daba lugar a una radiación muy penetrante. Al principio se pensó que se trataba de rayos gama (radiación electromagnética pura, fotones de alta energía), pero experimentos realizados por los Joliot-Curie (1932) mostraron que la incidencia de partículas alfa sobre sustancias con alta proporción de hidrógeno (parafina, por ejemplo), desataba la emisión de protones muy energéticos que no podía ser explicada como radiación gama. En este mismo año Chadwick hizo los experimentos definitivos. En mayo de 1932 envió para su publicación “La existencia de un neutrón” a Proceedings of the Royal Society, artículo en el que se refirió a los experimentos de los Joliot-Curie y los anteriores de Bothe y Becker. Allí dice Chadwick: “Es evidente que debemos, o abandonar la aplicación de la conservación de la energía y el momento en estas colisiones, o adoptar otra hipótesis acerca de la naturaleza de la radiación. Si suponemos que la radiación no es una radiación cuántica, sino que consiste de partículas de masa muy cercana a la del protón, desaparecen todas las dificultades asociadas con las colisiones, tanto respecto a su frecuencia como a la transferencia de energía a diferentes masas. A fin de explicar el gran poder de penetración de la radiación debemos además suponer que la partícula no tiene carga neta. Podemos suponerla consistente de un protón y un electrón en íntima combinación, el ‘neutrón’ discutido por Rutherford en su clase bakeriana[6] de 1920”. El Premio Nóbel de Física en 1935 fue concedido a Chadwick.

A estas alturas el submundo atómico parecía perfectamente organizado y explicado completamente. Protón, neutrón y electrón bastaban para justificar tanto la masa atómica como la distribución de cargas eléctricas del átomo, su “peso” y su “número” atómico[7]. No pasaría mucho tiempo antes de que razones teóricas y experimentales dieran cuenta de numerosas otras partículas subatómicas.

Sir Joseph John Thomson - Lord Rutherford - Sir James Chadwick: los explicadores del átomo

Como en el caso de la predicción del neutrón por parte de Rutherford, el próximo paso se dio asimismo en el reino de la teoría. Antes de que esta última partícula fuera descubierta ya P. A. M. Dirac había postulado la existencia de “antimateria”.

El primer aporte de Dirac (1927) consistió en adelantar una teoría relativista del electrón que tuvo éxito, entre otras cosas, al explicar el espín[8] del electrón. La teoría también anunciaba la existencia de “estados de energía negativa”. Para explicarlos Dirac echó mano del “principio de exclusión” de Pauli, que prohibía que dos electrones ocuparan el mismo estado—que tuvieran exactamente los mismos números cuánticos—en un átomo cualquiera. De aquí conjeturó (1930) que in vacuo los estados de energía negativa predichos por su teoría estarían ocupados por electrones, cuya remoción dejaría un “hueco” que Dirac mostró se comportaría como un electrón de carga positiva. En 1931 adujo que estos holes corresponderían a una nueva partícula positiva.

Al año siguiente Carl D. Anderson encontró la “firma” del electrón de carga positiva (positrón) en placas tomadas de una cámara de Wilson dispuesta en el Instituto Tecnológico de California (Caltech), de modo que detectara la influencia de rayos cósmicos (radiación gama de alta energía proveniente del espacio exterior a la Tierra). Las trayectorias descritas por la nueva partícula eran la imagen especular de las observadas para el electrón. Por cierto, el electrón y el positrón son creados en pareja por un rayo gama, y el proceso inverso, la aniquilación de ambas partículas por colisión directa de ambas, produce radiación gama.

Formación de un par electrón-positrón en una cámara de burbujas. Las livianas partículas describen espirales de dirección inversa en el campo magnético de la cámara.

Pero todavía la década del treinta alojaría otra sorpresa. Una vez más la teoría se adelantó a los experimentadores. En 1934 Hideki Yukawa predijo la existencia de partículas de masa intermedia ante el protón y el electrón, a las que se llamó mesones. La teoría de Yukawa buscaba explicar las fuerzas que mantienen el núcleo como una entidad integrada a pesar de que la electrostática exige que cargas eléctricas del mismo signo, como los protones, tiendan a repelerse. (La física actual interpreta interacciones como la electromagnética en términos de un intercambio de partículas. En el caso del electromagnetismo la partícula intercambiada es el fotón, que no posee masa. En el seno del núcleo se requiere una fuerza que pueda vencer la repulsión electrostática a distancias muy cortas, y esto fue lo que Yukawa proveyó con su teoría, al postular que las partículas del intercambio nuclear tienen masa mayor que cero, mayor que la del electrón, pero menor que la del protón o neutrón).

En 1937 Neddermeyer, Anderson, Street y Stevenson identificaron una nueva partícula de masa intermedia a la que se llamó muón (o mesón mu), otra vez en experimentos con rayos cósmicos en una cámara de Wilson. Equivocadamente se pensó que se trataba del mesón predicho por Yukawa, pero pronto se comprobó que los muones no participaban en las interacciones nucleares. El mesón pi, o pión, correspondiente a la partícula de Yukawa, fue descubierto diez años más tarde por Cecil Powell.

A partir de aquí el zoológico de partículas comenzó a poblarse de modo alarmante. El kaón o mesón K (1947), el antiprotón (de masa igual a la del protón y carga negativa, 1955), el neutrino (1956; predicho por Wolfgang Pauli en 1931, sin carga neta y masa cero; más exactamente el neutrino del electrón), el neutrino del muón (1962), la partícula J/ y (1974), la partícula tau (1975), la partícula upsilon (1977), el gluón (1979), los bosones[9] W y Z (1983, predichos veinte años antes por Glashow, Salam y Weinberg), el top quark[10] (1995), el neutrino tau (2000), aparecieron uno tras otro[11]. Para complicar más las cosas, hay partículas como los piones que vienen con carga positiva, negativa o neutra, y además cada una de las partículas tiene su respectiva “antipartícula”.

………

Entretanto proliferaban las partículas subatómicas y se hacía evidente la necesidad de un esquema simple que las organizara, la tecnología procedía en dirección de la energía nuclear útil, montada sobre la postulación de Einstein de que la masa de un cuerpo cualquiera podía ser transformada íntegramente en energía o, puesto de otro modo, que la masa y la energía eran entidades equivalentes, una sola y misma cosa.

Arthur Eddington opinó una vez que la mente humana tardó tanto tiempo para descubrir esta equivalencia entre masa y energía a causa de una diferencia particular de nuestros sentidos corporales. En efecto, la retina es capaz de captar el efecto generado por un solo fotón, que es una cantidad pequeñísima de energía. En cambio, el sentido del tacto, misericordiosamente, no es capaz de detectar presiones por debajo de algunos decigramos. Si no fuese por este hecho, la conciencia cerebral se vería abrumada por las señales provenientes de billones de partículas subatómicas que constantemente bombardean nuestra piel.

En todo caso, a partir de los hallazgos “alquimistas” de Rutherford, y sobre todo luego del descubrimiento del neutrón, en la década de los treinta comenzó una carrera por lograr elementos sintéticos de masa superior a la del uranio. La búsqueda teórica no imaginaba adonde conduciría la experimentación. Los competidores de esta carrera por un posible Premio Nóbel eran el propio Rutherford, Enrico Fermi, los Joliot-Curie y el equipo formado por Otto Hahn y Lise Meitner. Fue esta mujer austriaca la que concebiría en 1938 la “fisión” nuclear, mediante el bombardeo de núcleos de uranio con neutrones. Los experimentos se realizaron en el laboratorio de Hahn en Berlín, pero la explicación de los resultados fue proporcionada por Meitner, por ese entonces en Estocolmo en razón de ser judía. (Las piezas de la correspondencia entre Meitner y Hahn indican a las claras que éste no creía en la fisión nuclear y debió ser convencido por los razonamientos de ella). La era atómica había comenzado.

En la fisión del núcleo de uranio, un átomo de este elemento se divide para dar lugar a dos pedazos—un núcleo de bario y uno de kriptón—algunos neutrones y rayos gama[12]. Lise Meitner se dio cuenta de que a partir de un neutrón incidente sobre el núcleo de uranio se había obtenido varios neutrones, y que tal cosa podía en principio establecer una “reacción en cadena”: los nuevos neutrones impactarían otros núcleos de uranio para producir más neutrones y así sucesivamente. Esta característica de la fisión del uranio permitió el diseño de “reactores nucleares”—el primero en Chicago por Enrico Fermi y Leó Szílard en 1942—de reacción “controlada” y las bombas atómicas detonadas en 1945 como consecuencia del Proyecto Manhattan. (Alamogordo, Hiroshima, Nagasaki). LEA

Diagrama trasladado de una fotografía de cámara de burbujas que muestra “eventos” de creación de varios pares electrón-positrón y la trayectoria de otras partículas.

[1] Se acredita a Ernest Lawrence la invención del ciclotrón, un acelerador de partículas que las hace girar en espiral mediante la aplicación de un campo magnético. Un aparato más primitivo, el acelerador de Van de Graaff, empleaba la acumulación de enormes cargas de electricidad estática para generar grandes diferencias de potencial o voltajes (hasta un millón de voltios). En física de partículas se emplea una unidad de energía: el electrón-voltio, que corresponde a la que adquiere un electrón acelerado por una diferencia de potencial de un voltio. El ciclotrón alcanza energías de hasta 10 millones de electrón-voltios. Los aceleradores modernos (“lineares” de hasta 3 kilómetros como el de Stanford) o circulares (como el LHC—Large Hadron Collider—de CERN, con una circunferencia de 46 kilómetros), llegan a generar energías de hasta 7 teraelectrón-voltios. (1 tera = 1012, o un billón castellano). Dos haces de partículas enfrentadas producirán (2007) colisiones de 14 TeV.

[2] El tubo de rayos catódicos es la tecnología básica de un osciloscopio, donde un delgado haz de electrones puede moverse bajo la acción de cargas electrostáticas, dibujando así con ondas sobre la pantalla fosforescente las variaciones de voltaje. De allí vinieron también los primitivos tubos de radio y, más adelante, las pantallas de los televisores. Un tubo de rayos X es un tubo de Crookes modificado, y el descubrimiento de esta penetrante radiación representó para Wilhelm Röentgen el primero de los premios Nóbel de Física de la historia. (1901).

[3] Es la misma razón de las estelas que forman los aviones a reacción en la atmósfera superior a su paso en vuelo. La cámara de Wilson ha sido suplantada por la más precisa “cámara de burbujas”. En ésta, un recipiente lleno de hidrógeno o propano en estado líquido es sometido a haces de partículas cargadas, las que esta vez producen un rosario de burbujas formadas por ebullición local

[4] Detectan pulsos de luz emitidos por ciertos materiales bajo el impacto de partículas cargadas o fotones.

[5] Debe haberse notado que en el reino de lo atómico los físicos alemanes (Planck, Einstein, Heisenberg, etc.) aportaban la teoría, pero los ingleses descollaban como experimentalistas.

[6] Nombrada por Henry Baker, quien legara a la Royal Society en 1775 la cantidad de £100 para la conferencia de un miembro que la sociedad escogiese. Es la más prestigiosa conferencia en ciencias físicas en Inglaterra.

[7] Una vez que surgiera el concepto de número atómico, la organización de los elementos en una tabla periódica pudo limar pequeñas asperezas. Anteriormente (Mendelejeff) se ordenaba a los elementos por su peso atómico, y en unos pocos casos—por ejemplo el par argón-potasio, del que el argón es más pesado pero hoy se coloca antes del segundo en la tabla—no cuadraban las propiedades químicas. La ordenación por número de protones (o electrones) restituyó la consistencia a la tabla.

[8] El espín (castellanización de spin, giro) de una partícula subatómica designa su “momento angular”, y es una propiedad o “número cuántico” que permite agrupar a las partículas en familias de propiedades similares.

[9] Los bosones son partículas de espín +1 o –1 y se comportan según fórmulas estadísticas desarrolladas por Bose y Einstein. Los fermiones, como el electrón y el protón, exhiben espín de +1/2 o –1/2, y siguen la estadística Fermi-Dirac.

[10] Hablaremos de los quarks en la octava lección.

[11] Para la década siguiente a la actual se espera, una vez que entren en operación nuevos y mayores hiperaceleradores de partículas, detectar el llamado bosón de Higgs.

[12] El uranio radioactivo empleado para la fisión como “combustible” tiene 235 unidades de masa atómica, mientras que el bario tiene 138 unidades y el kriptón 84, para un total de 222 unidades de masa atómica. La diferencia de 13 unidades es convertida en neutrones (usualmente tres) y radiación gama.

por Luis Enrique Alcalá | Ago 6, 2006 | Física, Otros temas |

El corrimiento hacia el rojo. Hubble y la expansión del universo. Primera postulación del Big Bang. La hipótesis alterna de la creación continua o el steady state.

Todos hemos tenido la experiencia de escuchar la sirena de una ambulancia que se aproxima y nos pasa, para alejarse en pos de algún enfermo o herido. El tono de la sirena es más agudo en la aproximación y más grave en el alejamiento. El fenómeno se explica porque la frecuencia del sonido es percibida como más alta si la fuente se mueve en nuestra dirección (delante del móvil), al amontonarse las ondas en un espacio menor que estaría siendo “comprimido”. A la inversa, este espacio se expande cuando la fuente sonora se aleja (detrás del móvil), y el observador percibe un descenso en la frecuencia hacia tonos más graves.

El efecto Doppler acústico

El fenómeno descrito se conoce con el nombre de “efecto Doppler”, por Christian Andreas Doppler, quien lo postuló en 1842. Aunque Doppler lo propuso para la luz, la primera comprobación experimental se hizo en 1845 con ondas sonoras por el meteorólogo y químico holandés Christian Buys Ballot, quien empleó un grupo de músicos en un tren de Ámsterdam a Utrecht para causar el efecto. (En 1848, el año del Manifiesto Comunista, y de manera independiente, Hyppolite Fizeau, quien haría las más exactas mediciones de la velocidad de la luz en su época, descubrió el efecto Doppler en ondas electromagnéticas, y los franceses lo llaman por esto el efecto Doppler-Fizeau).[1]

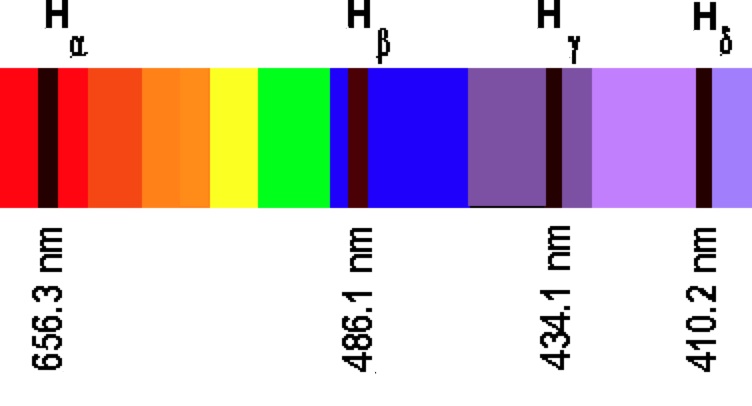

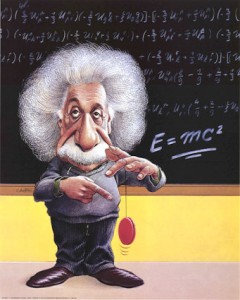

Estos descubrimientos tendrían, setenta años más tarde y en conjunto con los hallazgos de la espectroscopia química, una importancia enorme en el campo de la cosmología. En efecto, cada elemento químico absorbe luz en unas ciertas frecuencias específicas y propias, y este fenómeno se registra como líneas o bandas negras que interrumpen la gama de colores del espectro. Es decir, cada elemento químico pone su “huella digital” en el espectro que genera. Así, es posible determinar espectroscópicamente la composición química de un astro, a pesar de su distancia.

Espectro del hidrógeno. Sus líneas de absorción (a, b, g, d) aparecen en frecuencias específicas, correspondientes a longitudes de onda precisas expresadas acá en nanómetros. (1 nanómetro = 1/109 metros, o una mil millonésima de metro, que es lo mismo que lo que llamamos una milimicra). Mientras menor es la longitud de onda mayor es la frecuencia.

Para la época de la formulación de la teoría general de la relatividad (1916) varios astrónomos en Estados Unidos habían observado espectros de nebulosas y detectado en ellos un desplazamiento de las líneas de absorción espectrales en dirección al extremo del rojo. Campbell, Keeler y Slipher habían observado el fenómeno y derivado la conclusión correcta: las nebulosas eran fuentes luminosas en recesión o alejamiento y, tal como el sonido de la ambulancia, se percibía por tal razón un descenso en la frecuencia: las líneas espectrales se desplazaban hacia el rojo, la zona de menor frecuencia del espectro luminoso. Hasta ese entonces, no obstante, se pensaba que las nebulosas eran estructuras gaseosas constituyentes de nuestra propia galaxia, y los resultados no fueron interpretados en su significado pleno. En 1924, la noticia de que eran en realidad otras galaxias equivalentes a la nuestra, y por tanto estructuras mucho más lejanas, fue anunciada por el astrónomo (y abogado) Edwin Hubble, quien tuvo acceso al nuevo telescopio Hooker de 100 pulgadas del observatorio de Monte Wilson, en California.

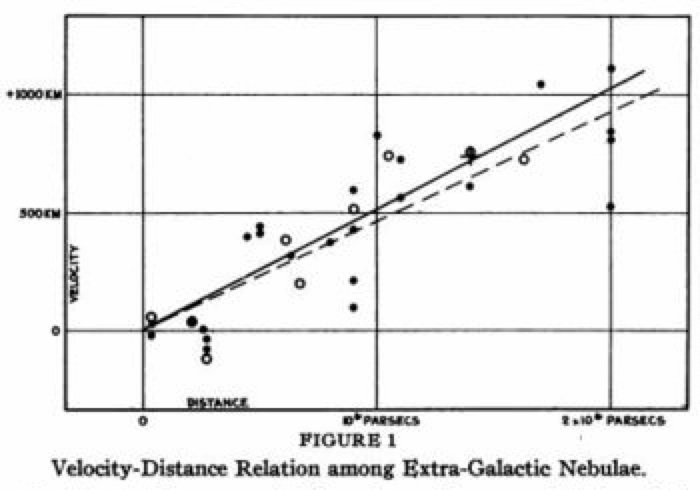

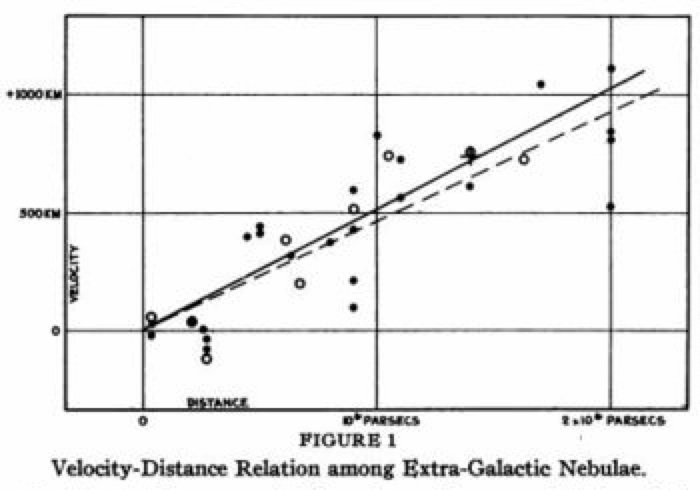

Luego, en equipo con Milton Humason, realizó mediciones de “corrimiento al rojo” de un grupo de galaxias, a las que incorporó las obtenidas por Slipher. Con estos datos Hubble y Humason encontraron una ley empírica que establecía que mientras más lejana era la galaxia mayor era su velocidad de recesión. (Mayor su corrimiento al rojo). Esta “ley de Hubble” fue anunciada en 1929. La relación entre distancia y velocidad venía dada por una constante (constante de Hubble, valor actual de 70 (km/s) Mpc. Mpc = megapársec).

Fuente en aproximación, corrimiento al azul

Fuente estacionaria, espectro normal

Fuente en alejamiento, corrimiento al rojo

El gráfico del trabajo original de Hubble y Humason. (Distancias en pársecs, velocidades en kilómetros por segundo. Un pársec es 3, 08 x 1016 metros, o 3,61 años luz).

El significado de la ley de Hubble sería provisto por la hipótesis adelantada dos años antes por el sacerdote, físico y astrónomo belga Georges Lemaître. En efecto, en 1927 Lemaître presentó para publicación en Annales de la Société Scientifique de Bruxelles, un trabajo revolucionario, en el que postulaba un universo en expansión. (Un Univers homogène de masse constante et de rayon croissant rendant compte de la vitesse radiale des nébuleuses extragalactiques).

La proposición chocaba contra los criterios de Einstein, que creía que su teoría general de la relatividad predicaba un universo estático. (De hecho, introdujo un parámetro en sus ecuaciones, “la constante cosmológica”, para que dieran ese resultado. Luego de conocer las mediciones de Hubble declaró que la introducción de la constante cosmológica había sido el mayor error de su vida). Tampoco Arthur Eddington se sentía cómodo con la teoría de Lemaître, aunque hizo traducir al inglés el trabajo del belga en 1930, y ese mismo año Lemaître dio una conferencia en Londres en la que por primera vez postulara su idea de un “huevo cósmico” o “átomo primitivo”, una singularidad en el tiempo y el espacio en el que toda la materia del universo estaría concentrada en un punto, cuya explosión habría dado origen al universo, desde entonces en expansión. Había nacido la teoría del “Big Bang”.[2]

El Big Bang desde la singularidad primigenia

La proposición de Lemaître daba perfecto sentido a la ley empírica de Hubble, al concebir un proceso físico que explicaba la observable expansión del universo, evidente en el alejamiento de las galaxias entre sí. Más de tres décadas transcurrirían antes de que otro resultado empírico reforzara la idea, que hoy por hoy es la más aceptada de las teorías sobre la formación del universo. Pero antes había que inventar la radioastronomía.

Siete años después de la conferencia en la que Lemaître había propuesto, bajo otro nombre, la ocurrencia del Big Bang, Grote Reber, un ingeniero de radio norteamericano, ensamblaba el primer radiotelescopio parabólico, basado en los trabajos del pionero Karl Jansky. Éste, que trabajaba para los Laboratorios Bell, había recibido la misión de detectar fuentes de electricidad estática que pudieran interferir con las transmisiones radiotelefónicas transatlánticas, y en 1933 consiguió una señal—un hiss o silbido constante—con un ciclo de intensidad máxima de 23 horas y 54 minutos, cuyo origen identificó en el centro de nuestra galaxia, en la dirección de Sagitario. Jansky propuso a los Laboratorios Bell la construcción de una “antena de plato” con un diámetro de treinta metros, para mediciones más finas, pero la compañía consideró innecesaria la inversión y Jansky fue asignado a otras cosas.

El plato de 305 metros de diámetro del radiotelescopio de Arecibo, Puerto Rico, que el autor de estas líneas sobrevolara en 1978. Es operado por la Universidad de Cornell, y ha sido empleado en la búsqueda de señales de inteligencia extraterrestre (SETI, Search for ExtraTerrestrial Intelligence), actividad a la que el astrofísico Carl Sagan dedicara un notable esfuerzo. Un ciudadano común y corriente puede hoy prestar su computador personal para la “computación distribuida” de la enorme cantidad de señales recibidas mediante la descarga de un software gratuito: SETI@home.

Reber, por su parte, que había querido trabajar en Bell Laboratories bajo Jansky sin conseguirlo, optó por construir en el patio de su casa una antena parabólica de nueve metros de diámetro, la que enfocaba su recepción sobre un radiorreceptor suspendido a ocho metros sobre el fondo del plato. Al año siguiente logró con un tercer modelo detectar ondas de radio del espacio exterior y confirmó el hallazgo de Jansky. A partir de aquí Reber se propuso construir un mapa de las fuentes de radio del espacio, obteniendo el primero en 1941. Su trabajo le convirtió en el padre fundador de la radioastronomía. A su muerte en 2002, sus cenizas fueron repartidas entre los principales observatorios de radioastronomía en el mundo.

El primer radiotelescopio construido por Grote Reber en 1937

Entretanto, los Laboratorios Bell continuaron con sus estudios de transmisión y recepción con antenas parabólicas. En 1964 Arno Penzias y Robert Wilson detectaron, con un receptor ultrasensitivo, ondas de radio provenientes del espacio exterior que eran no sólo más potentes que las provenientes del centro de la Vía Láctea, sino también isotrópicas: esto es, provenientes homogéneamente de todas las direcciones del cielo. La radiación equivalía a la producida por un “cuerpo negro” a 2,7 grados Kelvin. Discusiones del hallazgo con un grupo de la Universidad de Princeton concluyeron en que la radiación correspondía a la predicha por las teorías del Big Bang, que sostenían que el espacio estaría lleno por una radiación proveniente del origen del universo.[3]

Los resultados de Penzias y Wilson, anunciados en 1965, fueron honrados con el Premio Nóbel de Física en 1978, una vez que la comunidad científica aceptara su interpretación como restos del Big Bang, o “radiación cósmica de fondo”; en inglés, Cosmic Background Radiation, o CBR[4]. (Edwin Hubble había hecho campaña para que la astronomía fuera considerada una parte de la Física para propósitos del premio, cosa que ocurrió, pero sólo después de la muerte de Hubble en 1953). Junto con la expansión de Hubble, la CBR es el fundamento empírico más fuerte de la teoría de un comienzo del universo observado a partir de una “singularidad”.

Mapa de la radiación cósmica de fondo a partir de los datos ofrecidos este año por la NASA y obtenidos por WMAP (Wilkinson Microwave Anisotropy Probe), instrumento lanzado al espacio en 2001 que sustituyó al COBE (Cosmic Background Explorer) de 1989. La “anisotropía” de la radiación—el grado de su irregularidad—corresponde con gran precisión a lo predicho por una forma bastante aceptada en teorías del Big Bang: el modelo Lambda-CDM (Lambda-Cold Dark Matter). Esa irregularidad permitió la formación de estructuras como las galaxias.

Hoy en día, pues, es de aceptación prácticamente universal que el universo que observamos comenzó hace un poco más de 13 mil millones de años con la súbita expansión de una concentración singular de materia y energía. En 1949, Hermann Bondi, Thomas Gold y Fred Hoyle habían propuesto una teoría alterna, la teoría del “estado estable”, o steady state theory.

La teoría del estado estable postula que el universo, obviamente en expansión a partir de las observaciones de Hubble, mantiene sin embargo su aspecto de conjunto porque constantemente se estaría creando materia. (Es una solución distinta a la propuesta originalmente por Einstein de un universo estático). Esta teoría tenía la “ventaja” de no requerir un origen del universo, y como la cantidad de creación de materia requerida por los datos era muy pequeña, durante la década de los cincuenta tuvo tantos adeptos como la teoría del Big Bang. En la actualidad sólo muy pocos cosmólogos la sostienen, pues la mayoría de ellos se ha pasado a las filas de Lemaître. El físico inglés Stephen Hawking escribió su epitafio, al decir que el descubrimiento de la radiación cósmica de fondo era “el último clavo en la urna de la teoría del estado estable”.

Es seguramente inevitable relacionar la teoría del Big Bang con las cosmogonías de origen religioso, que describen prácticamente todas—Islam, judaísmo, zoroastrismo, hinduismo (Rig Veda)—un origen del universo. Tan poderosa asociación era incómoda para una ciencia que, si no es atea, por lo menos quiere mantenerse alejada de temas teológicos. Esto era lo que perturbaba a Einstein—quien finalmente la aceptó—y lo que motivó a los proponentes de la teoría del estado estable o “creación continua”.

Refinamientos ulteriores de la teoría del Big Bang serán cubiertos en la Lección 10. LEA

Georges Lemaître con Einstein en 1933

Edwin Hubble ante la cámara del Telescopio Hooker en Monte Wilson

[1] El descubrimiento o la postulación independiente y casi simultánea de algún fenómeno o ley es asunto común en ciencia y tecnología, y a veces conduce a disputas agrias por el honor de la primacía. La más famosa controversia de esta clase se dio en torno a la invención del cálculo diferencial, que Newton y Leibniz desarrollaron independientemente. La ley que relaciona volúmenes y presiones de los gases es la de Charles-Gay Lussac; mientras que la que relaciona volúmenes y temperaturas es la de Boyle-Mariotte y, como hemos visto, la idea de la contracción de los cuerpos en movimiento se conoce como contracción de Lorentz-FitzGerald.

[2] El término “Big Bang”, la “Gran explosión”, se debe al astrónomo británico Fred Hoyle, quien trató a Lemaître, Él mismo era partidario de la teoría de la creación continua, o steady state, que propone un universo que se mantiene constante por la continua creación de materia. Su intención al proponer el nombre era burlarse de George Gamow, decidido defensor de las ideas de Lemaître. Hoyle ha sido igualmente un eficaz divulgador de ciencia y un exitoso autor de ciencia-ficción. (Su más famosa novela: The Black Cloud).

[3] Aún antes de las predicciones derivadas de una teoría del Big Bang, Arthur Eddington había estimado una temperatura promedio del universo de alrededor de 3º K en 1926. George Gamow, creyendo que la edad del universo era de 3.000 millones de años, postuló en 1946 una temperatura de 50º K. Hoy en día se acepta la cifra de 13.700 millones de años, y se obtiene la temperatura registrada por Penzias y Wilson suponiendo que proviene del enfriamiento de una temperatura de los fotones de 3.000º K cuando habían transcurrido unos 400 mil años desde el Big Bang.

[4] Más comúnmente se le designa por las siglas CMB, por Cosmic Microwave Background radiation.

por Luis Enrique Alcalá | Ago 5, 2006 | Física, Otros temas, Política |

La fisión nuclear y la bomba de hidrógeno. El mecanismo básico de la energía estelar y la evolución de una estrella. Diagrama de Hertzsprung-Russell y la secuencia principal. Radio de Schwarzschild y límite de Chandrasekhar. Enanas blancas, estrellas neutrónicas (pulsares) y agujeros negros. Noción de singularidad.

El año de 1945 resultó ser crucial en el desarrollo de la energía atómica de uso militar. El 16 de julio de 1945, casi exactamente a las 5:30 a.m. (hora local) los Estados Unidos detonaron en el desierto de Álamogordo, en Nuevo México, el primer artefacto nuclear de la historia, una bomba de plutonio que alcanzó la potencia explosiva de 20 kilotones.[1] Tres semanas más tarde, el 6 de agosto, estallaba sobre Hiroshima la primera bomba atómica de la guerra, esta vez de uranio, y tres días después otra bomba de plutonio destruía el puerto de Nagasaki. Estos eventos produjeron el inmediato fin de la Segunda Guerra Mundial, pues Japón accedió al ultimátum de rendición inmediata e incondicional, sin otra petición que la de que se respetara la majestad del emperador Hirohito.

La formación de la bola expansiva de la bomba explotada en Álamogordo cuando aún no habían transcurrido más de 25 milésimas de segundo desde la detonación.

Los artefactos detonados eran todos de fisión nuclear, el fraccionamiento de átomos de uranio o plutonio con una enorme liberación de energía. El desarrollo tecnológico necesario había comenzado en los Estados Unidos justo al comienzo de la guerra, a raíz de una famosa carta enviada a Franklin Delano Roosevelt por Albert Einstein.

La carta firmada por Einstein el 2 de agosto de 1939 había sido redactada mayormente por Leo Szilard, un físico húngaro que junto con sus compatriotas Edward Teller y Eugene Wigner, temía que Alemania utilizara la fisión nuclear para la fabricación de bombas atómicas. Roosevelt recibió la carta un mes después, justamente al inicio de la Segunda Guerra Mundial, que comenzó con la invasión de Polonia por las fuerzas de Hitler el 1º de septiembre. Roosevelt ordenó la formación del “Comité del Uranio”, que inició investigaciones que al principio marcharon con lentitud, si les compara con las emprendidas por los británicos y los alemanes. Poco antes del ataque a Pearl Harbor, el programa alcanzó su aceleración final, luego de que Vannevar Bush[2] influyera decisivamente sobre Roosevelt.

Un hito del programa lo constituyó la operación segura del primer reactor atómico, bajo la dirección de Enrico Fermi (asistido por Szilard), en un sótano de la Universidad de Chicago.[3] El 2 de diciembre de 1942 se logró la reacción en cadena controlada. Una llamada telefónica del físico Arthur Compton a James Conant (el jefe de Vannevar Bush) anunció en código: “El navegante italiano ha llegado al nuevo mundo. Los nativos son amistosos”. La frase era una clara alusión a Cristóbal Colón, pero también a la nacionalidad de Fermi. El comentario sobre los nativos hacía referencia a la reacción controlada, ofreciendo la buena nueva de que Fermi y sus colegas, así como buena parte de Chicago, no habían sido vaporizados por una reacción fuera de control convertida en explosión.

Para que se produzca una reacción en cadena—bombardeo de material fisionable por neutrones que genera una cascada de neutrones que continúa rompiendo átomos—es preciso contar con una “masa crítica”. En el caso del uranio 235 esa cantidad es de más o menos cincuenta kilogramos; para el plutonio 239 la cantidad es menor: bastan diez kilogramos. Por debajo de estas masas no se sostiene la reacción en cadena.

Fermi contaba, obviamente, con suficiente uranio para formar una masa crítica, y también con mecanismos de control. En primer lugar, los neutrones “lentos” son más eficientes para causar la fisión, y el grafito es un material que convierte neutrones energéticos en neutrones lentos. Luego, es preciso controlar el flujo de neutrones para que se dé una reacción en cadena que no se convierta en explosión. En el primer reactor de Chicago[4] se empleó tubos revestidos de cadmio, que es un eficaz absorbedor de neutrones. La introducción de estos tubos al seno del reactor reduce el flujo de neutrones, y su extracción lo aumenta.

El desarrollo de las armas propiamente dichas se hacía en otra parte. Las bombas no activas debían mantener separadas dos masas subcríticas que juntas harían una masa crítica. Así, se diseñó un cañón interno para la bomba de uranio (Hiroshima), que en el momento de la detonación disparara una masa subcrítica contra la otra. Para las bombas de plutonio (Álamogordo, Nagasaki) se usó más bien la compresión de una masa subcrítica en condiciones normales, mediante un dispositivo de “implosión” con cargas concéntricas. En ambos casos la fisión de átomos y la emisión de nuevos neutrones crecen exponencialmente.

En 1949 la Unión Soviética detonó su primera bomba atómica, y esto a su vez llevó a Harry Truman a ordenar el desarrollo acelerado de un segundo tipo de bomba nuclear: la bomba de hidrógeno, bomba de fusión o bomba termonuclear, cuyo más ardiente promotor era Edward Teller. Así, en 1950 Teller—un carácter difícil—asumió el liderazgo del nuevo programa. En colaboración no siempre tersa con el polaco Stanislaw Ulam, arribó a un diseño práctico en 1952. La primera bomba termonuclear fue detonada el 1º de noviembre de ese año en el atolón de Enewatak, en el océano Pacífico, con un rendimiento de 10,4 megatones.

“Ivy Mike”, el primer dispositivo termonuclear detonado por el hombre. Produjo un cráter de 2 kms. de diámetro e hizo hervir las aguas circundantes durante las próximas doce horas, además de derramar escombros coralinos radioactivos sobre buques estacionados a 45 kms. de la explosión.

Las bombas termonucleares fundamentan su enorme rendimiento energético en la reacción exotérmica—que produce energía—de la fusión de cuatro protones (núcleos de hidrógeno) para formar un núcleo de helio (partícula alfa, compuesta por dos protones y dos neutrones). En el proceso se emiten dos positrones (cada uno retira la carga eléctrica positiva del protón para convertirlo en un neutrón) y dos neutrinos[5] junto con una enorme liberación de energía. Para que los protones puedan vencer la repulsión electrostática que tiende a separarlos, su aproximación se realiza con la explosión “primaria” de una bomba de fisión alojada junto con el combustible fusionable. (Hidrógeno líquido). La terrible bomba atómica, que asoló las ciudades japonesas en 1945, había quedado reducida al papel de mero fulminante en una bomba muchísimo más poderosa. (Las bombas de 1945 alcanzaron una potencia de 20 kilotones, y en general los artefactos de fisión nuclear pueden llegar a rendir hasta 500 kilotones. Una bomba de hidrógeno moderna puede rendir fácilmente 500 megatones, o lo equivalente a la explosión de 500 millones de toneladas de TNT, y para activarse necesita alcanzar la temperatura de 3 millones de grados Kelvin que proporciona la bomba atómica que la enciende).

………

La energía liberada por humanos en los atolones del Pacífico es liliputiense en comparación con la cotidiana emisión energética de estrellas como nuestro Sol. Es precisamente la fusión de núcleos atómicos el motor que produce tan gigantesca radiación. Otra vez Arthur Eddington se adelantó con la proposición, en 1920, de que la energía proveniente del Sol sólo podría obtenerse de la fusión de hidrógeno para producir helio. Después de aportes de George Gamow, Hans Bethe y Carl von Weizsäcker, finalmente se obtuvo un cuadro bastante completo de lo que ocurre en el interior de las estrellas con el trabajo de Burbidge, Burbidge (marido y mujer), Fowler y Hoyle en 1957. (The B2FH paper).

En las estrellas más pequeñas que nuestro Sol (de tamaño intermedio) sólo ocurre la fusión de hidrógeno para formar helio; en estrellas de tamaño mediano el helio puede fusionarse para obtener carbono y oxígeno, y en sucesivas fusiones pueden llegar a formar átomos de hierro. Se necesita estrellas de mayor tamaño, capaces de alcanzar mayores temperaturas, para formar los elementos más pesados.

La evolución de las estrellas desde su formación hasta su muerte depende esencialmente de su tamaño inicial. Las estrellas se forman de la fragmentación y condensación de gigantescas nubes gaseosas—nubes moleculares—formadas en su mayor parte por hidrógeno (protones), en menor medida por helio y algo de metales. Estas enormes formaciones tienden a colapsar bajo la acción de la gravedad, y esta contracción aumenta su temperatura hasta alcanzar unos 50.000 grados Kelvin, lo que permite el inicio de la fusión nuclear. Dependiendo de la masa de la protoestrella, el nuevo astro seguirá uno de varios caminos evolutivos posibles.

Gigantescas nubes moleculares en la nebulosa del Águila de la constelación de la Serpiente. (Cerca de Virgo y Libra). Es de este tipo de nubes que se forman estrellas. Fotografiadas por el telescopio espacial Hubble. (NASA).

El camino es diferente si la nueva estrella es de una masa intermedia, como la de nuestro Sol, o si es mucho mayor o mucho menor. En el caso de una estrella de masa cercana a la de nuestro astro local, la fusión de hidrógeno la hace ingresar a la “secuencia principal”, en la que permanecerá por miles de millones de años quemando hidrógeno. El término “secuencia principal” alude a una ruta dibujada en un útil diagrama conocido como diagrama de Hertzsprung-Russell, que ubica a las estrellas en un plano cuyo eje de ordenadas mide la luminosidad de la estrella (o su color o clase espectral), y el eje de abscisas su temperatura. Creado entre 1911 y 1913 por Ejnar Hertzsprung, un químico y astrónomo danés, y Henry Russell, un astrónomo norteamericano, el diagrama HR se convirtió rápidamente en un instrumento de gran ayuda para la comprensión de la evolución estelar. (Naturalmente, la escala temporal de la evolución de una estrella es muchas veces mayor que la de la evolución humana, por lo que la primera se comprende a partir de observaciones de muchas estrellas distintas, cada una en una fase particular de su evolución).

Un diagrama de Hertzsprung-Russell simplificado. Las estrellas tienden a caer únicamente en ciertas regiones del diagrama. La secuencia principal se desplaza diagonalmente, desde las más jóvenes y luminosas estrellas de arriba a la izquierda, a las menos luminosas y calientes de abajo a la derecha. Las enanas blancas aparecen abajo a la izquierda y las gigantes rojas arriba y a la derecha de la secuencia principal.

Una vez que una estrella promedio se encuentra en la secuencia principal pasará en ella las nueve décimas partes de su vida, convirtiendo hidrógeno en helio dentro de su núcleo, y emitiendo radiación al exterior desde el manto que lo cubre. Es la presión ejercida por la reacción nuclear en su seno lo que contrarresta la enorme presión gravitacional, y mientras este equilibrio existe se detiene el colapso que la había iniciado a partir de la nube molecular. El helio producido, en razón de su mayor densidad, se acumula paulatinamente en el centro de la estrella. A partir de cierta cantidad interfiere con la fusión del hidrógeno restante, y se habla del envenenamiento por helio.

A partir de este momento la estrella reinicia su colapso gravitacional, hasta que la temperatura asciende hasta unos 100 millones de grados, momento en que es suficiente para iniciar la fusión de átomos de helio para producir carbono y oxígeno. El hidrógeno remanente en capas adyacentes al núcleo añade más radiación, y como la masa de la estrella ya es menor[6], su manto se expande y la estrella crece para entrar en fase de “gigante roja”. El color de estas estrellas se debe a que la expansión enfría el manto y la radiación es entonces menos energética.

Si la estrella es lo suficientemente masiva en su origen (unas 8 masas solares), al agotarse el helio volverá a contraerse y aumentar más la temperatura, lo que a su vez permitirá que se inicie la fusión de átomos de carbono. Al llegar al hierro este proceso de sucesivas fusiones de elementos más pesados se detiene, y el núcleo de la estrella exhibe una estructura en “capas de cebolla”.

Las capas sucesivas en el núcleo de una estrella, una vez que se ha producido la sucesión de fusiones de elementos progresivamente más pesados y poco antes de su colapso final.

Si, por lo contrario, la estrella original era pequeña (menor que 0,5 masas solares), nunca habrá temperatura suficiente para que la fusión de helio se inicie, y la estrella permanecerá por mucho tiempo (se calcula que hasta 50.000 millones de años) en forma de enana blanca. El astrofísico hindú Subrahmanyan Chandrasekhar calculó un límite de masa—límite de Chandrasekhar—a partir del cual la estrella no puede contrarrestar su colapso gravitatorio, por lo cual ésta procede a formar una estrella de neutrones (púlsar) o un agujero negro. El límite, 1,44 masas solares, es el tamaño máximo que puede tener una enana blanca. Una enana blanca tiene una densidad muy grande, pero mayor aún es la densidad de una estrella neutrónica, y todavía mucho mayor es la de un agujero negro.

Una estrella neutrónica se forma cuando la masa de la estrella es superior a 8 masas solares. Al agotársele el combustible nuclear explota como una supernova (de gran luminosidad instantánea) y el remanente estelar tiene una densidad tan grande—un centímetro cúbico pesa más de 24.000 kilos—que los protones y los electrones se combinan para formar neutrones. En 1967 Anthony Hewish y Jocelyn Bell descubrieron un tipo de estrella que emitía pulsos de radiación a intervalos regulares[7]. (Púlsar, o pulsating star). Poco después se explicó a los púlsares como estrellas neutrónicas. Provistas de muy intensos campos magnéticos, las estrellas neutrónicas giran a buena velocidad emitiendo radiación por sus polos magnéticos, y son como faros giratorios siderales. La brevedad de los períodos de rotación indica que los púlsares tienen un diámetro de pocos miles de kilómetros[8].

Pero queda todavía un destino diferente y más dramático para estrellas de masas aún mayores que las que formarían una estrella neutrónica. Se trata de la formación de agujeros negros, de tan enorme densidad, que su atracción gravitacional determina una “velocidad de escape” igual o superior a la de la velocidad de la luz[9]. En este caso, nada que esté por dentro del “horizonte de eventos” que rodea al agujero negro, ni siquiera los fotones, podría salir al exterior. Este horizonte viene determinado por un radio calculado por Karl Schwarzschild poco después de que Einstein publicara su teoría general de la relatividad, y depende de la masa del objeto:

(G es la constante de gravitación universal, M es la masa del objeto y c es la velocidad de la luz). Los agujeros negros fueron predichos por las ecuaciones de Einstein, como demostrarían Stephen Hawking y Roger Penrose en 1967. En su seno se supone que hay una “singularidad”: una región homogénea en la que la curvatura del espacio-tiempo producida por la presencia de masa es tan enorme, que las leyes físicas convencionales ya no son aplicables. Es justamente una condición de singularidad la que se predica para lo que existía antes de que el Big Bang se produjera. LEA

[1] Un kilotón equivale a la fuerza explosiva de mil toneladas de TNT.

[2] No tiene relación con George W. Bush. Como Director del Comité de Investigación de la Defensa Nacional (más tarde Oficina de Investigación Científica y Desarrollo), Vannevar Bush supervisó el Proyecto Manhattan, el nombre código asignado al programa norteamericano para el desarrollo de la bomba atómica. Bush fue un destacado ingeniero eléctrico. Un trabajo que acrecentó su fama de visionario fue publicado en Atlantic Monthly en 1945 (As we may think, que puede encontrarse íntegro en Internet), en el que visualizaba lo que luego se llamaría hipertexto, el lenguaje empleado en Internet: HTML, HyperText Markup Language

[3] Una cancha de squash bajo un estadio de fútbol abandonado.

[4] El primer reactor fue llamado una “pila atómica”: Chicago Pile Number 1, o CP-1.

[5] Los neutrinos son partículas eléctricamente neutras de masa infinitesimalmente pequeña. (Masa cero en reposo). Se conoce tres tipos de neutrinos, cada uno asociado a los tres leptones (partículas livianas que no forman parte del núcleo atómico): el electrón, el muón y la partícula tau.

[6] La pérdida de masa por expulsión causada por el viento solar es insignificante en términos de la masa de la estrella, aunque asombrosa para nuestras proporciones. Cada segundo el Sol expulsa 30.000 millones de kilogramos de su masa.

[7] El primer púlsar descubierto tenía un período de rotación de casi 1,34 segundos. Como el período era muy preciso, Bell y Hewish creyeron al principio que habían conseguido una señal de inteligencia extraterrestre. El descubrimiento subsiguiente de nuevos púlsares permitió desechar esta hipótesis.

[8] El más famoso de los púlsares es el del centro de la nebulosa del Cangrejo. Corresponde en el cielo al punto en el que astrónomos chinos describieran la explosión de una supernova en el año 1054.

[9] La velocidad de escape de la Tierra es la que tiene que alcanzar un móvil para escapar a la atracción gravitacional de nuestro planeta. Los cohetes lanzados hacia la Luna o más allá, debieron superar esta velocidad de 40.320 kilómetros por hora, equivalente a 11,2 kilómetros por segundo.

por Luis Enrique Alcalá | Ago 4, 2006 | Física, Otros temas |

La ordenación del zoológico atómico mediante la postulación de los quarks de Murray Gell-Mann. El modelo estándar de las partículas. La unificación de electromagnetismo y las interacciones “fuerte” y “débil”. Máseres y láseres. Un éxito diferido de Einstein. Noción general de holografía.

En la época del surgimiento de los Beatles, la difusión de la ideología hippie, la presidencia y muerte de Kennedy, el Concilio Ecuménico; en la muy especial década de los sesenta, la Física, especialmente la física de partículas, estuvo muy activa, y su logro principal estuvo en el ordenamiento del zoológico de las partículas subatómicas, que después de un breve remanso de simplicidad inicial, se nutrió rápidamente con más de doscientas instancias diferentes. El protón, el antiprotón, el electrón, el antielectrón (positrón), el neutrón, el antineutrón, el fotón, el mesón Pi (pión, en sus varios tipos), el mesón K (kaón, también de diversos tipos), los diferentes tipos de neutrinos, los hiperones, la partícula Lambda, etcétera, dejaban rastros numerosos en las placas fotográficas de las cámaras de burbuja de los aceleradores de partículas en el mundo. Esta situación motivó esfuerzos por clasificar, primero, y luego explicar la variedad.

El héroe indiscutido de este emprendimiento es Murray Gell-Mann[1] (Premio Nóbel de Física de 1969), un niño prodigio con gran sentido del humor y una memoria fotográfica, que postuló primero—independientemente también Yuval Ne’eman—el camino óctuple como esquema de clasificación y poco después la hipótesis de los quarks que hoy forma el núcleo del Modelo Estándar de la física de partículas.

Antes del trabajo de Gell-Mann había sido posible distinguir entre dos familias de partículas: unas que se comportaban con arreglo a la “estadística de Fermi-Dirac”, los llamados fermiones; otras cuya distribución energética sigue las reglas de la “estadística de Bose-Einstein”, o bosones[2]. Los fermiones siguen el llamado “principio de exclusión de Pauli”: sólo una partícula puede ocupar un cierto “estado cuántico” en un momento dado. (No puede haber dos fermiones con el mismo conjunto de “números cuánticos”. Un número cuántico describe las energías de las partículas en un átomo. Para un electrón, por ejemplo, se considera el número cuántico principal, el número cuántico azimutal, el número cuántico magnético y el espín, o número cuántico de momento angular). El protón, el neutrón, el electrón, son todos fermiones, con espín 1/2; el fotón es un caso de bosón, con espín 1.

El estudio por Gell-Mann de una clase de partículas conocidas como hiperones (y también los kaones) llevó a formular la existencia de una nueva cualidad cuántica, cuyo nombre ya mostraba la tendencia poético-humorística de los físicos de la época: extrañeza. (Strangeness). La clasificación de estas partículas se entendía mejor si se les atribuía una propiedad, la extrañeza, que se conservaba en ciertas interacciones. (Los kaones y ciertos hiperones siempre son creados en pares, lo que sugería que esa propiedad estaba sujeta a una ley de conservación o simetría, como en el caso de la ley de la conservación de la energía).

Ya para ese momento la Física lograba distinguir tres clases de “fuerzas” (interacciones) en el seno del átomo. (Donde la cuarta interacción fundamental, la gravitación, no toma parte). Éstas eran la interacción electro-magnética (unificación de Maxwell de las interacciones antaño consideradas independientes: electricidad y magnetismo), responsable básicamente de la atracción entre los protones del núcleo atómico y su corona de electrones; la interacción “fuerte”, a la que se debe la atracción entre los nucleones (partículas que forman el núcleo, como los protones y neutrones); la interacción “débil”, causante del fenómeno conocido como radiación o decaimiento “beta”. (Emisión de electrones o partículas beta desde el interior de un átomo).

Adicionalmente, según la masa de las partículas, se las consideraba fundamentalmente de tres tipos: bariones (pesadas, como el protón o el neutrón), leptones (livianas, como el electrón), y mesones (de masa intermedia, como el pión y el kaón). Los bariones, por su parte, son fermiones, así como el electrón (y también el muón y la partícula Tau, ambos leptones como el electrón) mientras que los mesones son bosones. Finalmente, se tiene por hadrones a las partículas que, como el protón y el neutrón, experimentan la interacción fuerte.

Hasta allí la posibilidad de taxonomía antes de los trabajos de Gell-Mann, pero lo taxonómico no es, por supuesto, una explicación. Antes de que la explicación fuera posible había que añadir estructura a la clasificación, la que vino proporcionada por el esquema de camino óctuple.

Dos octetos (en el centro de cada diagrama hay dos partículas) de Gell-Mann. A la izquierda el de los mesones; a la derecha el grupo (bariones) al que pertenecen el neutrón (n) y el protón (p).

Agrupando las partículas según su carga eléctrica y su espín, Gell-Mann logró obtener dos organizaciones en octetos para mesones y bariones (de espín 1/2), y asimismo un decuplet (diez partículas) de bariones más masivos (con espín 3/2). (Partículas delta, partículas sigma, etcétera). El vértice de esta decena correspondía una partícula no detectada hasta entonces. Gell-Mann pronosticó (1962) que tendría una masa de 1.680 eV/c2, carga eléctrica unitaria negativa y un número cuántico de extrañeza de –3, y propuso el nombre de omega-menos para la partícula predicha. Dos años más tarde un acelerador en Brookhaven lograba identificar una partícula con esas características, lo que dio gran credibilidad al esquema del camino óctuple[3] de Gell-Mann y Ne’eman.

La decena de los bariones de espín 3/2, que sugirió a Gell-Mann la predicción de la partícula omega-menos dos años antes de su observación experimental. Los niveles horizontales corresponden al número cuántico de extrañeza (desde 0 hasta –3), mientras que la disposición diagonal corresponde a la carga eléctrica. (De –1 hasta 2).

El siguiente paso consistió en la formulación de una hipótesis revolucionaria, pues postulaba una estructura interna de los bariones como el protón y el neutrón, y de los mesones; es decir, éstas no serían partículas verdaderamente elementales. Más abajo estarían los quarks[4] ¡que tendrían carga eléctrica fraccionaria![5]

El “Modelo Estándar” surgido de la hipótesis de la existencia de quarks[6] ha logrado simplificar de nuevo el mundo de las partículas subatómicas. Para esto los agrupa en tres “generaciones” de partículas: la primera generación se compone de los quarks “arriba” (up o u) y “abajo” (down o d), el electrón y el neutrino del electrón. Con esta generación se forma toda la materia ordinaria: los bariones se componen de tres quarks y los mesones de un quark y un antiquark.

El quark u tiene una carga eléctrica de 2/3; el quark d una de –1/3. Esto permite concebir un protón como formado por dos quarks u y un quark d. (La suma de las cargas es 2/3 + 2/3 – 1/3 = 4/3 – 1/3 = 3/3 = 1). El neutrón estaría formado por un quark u y dos quarks d. (2/3 – 1/3 – 1/3 = 0) y por eso no posee carga eléctrica. Los quarks son en sí mismos fermiones; es decir, su espín es 1/2 o –1/2.

En cambio, el mesón K+ se compone de un quark u y un antiquark d. Como los antiquarks ostentan números cuánticos inversos, el antiquark d tiene carga eléctrica = -(-1/3) = 1/3. Por tal razón el mesón tiene K+ carga eléctrica positiva unitaria. (2/3 + 1/3).

De la misma manera se obtiene la composición de todos los hadrones ordinarios. (Partículas afectadas por la interacción fuerte). Otras partículas requieren la intervención de las dos restantes generaciones de partículas, que a su vez incluyen cada una dos quarks (y sus respectivos antiquarks) distintos de u y d. Estos otros quarks son “encanto” (charm) y “extraño” (strange), y la pareja formada por “fondo” (bottom) y “cima” (top).

La teoría del Modelo Estándar es lo que se conoce como una “teoría de calibración”. (Gauge theory). En esencia requiere la noción de “partículas virtuales” que, intercambiadas por las partículas “normales”, equivalen o dan origen a una fuerza atractiva. Estas partículas son los siguientes bosones : el fotón, la partícula W – , la partícula W + y la partícula Z0. Éstos son los bosones de la interacción electromagnética (el fotón) y la interacción débil. (Los restantes). La interacción fuerte requiere un bosón diferente, al que se llama gluón.

Así como Maxwell fue capaz de unificar electricidad y magnetismo en una sola fuerza o interacción, las interacciones electromagnética y débil fueron unificadas en los trabajos de Sheldon Glashow, el pakistaní Abdus Salam[7] y Steven Weinberg, que compartieron el Premio Nóbel de Física en 1979 por este logro. Según la teoría “electro-débil”, a energías de 100 GeV o superiores ambas interacciones se funden en una sola. Tanto esta teoría como la “electrodinámica cuántica” (la que explica las interacciones electromagnéticas a nivel subatómico) son compatibles con la teoría especial de la relatividad. Asimismo, las teorías de “gran unificación” (GUTs) han tenido éxito en unificar la teoría de la interacción fuerte—“cromodinámica cuántica”, (el “color” es una propiedad de los quarks)—y la electro-débil.

Sólo una de las cuatro interacciones fundamentales, la gravitación, falta por unificarse. Como se observó, las unificaciones han tenido éxito en la compatibilización de la física cuántica y la teoría especial de la relatividad, pero todavía no hay una “teoría cuántica de la gravitación”. Nadie ha observado los “gravitones”, la partícula teórica que mediaría la fuerza de gravedad, como el fotón lo hace con la fuerza electromagnética. A los esfuerzos en esta dirección se les conoce como TOEs (Theories Of Everything). Es lo que buscó Einstein hasta el fin de sus días con su “teoría del campo unificado” y Heisenberg con su “ecuación universal” de la Física. Hoy en día, la llamada “teoría de cuerdas” (String Theory) es la más fuerte candidata a lograr la unificación final, pero a costa de suposiciones que parecen haladas por los cabellos. (Por ejemplo, requiriendo diez u once dimensiones espacio-temporales, en lugar de las cuatro del continuo-espacio tiempo de la relatividad).

De hecho, la simplificación del zoológico de las partículas subatómicas y las interacciones entre ellas ha requerido la aplicación de estructuras matemáticas cada vez más complejas. (Esto solo habría hecho sospechar a Einstein, quien solía decir que Dios era refinado pero no malicioso. Raffiniert ist der Herr Gott aber boschaft ist Er nicht). Las estructuras de esta física de partículas corresponden a la llamada “Teoría de Grupos”—un grupo es un conjunto de números y la definición de una operación matemática que se les aplica—y sirven, sin duda, como malla conceptual lanzada sobre la realidad. Usualmente definen una “simetría” que se conserva en las distintas interacciones.

Una característica particularmente incómoda del Modelo Estándar es su requerimiento de que los quarks estarán siempre en confinamiento. Esto es, que no podrían ser observados aisladamente, pues estarían confinados al interior de los hadrones. Filosóficamente hablando, esto es una fea mancha de la teoría, pues postula un inobservable, postula entidades que jamás podrían ser observadas. Una cosa tal sería rechazada frontalmente por el más positivista de los físicos, Ernst Mach, y por su discípulo, Albert Einstein.

Además de estas dos debilidades—la ausencia de conexión con la gravitación relativista y el inobservable del confinamiento—el Modelo Estándar, desarrollado entre 1970 y 1973, ha entrado en problemas por sus predicciones relativas a la masa de los neutrinos. El modelo predice una masa nula para estas partículas, y recientes experimentos (1998) parecen indicar que aunque esta masa es pequeñísima, no es realmente cero. Hay además, algunas lagunas en la compatibilización del modelo con observaciones de nivel cosmológico.

A pesar de estos inconvenientes, el Modelo Estándar ha sido extraordinariamente exitoso, al predecir con gran precisión partículas no detectadas antes y sus características fundamentales. Por poner un caso, el modelo predijo la existencia del bosón Z, adjudicándole una masa de 91,1874 GeV; la masa observada de esta partícula ha resultado ser de 91,1876 GeV. Se ha pretendido subsanar algunos de estos y otros inconvenientes a través de teorías que han traído más problemas que soluciones. Por ejemplo, mediante la postulación de que los quarks tampoco serían partículas fundamentales, sino que a su vez estarían formados por partículas, los preones, todavía menores. And the beat goes on.

Familias (3) de partículas elementales

………

En el reino de lo tecnológico, por otra parte, la misma década de los sesenta asistía a la irrupción de un invento que hoy en día es para nosotros familiar y cotidiano: el rayo láser. El primero de ellos fue demostrado justamente en 1960, por Theodore Maiman, sobre trabajos de Charles Townes y Arthur Schawlow. El láser, y el máser que lo precediera, hacen uso de un fenómeno anticipado por Einstein en 1916.

Los términos láser y máser son acrónimos: este último viene de la contracción de Microwave Amplification by Stimulated Emisión of Radiation; láser, en cambio, nos habla de Light Amplification.

Cuando un electrón en la corona de un núcleo atómico da un salto cuántico desde un nivel más energético a uno de menor energía, emite un fotón que porta exactamente la energía correspondiente a la diferencia entre los niveles. Esta emisión puede ser espontánea, pero cuando es estimulada por incidencia de fotones sobre el material en cuestión se habla de emisión estimulada. (También puede absorberse un fotón para llevar a un electrón desde un nivel inferior de energía a uno superior).

Saltos cuánticos espontáneos y estimulados

En el caso de la emisión estimulada al fotón incidente se añade el segundo fotón emitido, por lo que el fenómeno se multiplica, en forma análoga a la de una reacción en cadena; la radiación incidente es “amplificada”. La propiedad más importante de la emisión estimulada, sin embargo, es que el fotón emitido tiene exactamente la misma frecuencia del fotón incidente y está en fase con él: esto es, las crestas y valles de sus ondulaciones coinciden exactamente. Por esta razón un rayo láser es monocromático (luz de una sola frecuencia), y además es coherente (ondas en fase). La exactitud de un máser, por ejemplo, es la particularidad que permite su empleo como “relojes atómicos”. (A estos fines se utiliza preferentemente el máser de hidrógeno).

El mecanismo básico del láser es exactamente el mismo del máser. Un láser produce radiación de mayor frecuencia (desde el infrarrojo hasta el segmento electromagnético de los rayos X). Por tal razón ha generado un mayor número de aplicaciones, desde la cirugía ocular hasta la excitación para fines de observación de átomos de sodio en la atmósfera, pasando por la tecnología de los discos compactos y los DVDs.

Rayo láser para excitar átomos de sodio en la atmósfera superior. Base de la Fuerza Aérea de los Estados Unidos en Kirtland, Nuevo México.

Una de las tecnologías potenciadas por el láser es la de la holografía, o producción de hologramas, fotografías que son capaces de reproducir la tridimensionalidad del objeto fotografiado. En la fotografía convencional, la placa o película registran sólo la intensidad de la luz (la amplitud de la onda) y su color (la frecuencia). Un tercer aspecto, que permite almacenar la información volumétrica, es la fase de las ondas luminosas. Con luz coherente del tipo láser, el choque y reflexión de superficies en planos distintos generará desfase en el rayo originalmente coherente. La descodificación de esta información con un rayo similar permite reconstruir la imagen tridimensional original. LEA

[1] Gell-Mann fue cofundador y director del Instituto de Santa Fe (Nuevo México), dedicado al estudio de la complejidad (complexity science) y es autor de un libro sobre este último tema: El quark y el jaguar. En una entrevista concedida a Scientific American dijo no ser una personalidad ni “apolínea” ni “dionisíaca”, sino un híbrido difícil que él llama “odiseico)”, lo que según reporta le ha causado más de un problema con sus colegas: “It’s a lonely place to be”.

[2] Por Enrico Fermi y P. A. M. Dirac en un caso, por Satyendra Nath Bose y Albert Einstein en el otro.

[3] El nombre fue escogido también para travesuras místicas de Gell-Mann, pues la misma designación de camino óctuple existe en el budismo para referirse a una ruta de desarrollo espiritual.

[4] Término tomado de Finnegan’s Wake, de James Joyce: “Three quarks for Muster Mark”.

[5] Una noción análogamente perturbadora vendría en la geometría fractal propuesta por Benoit Mandelbrot, en la que lo que se hace fraccionario es el concepto de dimensión. Esto es, hay estructuras geométricas que tienen, digamos, una dimensión mayor que 1 (la de una línea), pero menor que 2. (La de una superficie).

[6] Postulada independientemente por Gell-Mann y George Zweig. Este último había propuesto el nombre “ases” para las subpartículas, pero Gell-Mann ganó la batalla terminológica con sus quarks.

[7] Visitó a Venezuela en 1981 para recaudar—sin éxito—fondos a favor del Centro Internacional de Física de Trieste.

por Luis Enrique Alcalá | Ago 3, 2006 | Física, Otros temas |

La búsqueda de una teoría del campo unificado (Einstein) y de la ecuación general (Heisenberg). A Theory Of Everything. (TOE). Hacia una relatividad cuántica. Noción de teoría de cuerdas. Cuantización del espacio y el tiempo.

En su Autobiografía, Werner Heisenberg escribió: “Hasta entonces, siempre habíamos creído en la vieja doctrina de Demócrito, que puede resumirse como: ‘En el principio era la partícula’. Se había supuesto que la materia visible estaba compuesta de unidades más pequeñas, y que si se dividía a éstas lo suficiente, debiéramos llegar a las unidades más pequeñas, que Demócrito había llamado ‘átomos’, y que ahora podían llamarse ‘partículas elementales’—es decir, ‘protones’ o ‘electrones’. Pero quizás esta filosofía estaba enteramente equivocada. Quizás no existían elementos más pequeños que ya no pudieran ser divididos. Quizás la materia podía ser dividida todavía más, hasta que finalmente ya no fuese una división real sino un cambio de energía en materia y las partes ya no fueran más pequeñas que lo que hubiera sido dividido. Pero ¿qué había al principio? ¿Una ley de la naturaleza, matemáticas, simetría?”

La última palabra de este trozo resultó ser clave en la formulación teórica del mundo subatómico, y en general en la Física. La búsqueda y matematización de simetrías fundamentales está en la base de las teorías acerca de las partículas elementales y su interacción. Heisenberg, por su parte, construía sobre la intuición de Emmy Noether, un matemático de la Universidad de Gotinga, que en 1918 adelantó la siguiente correlación: “Toda ley de conservación es una consecuencia de una simetría de las leyes naturales”.

La idea de que la naturaleza conserva ciertas magnitudes a pesar de las transformaciones es bastante antigua. Incluso Heráclito, que decía que todo estaba en movimiento—Panta rei—buscaba encontrar algo constante detrás de los cambios aparentes. Llegaría el siglo XVII para que Gottfried Wilhelm von Leibniz postulara que ese factor constante era la energía. (Conservatio virium). Las colisiones de los cuerpos cambian las direcciones del movimiento, pero la energía permanece constante, como es constante igualmente durante el movimiento de un péndulo. Pero esto se observa en la colisión de los cuerpos elásticos, no así en la de los inelásticos, en la que aparentemente desaparece una parte de la energía cinética. Parecían caber sólo dos explicaciones: o se producía una transformación de la energía al nivel de las partículas pequeñas que componen un cuerpo—lo que era inobservable para la época—o la conservación de la energía era simplemente una ilusión.

Fue a mediados del siglo XIX cuando Julius Robert Mayer retomara el asunto para declarar que la energía era una entidad que no podía ser creada o destruida. Finalmente, en 1905 Albert Einstein encontraba que materia y energía eran una misma cosa, y desde ese entonces se habla de la conservación de la materia-energía. Antes, James Clerk Maxwell había encontrado que la electricidad y el magnetismo eran dos manifestaciones de un mismo fenómeno. La unificación aparentaba ser el camino de la Física; toda la segunda mitad del siglo XX alojó una constante búsqueda por unificaciones más fundamentales.

Es así como Heisenberg emprendió, en la década de 1950, la búsqueda de una “fórmula universal” de la Física, e hizo esto a partir de las simetrías fundamentales que daban origen a las leyes de conservación. Si se establece una jerarquía de las leyes físicas, son las leyes de conservación las que ocupan el pináculo de generalidad, al ser de aplicación más universal. Así comentaba el punto Heisenberg en Der Teil und das Ganze—La parte y el todo—un recuento histórico de la aventura científica de la primera mitad del siglo XX, en la que él había sido importantísimo protagonista: “…[si] las leyes de conservación, para la energía o para la carga eléctrica, son de carácter absolutamente universal, se aplican a todas las esferas de la Física, y surgen de propiedades de simetría en todas las leyes de la naturaleza, entonces se sugiere a sí mismo el pensamiento de que estas simetrías son elementos determinantes en el plan según el que fue creada la naturaleza”.

Y en otra parte avanza: “Las partículas elementales en la filosofía de Platón recibían su simetría de lo que se llamó el ‘grupo del espacio’, el grupo de las revoluciones en el espacio tridimensional. Esto, por tanto, involucra una simetría estática, directamente intuitiva. La física moderna, no obstante, incorpora al tiempo en su observación de la naturaleza desde un principio. Desde Newton, la física se ha preocupado con la dinámica de los fenómenos. Está basada en la opinión de que, en este mundo constantemente cambiante, las leyes—antes que las formas geométricas—es lo que debe ser duradero. Estas leyes son básicamente construcciones más abstractas, que se aplican, sin embargo, al espacio y el tiempo… La teoría definitiva de la materia estará—como en Platón—caracterizada por una serie de importantes demandas de simetría… Estas simetrías ya no pueden ser elucidadas simplemente mediante figuras e imágenes, como era posible con los cuerpos platónicos, pero esto puede hacerse con ecuaciones”.

El neoplatonista que era Heisenberg procuró, armado de este punto de vista, arribar a una ecuación general de la Física de la que pudieran extraerse todas las demás. A fines de 1957 informó a su amigo y colega de toda la vida, Wolfgang Pauli, acerca de una nueva ecuación de campo a la que había arribado. El habitualmente escéptico Pauli reaccionó esta vez con entusiasmo, pero el trabajo conjunto, que convirtió la “ecuación de Heisenberg” en la “ecuación de Heisenberg-Pauli”, nunca conduciría a nada, a pesar de que una conferencia prematura de Heisenberg en Gotinga suscitara elogiosos comentarios periodísticos que anunciaban “el fin de la Física”.[1]

Heisenberg hablaba de una “teoría del campo unificado”, y hay por tanto que entender qué es un campo para la Física. Un campo es una región del espacio en la que se manifiesta alguna magnitud física, como puede ser una perturbación eléctrica o una atracción magnética. Cada punto del espacio—o si se quiere más generalmente, del espacio-tiempo einsteniano—recibe la asignación de una cantidad de esa magnitud, por lo que el campo es verdaderamente continuo y extendido sin límites. Llena, por decirlo así, todo el espacio, aunque con fuerza variable en distintas regiones. El campo eléctrico y el campo magnético, recordemos, había sido reunido en un solo campo electromagnético gracias a los trabajos de Maxwell. Lo que pretendía Heisenberg era añadir a esta unificación lo requerido para describir correctamente la conducta de las partículas.

El mismo Einstein trabajó los últimos años de su vida, justamente, en una “teoría del campo unificado”, tratando, esta vez, de unificar las ecuaciones del campo electromagnético y su teoría general de la relatividad, que había provisto una novedosa explicación del fenómeno de la gravitación. Ya asentado en el Instituto de Estudios Avanzados de Princeton, buscó, también sin éxito, esa unificación de gravedad y electromagnetismo. El intento rendía, invariablemente, valores infinitos para ciertas variables, lo que no tenía sentido físico.[2]

Después de la década de 1950, sin embargo, los físicos han tenido éxito al producir nuevas unificaciones. El trabajo implicó reunir en una sola teoría varias de las cuatro interacciones—antes llamadas “fuerzas”—fundamentales del universo observable. Estas cuatro interacciones son la interacción fuerte (que mantiene unidas las partículas integrantes del núcleo atómico a pesar de la repulsión electromagnética de los protones), la interacción débil (responsable del decaimiento beta, la radiación de electrones o partículas beta desde el núcleo), la interacción electromagnética y la gravedad. Cada una de éstas es explicada en una “teoría de calibración” (gauge theory) que postula un campo y unas partículas que “median” la interacción: es decir, la interacción se produce por el intercambio de las partículas de mediación.

Pues bien, después de la integración de Maxwell entre electricidad y magnetismo, la próxima se produjo entre el electromagnetismo y la interacción débil. Esto es, hay ahora una sola teoría de la que se deducen tanto los comportamientos electromagnéticos como las interacciones débiles, así como las partículas características de ambas interacciones: el fotón, partícula mediadora del electromagnetismo, y los bosones W y Z, que median la interacción débil.[3]

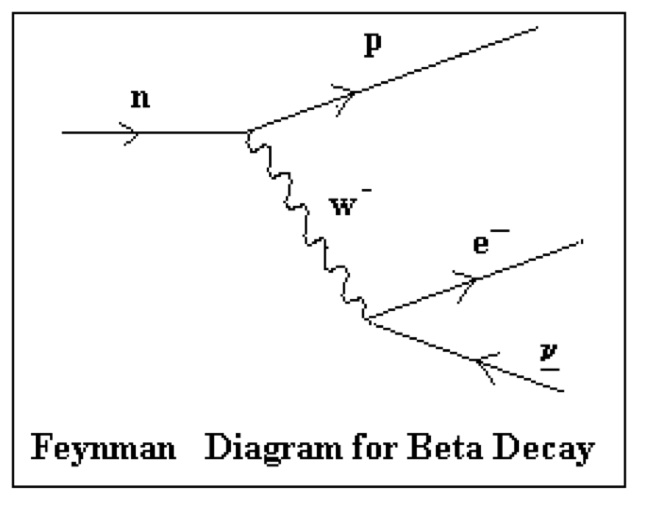

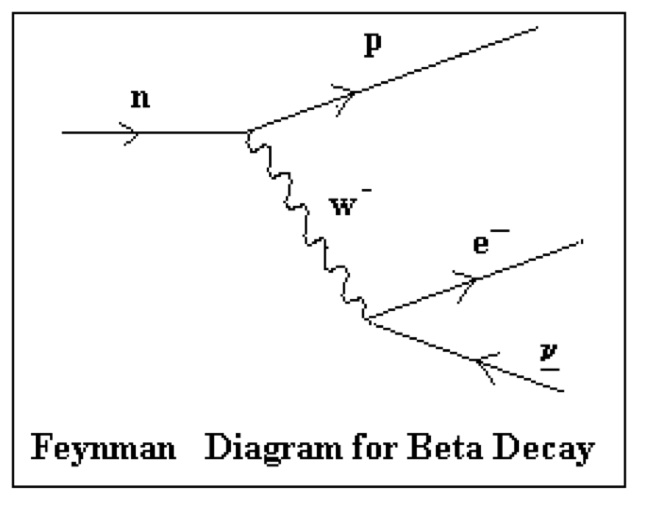

Los distintos bosones

Una interacción débil típica es la que convierte un neutrón (ligeramente más pesado que un protón) en un protón (positivo) y un electrón (negativo) junto con un antineutrino. En esta interacción se conserva la carga eléctrica (una ley de conservación, o una simetría, operando), pues la suma de las cargas opuestas del protón y el electrón equivale a la carga cero del neutrón, y el antineutrino que se produce es eléctricamente neutro. Es esta interacción la que se conoce como decaimiento beta (beta decay) puesto que la emisión de electrones (partículas beta) desde el núcleo fue llamada así por Ernest Rutherford originalmente.

Diagrama de Feynman del decaimiento beta. Un neutrón (a la izquierda del diagrama) pierde un bosón W negativo y se convierte en protón. El bosón da origen a un electrón y un antineutrino. (A la derecha y abajo). La línea ondulada que representa al bosón indica que se trata de una partícula “virtual”.

En cambio, la interacción fuerte que mantiene unidos los nucleones (partículas del núcleo atómico) ocurre por la mediación de partículas virtuales llamadas gluones. Éstos no portan carga eléctrica y son, como el fotón, de masa nula. La teoría electrodébil, explicativa de tanto el electromagnetismo como la interacción débil, no incluye explicación para los gluones y, por tanto, no es una teoría que explique la interacción fuerte.