por Luis Enrique Alcalá | Ago 8, 2006 | Física, Otros temas |

La formulación generalizada de la física cuántica entre 1921 y 1927. La interpretación de Copenhague. Bohr, Heisenberg (principio de incertidumbre o indeterminación), Schrödinger. Partículas y ondas. Einstein toma un camino solitario.

A partir de 1900, luego de que Max Planck presentara los cuantos al mundo y Einstein los convirtiera en fotones, comenzaron a desmoronarse los primitivos modelos del átomo, sus constituyentes y su radiación. Incluso el modelo atómico propuesto por el llamado padre de la Física Nuclear, Ernest Rutherford, tuvo corta vida. El papado de esa ciencia pasaría pronto a manos del danés Niels Bohr, su alumno, quien iba a formular el primer modelo cuántico del átomo. (Más específicamente, del átomo de hidrógeno).

El modelo de Rutherford había concebido un átomo que era la analogía a escala submicroscópica de un sistema solar. Los electrones serían los planetas de un sol equivalente al núcleo atómico. Desde el principio, sin embargo, fue evidente que esa metáfora no podía sostenerse: los electrones portaban carga eléctrica y al moverse perderían energía cinética ineludiblemente, por lo que terminarían colapsados sobre el esférico lecho nuclear. Como esto no era lo observado—el propio Rutherford había establecido que en términos atómicos había una distancia enorme y aparentemente persistente entre los electrones y el núcleo—una nueva explicación se hacía necesaria.

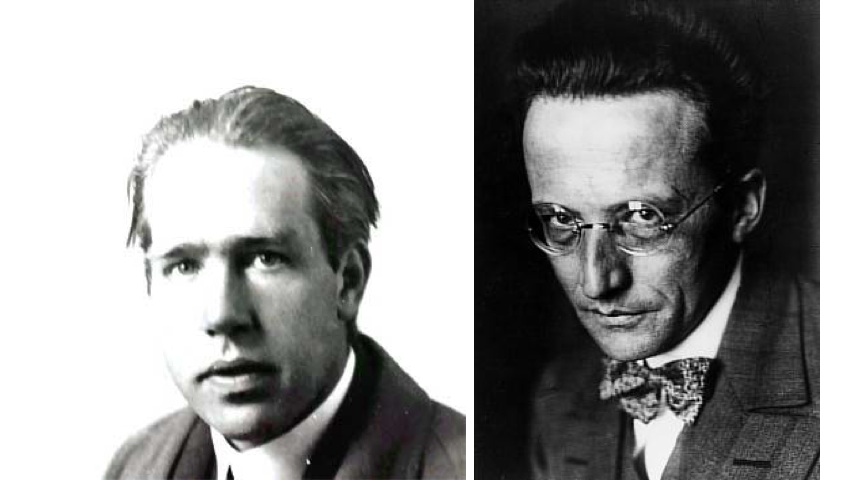

Niels Bohr (1885-1962) fue el encargado de aportarla, y su solución sería sofisticada e insuficiente a la vez, aunque precursora de lo que vendría. En el primitivo modelo de Bohr (1913) el átomo sigue consistiendo de un pequeño núcleo cargado positivamente rodeado por una nube o corona de electrones, sólo que éstos ya no son entendidos como minúsculos planetas individualizados, sino como ondas que se extienden por toda la órbita de cada uno. La característica más importante del modelo era, sin embargo, su “cuantización” de estas órbitas electrónicas.

No toda órbita era posible, sino unas pocas órbitas específicas. En cada una el electrón en cuestión poseía un nivel de energía específico. Cada electrón podía saltar de una a otra órbita mediante la absorción de un cuanto de radiación electromagnética (fotón) o la emisión de uno. El tamaño del cuanto venía determinado por la diferencia entre los niveles de energía de las órbitas. Las órbitas permitidas se calculan a partir de los valores cuantizados (discretos) del momento orbital angular[1] L según la siguiente fórmula:

donde n corresponde a 1, 2, 3… y h es la constante de Planck. En la órbita de menor energía, la más cercana al núcleo, n es igual a 1.

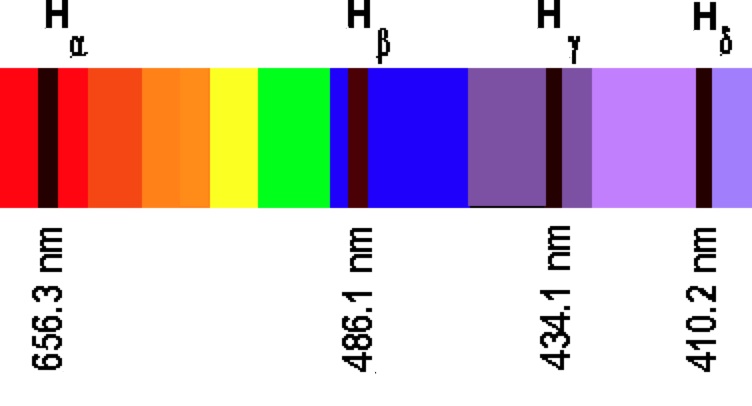

Al momento orbital angular calculado por la ecuación de Bohr se le denomina ahora “número cuántico principal”, y su solución tuvo éxito en explicar la fórmula empírica de Rydberg para las precisas líneas espectrales de emisión del átomo de hidrógeno, que se obtuvo experimentalmente sin que se contara con una fundamentación teórica.

A pesar de modificaciones introducidas por Sommerfeld al modelo de Bohr, éste no lograba explicar todo—por ejemplo, por qué debe ser cuantizado el momento angular—y finalmente fue suplantado definitivamente por la más completa explicación de la mecánica cuántica que se desarrollaría más tarde. Hoy en día el modelo de Bohr, tenido por semiclásico[2], es un caso límite[3] o especial de la mecánica cuántica, y el átomo de hidrógeno es calculado a partir de la ecuación de onda (1925) del físico austriaco Erwin Schrödinger.

Niels Bohr - Edwin Schrödinger

En 1920, ya profesor de la Universidad de Copenhague, Niels Bohr asumió la dirección del recién creado Instituto de Física Teórica (más tarde Instituto Niels Bohr), donde las futuras luminarias de la física nuclear—Werner Heisenberg y Wolfgang Pauli entre ellas—estudiaron bajo su prestigiosa guía. A Bohr le fue concedido el Premio Nóbel de Física en 1922, un año después de Einstein, “por sus servicios en la investigación de la estructura de los átomos y de la radiación que emana de ellos”.

Para aquel momento, entonces, tres escalones de la escalera cuántica[4] habían sido trepados: la intuición original de Planck en 1900, la aplicación de Einstein a la luz y el efecto fotoeléctrico y la primera descripción cuántica de un átomo, debida a Bohr. El próximo aporte fue suministrado por el físico francés Louis de Broglie, quien destacó la naturaleza dual de las entidades subatómicas—de comportamiento a un tiempo corpuscular y ondulatorio—en su tesis doctoral de 1924, en la que introdujo, para el electrón, la noción de ondas de materia[5]. (Recherches sur la théorie des quanta). Bohr recogió esta postulación en su “principio de complementaridad”, que estipulaba que cualquier entidad cuántica puede manifestarse como onda o como partícula, aunque no simultáneamente como ambas cosas, dependiendo del método de observación. El camino indicado por de Broglie daba paso a una concepción “filosófica” central de la nueva física y seguiría la bifurcación onda-partícula[6] para permitir el paso de dos formulaciones alternas de los fundamentos generales de la física cuántica.

En efecto, al año siguiente de la disertación por de Broglie, dos mecánicas cuánticas distintas y consistentes fueron propuestas independientemente por Werner Heisenberg y Erwin Schrödinger. El primero propuso en 1925 un esquema construido con matrices (mecánica matricial) o grupos de números asociados, mientras que el segundo adelantó una “mecánica de ondas” (wave mechanics). Ambas construcciones eran equivalentes, como señalaría el propio Schrödinger y más tarde la unificación (la teoría de la transformación) propuesta por P. A. M. (Paul Adrien Maurice) Dirac. En el fondo del asunto estaba una característica esencial del mundo subatómico: la imposibilidad de tratarlo como una entidad clásica y determinista, pues sus dimensiones se manifestaban difusas, no determinables con fija exactitud, sino como expresión de una distribución de probabilidades. A la escala subatómica es imposible predecir con una precisión arbitraria: la entidad del electrón, por caso, no puede ser imaginada como ocurriendo en un punto determinado del espacio (modelo planetario de Rutherford), sino como llenando con densidad variable toda la “extensión” de la órbita, (Modelo de Bohr).

Así, Schrödinger imaginaba a la carga eléctrica del electrón como una “nube” borrosa distribuida por toda su órbita. Cupo a Max Born la gloria de sugerir que la tal nube, “retratada” en la ecuación de onda, no debía ser entendida como una entidad física, sino como una distribución de probabilidades. Mientras no se observaba, lo mejor que podía decir la física cuántica era una probabilidad acerca de la ubicación exacta de una partícula en el espacio, y esto se manifestaba como una ecuación de onda que “colapsaba” una vez que se determinaba esa posición.

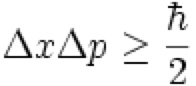

Heisenberg llevaría esta situación un poco más allá: en 1927 formuló[7] lo que se conocería de allí en adelante como “principio de incertidumbre” o “principio de indeterminación”. (Esta última designación fue propuesta por Bohr). Que si fuera posible medir la posición q de una partícula con el grado requerido de precisión, entonces ya no sería posible determinar su momento p, y viceversa. Wolfgang Pauli, otro físico alemán que asistía, como Heisenberg, al instituto dirigido por Bohr y era amigo del joven autor de la mecánica matricial, escribió a éste una carta en la que describía gráficamente la situación: “Puedes ver el mundo con el ojo-p así como puedes verlo con el ojo-q, pero si tratas de abrir ambos ojos a la vez te volverás loco”. (En términos algo más técnicos, no se puede medir con arbitraria precisión los valores de cantidades “conjugadas” , es decir, de observables que ocurren pareados, como la posición y la velocidad o el momento de una partícula. En la formulación matemática de esta condición fundamental de la mecánica cuántica volvía a aparecer la aparentemente inevitable y ubicua constante de Planck:

Lo que dice la fórmula de Heisenberg es que el producto de la incertidumbre en la posición Dx por la desviación estándar (una medida estadística de dispersión) del momento Dp, el resultado no será inferior a la mitad de la constante de Planck dividida por 2p.[8] El cociente establece un límite fundamental a la precisión con la que pueden ser determinadas las cantidades conjugadas. Aunque este límite es muy pequeño en términos de lo macroscópico, a escala subatómica introduce una indeterminación insalvable.

La suma de teorías cuánticas, sin embargo, requería una interpretación, es decir, explicar de qué estaban hablando los científicos del instituto liderado por Bohr. La “Interpretación de Copenhague” sería expuesta primero en un simposio reunido en Como en septiembre de 1927 para conmemorar el centenario de la muerte de Alessandro Volta. Allí Bohr ofreció su gran conferencia, titulada “El postulado del cuanto y más recientes desarrollos en física atómica”, en representación del equipo. (Formado por el mismo Bohr, Heisenberg, Born, Pauli y Pascual Jordan). Un mes más tarde se celebró por quinta vez la Conferencia Solvay en Bruselas—la primera tuvo lugar en 1911—y allí tuvo la novísima interpretación su prueba de fuego.

La naturaleza estadística e indeterminada de la nueva física resultó indigerible para el venerado Alberto Einstein, quien la combatiría hasta el final de sus días. De este modo el gran patriarca de la física del siglo XX se hizo anacoreta. Max Born habló por la comunidad de físicos entera al escribir: “Muchos entre nosotros ven esto como una tragedia—para él, mientras busca a tientas su camino en soledad, para nosotros, que echamos en falta a nuestro líder y portaestandarte”.

Wolfgang Pauli, Werner Heisenberg, Enrico Fermi. Lago de Como, septiembre de 1927. Fotografía de archivo del Centro Europeo para la Investigación Nuclear (CERN).

La palabra “interpretación” no es de selección arbitraria. En el campo lógico-lingüístico es posible construir un lenguaje “formal” consistente en meros símbolos y sus reglas de combinación. No es necesario que signifiquen nada. Al “interpretarlo” se dota de contenido “semántico” (significado) a los símbolos y fórmulas obtenidas en el lenguaje formal. Las fórmulas y ecuaciones del “formalismo” cuántico son en sí mismas entidades abstractas útiles, por ejemplo, para calcular la probabilidad de encontrar una partícula dada en una cierta región del espacio. Su poder reside en su capacidad de modelar fenómenos que es imposible deducir de las teorías clásicas. Entre éstos se encuentran la cuantización de ciertas cantidades físicas (número discreto de órbitas electrónicas, por ejemplo), la dualidad onda-partícula y la relación de incertidumbre. Por la época del desarrollo de la interpretación de Copenhague, existía una intensa actividad en lógica, lingüística y filosofía de la ciencia (Wittgenstein, Círculo de Viena, Russell, Hilbert), así como algunos físicos, entre ellos Ernst Mach, Alberto Einstein y el mismo Niels Bohr, tenían posiciones filosóficas muy firmes, y no ignoraban el vivo debate epistemológico de los tiempos.

Einstein, en particular, sostenía que la mecánica cuántica era una teoría “incompleta”, en el sentido de no proporcionar una explicación para todo “elemento de la realidad” física. (1935). Hacía cuatro años que Kurt Gödel hubiera demostrado sus teoremas de incompletitud y el término estaba en el aire. Por su parte, Bohr, el otro polo de la polémica, se limitaba a reiterar la correspondencia de la teoría con los hechos y su propia interpretación de ella.

Una vez que él y Heisenberg extendieran la interpretación probabilística de la función de onda adelantada por Max Born, rechazaban sistemáticamente que ciertas cuestiones tuvieran sentido, puesto que la Física, al decir de Bohr, no tiene por objeto decirnos cómo es el mundo en realidad, sino sólo predecir exitosamente los resultados de los experimentos. William Blake hubiera considerado a ésta, la más desnuda entre las posturas, la esencia última del satanismo.

DIGRESIÓN

(Quien escribe asistió a la conferencia de un físico yugoslavo—de nombre olvidado y que fuera alumno todavía de Max Planck—en el Centro de Física del Instituto Venezolano de Investigaciones Científicas, IVIC, en 1981 o 1982. La conferencia versó sobre los principios generales de la física cuántica. En esa ocasión el suscrito planteó al profesor visitante la siguiente cuestión: en 1931 Gödel mostró que los sistemas matemáticos de riqueza equivalente o superior a la de la aritmética o teoría de los números, no podían ser a la vez completos y consistentes. Comoquiera que la física cuántica empleaba un formalismo matemático más complejo que la mera aritmética, habría transpuesto el “umbral gödeliano”, y por tal razón sufriría de incompletitud o inconsistencia. Tal vez, entonces, la incertidumbre de Heisenberg tenía una raíz lógico-lingüística. El conferencista se mostró impactado por la idea y no pudo ofrecer respuesta satisfactoria al asunto).

En todo caso, la física cuántica ha sido sometida a numerosísimas verificaciones experimentales. De todas ha salido airosa. En particular, ha tenido extraordinario éxito predictivo, y también en tanto guía de desarrollos tecnológicos diversos, que pueblan el mundo de nuestra cultura material, desde la criptografía hasta la generación de imágenes por resonancia magnética nuclear, pasando por el transistor y el rayo láser. Desarrollos sucesivos han integrado el tratamiento cuántico con la teoría especial de la relatividad—teoría cuántica del campo o quantum field theory—y también han producido una teoría satisfactoria de la interacción nuclear o fuerte—cromodinámica cuántica—que mantiene a los nucleones (el protón y el neutrón) confinados al núcleo del átomo, así como una unificación—teoría electrodébil—de la electrodinámica con la “interacción débil”. (Responsable en los átomos de la emisión de partículas beta—electrones—en el proceso conocido como decaimiento beta: beta decay).

Es el objetivo más profundo de la Física en nuestros días la unificación de la mecánica cuántica y la teoría general de la relatividad. En este esfuerzo el propio Einstein, y Heisenberg, con su muy preliminar e incompleta “teoría general de la materia”, que contendría la fórmula universal de la Física, fracasaron. La actual candidata, la “teoría de cuerdas”, es una estructura tan compleja y tan poco intuitiva, que habría horrorizado a Einstein, eterno creyente en la simplicidad y belleza de las fórmulas incrustadas en la creación divina.

NOTAS HISTÓRICAS

1. Heisenberg trabajó en su teoría general o unificada de la materia por más de cinco años, durante los cuales contó con la colaboración, a veces a distancia, de su muy entrañable amigo y colega, Wolfgang Pauli.

Las matemáticas involucradas en el estudio eran tan enrevesadas que generó un constante ir y venir de correcciones, y el trabajo no pudo ser publicado, como Heisenberg planeó, en Zeitscrift für Naturforschung, y sólo circuló en unas pocas copias como pre-print, una forma semiprivada de comunicación científica preliminar de uso común en los Estados Unidos. El envío de las copias tuvo lugar el 27 de febrero de 1958, tres días después de que Heisenberg presentara el asunto en el Coloquio de Física de la Universidad de Gotinga. A este evento asistió una nutrida concurrencia, en la que se encontraba un periodista con algún barniz de conocimientos físicos. Al día siguiente la Agencia Alemana de Prensa transmitía un despacho que llegó a los periódicos: “El ganador del premio Nóbel, profesor Werner Heisenberg, ha hecho.. un anuncio sensacional. El director y su equipo en el Instituto de Física de la Sociedad Max Planck han descubierto una ecuación que podría, por primera vez en la historia de la Física, servir como base para la deducción de la Física entera…”

Al saber esto, Pauli reaccionó ácidamente, enviando a un grupo de colegas una hoja de papel en blanco en la que aparecía dibujado un rectángulo. Sobre la figura había una leyenda que decía: “Esto es para mostrar al mundo que puedo pintar como Tiziano”. Y debajo: “Sólo faltan detalles técnicos”.

Heisenberg jamás llegó a su ansiada teoría general. Irónicamente, cuando supo que Murray Gell-Mann intentaba la comprensión de las partículas elementales como compuestas de entidades aun más pequeñas (quarks), creyó que el nuevo enfoque estaba fundamentalmente equivocado. Hoy los quarks son la piedra angular del llamado “modelo estándar” que explica la existencia de las partículas subatómicas. Como antes Einstein se separó de la corriente principal de la Física al perseguir sin éxito un error básico en la mecánica cuántica, Heisenberg también se había quedado atrás, aunque tales circunstancias no desdigan un ápice de los dos grandes físicos del siglo XX.

2. En 1998 se estrenó en Londres la obra teatral premiada de Michael Frayn, “Copenhague”, que relata el transcurrir de una visita que Heisenberg hiciera a Bohr—de raíz judía—en una Dinamarca ocupada por los nazis. Heisenberg dirigía el programa de investigación nuclear de Alemania, y de la reunión cada interlocutor ofreció una distinta versión de los hechos. Bohr negó la relación de Heisenberg, que quiso se interpretara el encuentro como la ocasión en la que dio seguridades al primero de que el programa que dirigía no fabricaría una bomba atómica.

En 2002 Howard Davies dirigió una adaptación de la obra para televisión. El papel de Heisenberg fue asumido por Daniel Craig, el nuevo intérprete de Bond, James Bond, en próxima película. LEA

[1] El momento de un cuerpo viene dado al multiplicar su masa por su velocidad. En un movimiento orbital se trata de una velocidad angular, de allí la aparición de π en la ecuación. La energía es el producto de la masa por el cuadrado de la velocidad.

[2] La física “clásica”, incluida en ella la teoría de la relatividad, es la previa a la física cuántica. Es determinística en lugar de probabilística, como la última.

[3] Tal como la mecánica de Newton es considerada un caso límite o especial de la teoría general de la relatividad.

[4] A diferencia de la teoría de la relatividad, que fue esencialmente aportada por el genio solitario de Einstein, la mecánica cuántica fue construida con los aportes de un buen número de investigadores, quienes fueron añadiendo, en rápida sucesión, escalones adicionales.

[5] Generalizada esta idea, una onda característica está asociada incluso a una masa como la de la Tierra, aunque a su escala las propiedades ondulatorias sean enteramente despreciables. Es a la escala subatómica cuando las manifestaciones ondulatorias se hacen notables.

[6] En inglés se ha acuñado el término wavicle para referirse a estas entidades de dos caras, a partir de la contracción de las palabras wave y particle.

[7] Über den anschaulichen Inhalt der quantentheoretischen Kinematik und Mechanik.

[8] Al cociente de la constante de Planck dividida por 2p se le conoce como constante de Planck reducida, término que Bohr había introducido en la fórmula del momento orbital angular y se designa con el símbolo .

por Luis Enrique Alcalá | Ago 8, 2006 | Fichas, Política |

LEA, por favor

La gentileza del doctor Gonzalo Pérez Petersen me ha permitido leer Cuentos chinos, el informativo libro de Andrés Oppenheimer, conocido comentarista de la televisión internacional y periodista de gran influencia. (Fue escogido por Forbes Media Guide como uno de los quinientos periodistas más importantes de los Estados Unidos en 1993, y la revista Poder lo incluyó en una lista de las cien personas más poderosas en América Latina en 2002). El doctor Pérez Petersen me facilitó un ejemplar de la segunda edición (marzo de 2006) de la obra editada por Random House-Mondadori en noviembre de 2005. (Colección Otras Voces, Debate).

En diez capítulos, Oppenheimer, editor de asuntos internacionales en The Miami Herald y conductor de un programa de opinión muy visto en CNN, desmonta un número equivalente de «cuentos chinos» relativos al tema del desarrollo de América Latina. (Que él escribe América latina). Cuando escribe sobre China, o Irlanda o Polonia, lo hace con la intención de extraer lecciones pertinentes a las economías latinoamericanas. Un caso de su particular interés es el venezolano.

Al proyecto político de Hugo Chávez lo denomina «narcisista-leninista», una designación tanto gráfica como sintética, y desde el primer capítulo, El desafío asiático, la emprende contra la primitiva prédica del gobierno chavista. Es de este capítulo de donde se extrae el trozo inicial para componer esta Ficha Semanal #105 de doctorpolítico.

Oppenheimer se propuso construir bases razonables para un optimismo acerca del futuro latinoamericano, sobre cuyas esperanzas de renacer apunta en su epílogo: «Claro que las hay, siempre y cuando nuestros países se miren menos el ombligo, y más a su alrededor. En la medida en que nos adentremos en lo que parece ser el siglo asiático, la clave del éxito de las naciones—cualquiera sea su ideología política—es la competitividad. Y para eso hace falta que los países, como las empresas, atraigan inversiones productivas y busquen nichos de mercado donde puedan insertarse en las economías más grandes del mundo, como lo están haciendo con gran éxito los asiáticos».

Se trata de una tesis sencilla, nada misteriosa, asentada sobre sus observaciones de experimentado periodista internacional. (Oppenheimer nació en Buenos Aires, donde estudio cuatro años de la carrera de leyes—poco menos que Benjamín Rausseo—antes de obtener una maestría en Periodismo en la Universidad de Columbia en 1978).

LEA

…

No crea en cuentos

Uno tiene que viajar a China, en la otra punta del mundo, para descubrir la verdadera dimensión de la competencia que enfrentarán los países latinoamericanos en la carrera global por las exportaciones, las inversiones y el progreso económico. Antes de llegar a Beijing, había leído numerosos artículos sobre el espectacular crecimiento económico de la República Popular China y de otros países asiáticos como Taiwán, Singapur y Corea del Sur. Y estaba asombrado de antemano por el éxito chino en sacar a cientos de millones de personas de la pobreza en las últimas dos décadas, desde que el país se había abierto al mundo. Sin embargo, nunca imaginé lo que vería, y escucharía, en China.

Desde el minuto en que aterricé en la capital china, me quedé boquiabierto ante las gigantescas dimensiones de todo. Todavía sentado en el avión, desde la ventanilla, advertí que mi vuelo se aprestaba a ubicarse en el hangar número 305, lo que de por sí ya era un primer motivo de asombro para un viajero frecuente acostumbrado a bajarse en la puerta B-7 del aeropuerto de Miami, que tiene apenas 107 hangares, o en el hogar 28 del aeropuerto de Ciudad de México, que tiene 42. Cuando salí del avión con el resto de los pasajeros, me encontré con un aeropuerto gigantesco, parecido a un estadio cerrado de fútbol, sólo que cinco veces mayor, y de arquitectura futurista. Por el aeropuerto de Beijing transitan nada menos que 38 millones de personas por año, y ya está quedando pequeño, según me enteré después. De allí en más, saliendo del aeropuerto, la fiebre capitalista que se está viviendo en China, disfrazada por el régimen como una «apertura económica» dentro del socialismo, me deparó una sorpresa tras otra.

Era difícil no hacer comparaciones constantes entre lo que se ve en China y lo que está ocurriendo en América latina. Horas antes de mi llegada, en el vuelo de Tokio a Beijing, había leído en uno de los periódicos en inglés que repartían en el avión una noticia breve, según la cual Venezuela acababa de cerrar por tres días los ochenta locales de McDonald’s que operan en ese país. La medida, según el cable noticioso reproducido en el periódico, había sido tomada para investigar presuntas infracciones impositivas. El autoproclamado gobierno «revolucionario» de Venezuela sostenía que no toleraría más transgresiones de las multinacionales a la soberanía del país. Y aunque la controversia todavía no había sido resuelta en la Justicia, las autoridades habían ordenado cerrar los locales, y citaban la medida como un gran logro de la revolución bolivariana. La noticia no me sorprendió demasiado: había estado en Venezuela pocos meses antes, y había escuchado varios discursos incendiarios del presidente Hugo Chávez contra el capitalismo, el neoliberalismo y el «imperialismo» norteamericano. Pero lo que me asombró fue que, al día siguiente de mi llegada a la capital china, leyendo ejemplares recientes del China Daily—el periódico oficial de lengua inglesa del Partido Comunista chino—me encontré con un titular que parecía escrito a propósito para diferenciar a China de Venezuela y de otros países «revolucionarios»: «¡McDonald’s se expande en China!», anunciaba jubilosamente. El artículo señalaba que el consejo de directores en pleno de la multinacional norteamericana estaba por iniciar una visita a China, y sería recibido por las máximas autoridades del gobierno. Durante su estadía, los ilustres visitantes de la corporación multinacional anunciarían la decisión de McDonald’s de aumentar su red actual de seiscientos locales en China a más de mil durante los próximos doce meses. «China es nuestra mayor oportunidad de crecimiento en el mundo», señalaba Larry Light, el jefe de marketing de McDonald’s, al China Daily . Qué ironía, pensé para mis adentros: mientras en China comunista le dan una bienvenida de alfombra roja a McDonald’s, en Venezuela lo espantan.

Lo cierto es que hay un enorme contraste entre el discurso político de los comunistas chinos y el de sus primos lejanos más retrógrados en el escenario político latinoamericano. Mientras los primeros se desvelan por captar inversiones, una buena parte de los políticos, académicos y empresarios proteccionistas latinoamericanos se regodean en ahuyentarlas. En China, me encontré con un pragmatismo a ultranza y una determinación de captar inversiones para asegurar el crecimiento a largo plazo. Mientras Chávez recorría el mundo denunciando el «capitalismo salvaje» y el «imperialismo norteamericano», y recibiendo aplausos en los congresos latinoamericanos, los chinos les estaban dando la bienvenida a los inversionistas norteamericanos, ofreciendo todo tipo de facilidades económicas y promesas de seguridad jurídica, aumentando el empleo y creciendo sostenidamente a tasas de casi el 10 por ciento anual. Los jerarcas chinos mantienen un discurso político marxista-leninista para justificar su dictadura de partido único, pero en la práctica están llevando a cabo la mayor revolución capitalista de la historia universal. Después del XVI Congreso del Partido Comunista de 2002, que acordó «deshacerse de todas las nociones que obstaculizan el crecimiento económico», el pragmatismo ha reemplazado al marxismo como el valor supremo de la sociedad. Y, aunque a muchos nos repugnen los excesos del sistema chino, y no quisiéramos transplantar ese modelo a América latina, no hay duda de que la estrategia está logrando reducir la pobreza a pasos agigantados en ese país.

………

En una de mis primeras entrevistas con altos funcionarios chinos en Beijing y Shanghai, Zhou Xi-an, el subdirector general de la Comisión Nacional de Desarrollo y Reforma, el poderoso departamento de planificación de la economía china, me contó que un 60% de la economía china ya está en manos privadas. Y el porcentaje está subiendo a diario, agregó. Zhou, un hombre de unos cuarenta años que no hablaba una palabra de inglés a pesar de tener un doctorado en Economía y trabajar en el sector más conectado con Occidente del gobierno chino, me recibió en el majestuoso edificio de la comisión, en la calle Yuetan del centro de la ciudad. Intrigado por cuán lejos había transitado China en su marca hacia el capitalismo, yo había ido a la cita armado de un fajo de recortes periodísticos sobre la ola de privatizaciones que estaba teniendo lugar en el país. Acostumbrado a viajar a países donde la palabra «privatización» tiene connotaciones negativas, en parte por sus resultados no siempre exitosos, pensaba que algunos de los datos que había leído sobre China eran exagerados, o por lo menos no serían admitidos públicamente por los funcionarios del gobierno comunista. Pero me equivocaba.

«¿Es cierto que ustedes piensan privatizar cien mil empresas públicas en los próximos cinco años?», le pregunté al doctor Zhou, artículo en mano, a través de mi intérprete. El funcionario meneó la cabeza negativamente, casi enojado. «No, esa cifra es falsa», replicó. E inmediatamente, cuando yo ya pensaba que me iba a dar un discurso en defensa del socialismo, e iba a acusar a los periódicos extranjeros de estar exagerando la nota sobre las privatizaciones, agregó: «Vamos a privatizar muchas más». Acto seguido, el doctor Zhou me explicó que el sector privado es «el principal motor del desarrollo económico» de China, y que hay que brindarle la mayor libertad posible. Yo no podía dar crédito a lo que estaba escuchando. El mundo estaba patas para arriba.

De ahí en más, mis entrevistas con funcionarios, académicos y empresarios en la capital china me depararían una sorpresa tras otra. Sobre todo, cuando entrevisté a los máximos expertos sobre América latina, que—sentados al lado de la bandera roja y profesando fidelidad plena al Partido Comunista—me señalaban que los países latinoamericanos necesitaban más reformas capitalistas, más apertura económica, más libre comercio y menos discursos pseudorrevolucionarios. Uno de ellos… me dijo que uno de los principales problemas de América latina era que todavía seguía creyendo en la teoría de la dependencia, el credo económico de los años sesenta según el cual la pobreza en Latinoamérica se debe a la explotación de los Estados Unidos y Europa. En la República Popular China, el Partido Comunista había dejado atrás esta teoría hacía varias décadas, convencido de que China era la única responsable de sus éxitos o fracasos económicos. Echarles la culpa a otros no sólo era erróneo, sino contraproducente, porque desviaba la atención pública del objetivo nacional, que era aumentar la competitividad, me aseguró el entrevistado. Ése era el nuevo mantra de la política china, que eclipsaba a todos los demás: el aumento de la competitividad como herramienta para reducir la pobreza.

Andrés Oppenheimer

por Luis Enrique Alcalá | Ago 7, 2006 | Física, Otros temas |

La exploración cada vez más penetrante del átomo. El neutrón de Chadwick. El creciente zoológico de partículas subatómicas. La noción de antipartícula. La fisión del uranio y la energía atómica. Lise Meitner y Enrico Fermi. El Proyecto Manhattan.

Kenneth Ford, quien presidiera el American Institute of Physics, acuñó la expresión zoológico de partículas para referirse al creciente número de “corpúsculos” más pequeños que un átomo. Escribiendo en la década de los sesenta, tenía noticia de los cientos de partículas producidas artificialmente en descomunales laboratorios conocidos como aceleradores de partículas. Luego de los experimentos iniciales en el mundo subatómico—debidos a Rutherford—en los que partículas producidas espontáneamente por radioactividad (proyectiles) “bombardeaban” un “blanco” material, la tecnología fue incorporando aceleradores artificialmente construidos de potencia cada vez mayor[1]. Al inicio, sin embargo, todo parecía ser relativamente simple, cuando se creía que las partículas subatómicas eran solamente tres: el protón y el electrón, ambos con carga eléctrica unitaria, y el neutrón, que como su nombre indica, no porta carga eléctrica. El protón y el neutrón habitaban el núcleo del átomo, de cuya masa son mayormente responsables, mientras que el electrón se encontraba en la corona circundante, aportando prácticamente nada a la masa atómica. (La masa de un protón equivale a la de 1.836 electrones. En términos prácticos, la masa de un átomo resulta de sumar el número de protones y el de neutrones contenidos en su núcleo, mientras que el “número atómico” corresponde al número de protones o su carga positiva total. En un átomo neutro, no un ión, el número de protones y el de electrones son idénticos).

La primera de las partículas descubiertas fue el electrón, por J. J. Thomson en sus experimentos de 1897, identificándolo como el constituyente elemental de lo que su discípulo, Ernest Rutherford, denominaría “radiación beta”, una de las tres formas de emanación presente en las sustancias radioactivas. Su existencia había sido predicha por G. Johnstone Stoney (1874) a partir de sus trabajos en electroquímica. (Electrólisis, electrodeposición, etc.)

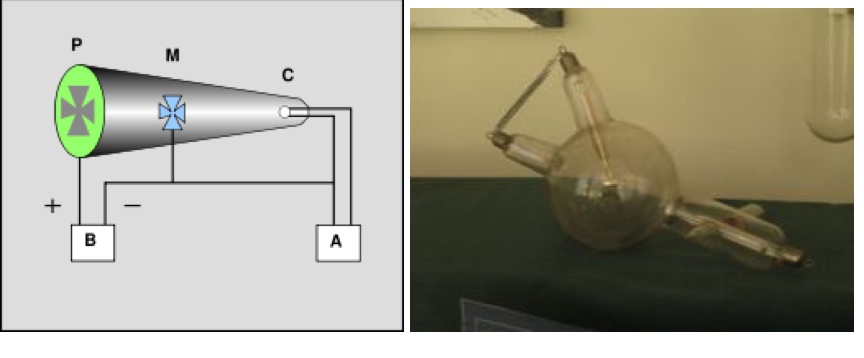

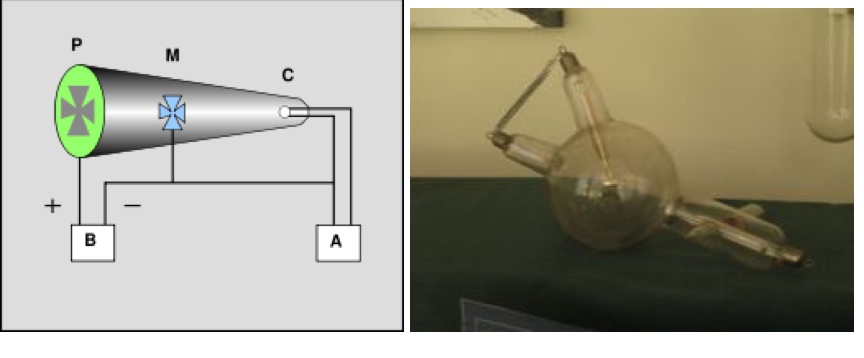

William Crookes proveyó el aparato que conduciría al descubrimiento del electrón: el “tubo de Crookes” o tubo de rayos catódicos. En esencia es un receptáculo “cónico” de vidrio al que se ha hecho el vacío y se le ha dotado de tres electrodos: un ánodo y dos cátodos. La superficie del ánodo se reviste con una sustancia fosforescente. (Usualmente, fósforo).

Representación esquemática y fotografía de un tubo de Crookes.

Entre el ánodo y el cátodo principal se ubica una “máscara de sombra” conectado a éste, con una forma particular. (Típicamente una cruz de Malta). Los “rayos catódicos” (radiación proveniente del cátodo) excitan el fósforo del ánodo, que brilla salvo en el área proyectada por la sombra.[2]

Fueron estos rayos catódicos los que Thomson estudió. Además de establecer su desviación por causa de campos eléctricos y magnéticos (lo que era característico de partículas con carga eléctrica), Thomson calculó la proporción de carga sobre la masa de estos “corpúsculos”, llegando a la conclusión de que esa relación era más de mil veces la de un ión de hidrógeno. De estos resultados pudo entonces Thomson “descubrir” (deducir) la existencia del electrón, que debía venir del interior del átomo. El revolucionario hallazgo le valió el Premio Nóbel de Física en 1906.

Trece años separarían este descubrimiento de la postulación de la segunda partícula subatómica, mucho más masiva que el electrón pero de igual carga eléctrica. A esta partícula se le daría el nombre de protón, y el honor de su descubrimiento correspondería en 1919—el año de la confirmación astronómica de la teoría general de la relatividad—a Rutherford, el alumno de Thomson.

Antes del hallazgo Eugen Goldstein había teorizado, a partir de las conclusiones de Thomson, que siendo los átomos eléctricamente neutros debían existir en su seno partículas cargadas positivamente que compensaran o anularan las cargas negativas de los electrones. De hecho, inició la cacería del protón sin conseguirlo. (Obtuvo partículas de carga positiva dentro de un tubo de Crookes modificado, pero midió masas variables para las mismas al cambiar los gases del aparato. Eran iones y no protones lo que había observado). El testigo pasó a manos de Rutherford.

Primeramente, el neozelandés adjudicó los nombres de radiaciones alfa, beta y gamma a las tres emisiones del uranio. Luego postuló que la radiación alfa, formada por partículas de carga positiva, estaba compuesta, en realidad, por núcleos de átomos de helio. (1899).

Entra entonces en la escena la “cámara de niebla” inventada por Charles Wilson en 1912, que permitió refinar las observaciones del electrón. Consiste de una cámara llena de vapor de agua por la que se hace pasar radiación. Cuando las partículas poseen carga eléctrica inducen a su paso la ionización y condensación de las moléculas de vapor, lo que deja una estela visualmente discernible.[3]

La cámara de niebla de Wilson de 1912

Rutherford había observado (1918) que al bombardear nitrógeno con partículas alfa sus detectores de centelleo[4] parecían indicar la presencia de iones de hidrógeno, y concluyó que éstos sólo podían provenir del nitrógeno. En consecuencia, aventuró la hipótesis de que el nitrógeno debía “contener” núcleos de hidrógeno. Esta interacción de partículas alfa con el nitrógeno fue también observada en una cámara de niebla, la que registró bifurcaciones que a veces invertían completamente la dirección de una partícula alfa incidente. Al comprobar que estos trazos invertidos correspondían a la huella que dejarían iones de hidrógeno, y que en el interior del receptáculo de nitrógeno había ahora oxígeno (una transmutación como la que habían soñado los alquimistas), Rutherford propuso (1919) que el núcleo de hidrógeno estaba constituido por una sola partícula subatómica de carga eléctrica equivalente a la del electrón: el protón.

Razonamientos ulteriores llevaron a Rutherford a conjeturar la existencia de otra partícula subatómica que sería eléctricamente neutra y de masa equivalente a la del protón para explicar las características de la partícula alfa, que poseía dos cargas eléctricas unitarias pero tenía una masa cuatro veces la del protón. Este “neutrón” tendría que esperar su comprobación experimental por parte de otro físico inglés[5], James Chadwick, en 1932.

Ya en 1930 se sabía que el bombardeo de ciertos elementos livianos (litio, boro, berilio) con partículas alfa daba lugar a una radiación muy penetrante. Al principio se pensó que se trataba de rayos gama (radiación electromagnética pura, fotones de alta energía), pero experimentos realizados por los Joliot-Curie (1932) mostraron que la incidencia de partículas alfa sobre sustancias con alta proporción de hidrógeno (parafina, por ejemplo), desataba la emisión de protones muy energéticos que no podía ser explicada como radiación gama. En este mismo año Chadwick hizo los experimentos definitivos. En mayo de 1932 envió para su publicación “La existencia de un neutrón” a Proceedings of the Royal Society, artículo en el que se refirió a los experimentos de los Joliot-Curie y los anteriores de Bothe y Becker. Allí dice Chadwick: “Es evidente que debemos, o abandonar la aplicación de la conservación de la energía y el momento en estas colisiones, o adoptar otra hipótesis acerca de la naturaleza de la radiación. Si suponemos que la radiación no es una radiación cuántica, sino que consiste de partículas de masa muy cercana a la del protón, desaparecen todas las dificultades asociadas con las colisiones, tanto respecto a su frecuencia como a la transferencia de energía a diferentes masas. A fin de explicar el gran poder de penetración de la radiación debemos además suponer que la partícula no tiene carga neta. Podemos suponerla consistente de un protón y un electrón en íntima combinación, el ‘neutrón’ discutido por Rutherford en su clase bakeriana[6] de 1920”. El Premio Nóbel de Física en 1935 fue concedido a Chadwick.

A estas alturas el submundo atómico parecía perfectamente organizado y explicado completamente. Protón, neutrón y electrón bastaban para justificar tanto la masa atómica como la distribución de cargas eléctricas del átomo, su “peso” y su “número” atómico[7]. No pasaría mucho tiempo antes de que razones teóricas y experimentales dieran cuenta de numerosas otras partículas subatómicas.

Sir Joseph John Thomson - Lord Rutherford - Sir James Chadwick: los explicadores del átomo

Como en el caso de la predicción del neutrón por parte de Rutherford, el próximo paso se dio asimismo en el reino de la teoría. Antes de que esta última partícula fuera descubierta ya P. A. M. Dirac había postulado la existencia de “antimateria”.

El primer aporte de Dirac (1927) consistió en adelantar una teoría relativista del electrón que tuvo éxito, entre otras cosas, al explicar el espín[8] del electrón. La teoría también anunciaba la existencia de “estados de energía negativa”. Para explicarlos Dirac echó mano del “principio de exclusión” de Pauli, que prohibía que dos electrones ocuparan el mismo estado—que tuvieran exactamente los mismos números cuánticos—en un átomo cualquiera. De aquí conjeturó (1930) que in vacuo los estados de energía negativa predichos por su teoría estarían ocupados por electrones, cuya remoción dejaría un “hueco” que Dirac mostró se comportaría como un electrón de carga positiva. En 1931 adujo que estos holes corresponderían a una nueva partícula positiva.

Al año siguiente Carl D. Anderson encontró la “firma” del electrón de carga positiva (positrón) en placas tomadas de una cámara de Wilson dispuesta en el Instituto Tecnológico de California (Caltech), de modo que detectara la influencia de rayos cósmicos (radiación gama de alta energía proveniente del espacio exterior a la Tierra). Las trayectorias descritas por la nueva partícula eran la imagen especular de las observadas para el electrón. Por cierto, el electrón y el positrón son creados en pareja por un rayo gama, y el proceso inverso, la aniquilación de ambas partículas por colisión directa de ambas, produce radiación gama.

Formación de un par electrón-positrón en una cámara de burbujas. Las livianas partículas describen espirales de dirección inversa en el campo magnético de la cámara.

Pero todavía la década del treinta alojaría otra sorpresa. Una vez más la teoría se adelantó a los experimentadores. En 1934 Hideki Yukawa predijo la existencia de partículas de masa intermedia ante el protón y el electrón, a las que se llamó mesones. La teoría de Yukawa buscaba explicar las fuerzas que mantienen el núcleo como una entidad integrada a pesar de que la electrostática exige que cargas eléctricas del mismo signo, como los protones, tiendan a repelerse. (La física actual interpreta interacciones como la electromagnética en términos de un intercambio de partículas. En el caso del electromagnetismo la partícula intercambiada es el fotón, que no posee masa. En el seno del núcleo se requiere una fuerza que pueda vencer la repulsión electrostática a distancias muy cortas, y esto fue lo que Yukawa proveyó con su teoría, al postular que las partículas del intercambio nuclear tienen masa mayor que cero, mayor que la del electrón, pero menor que la del protón o neutrón).

En 1937 Neddermeyer, Anderson, Street y Stevenson identificaron una nueva partícula de masa intermedia a la que se llamó muón (o mesón mu), otra vez en experimentos con rayos cósmicos en una cámara de Wilson. Equivocadamente se pensó que se trataba del mesón predicho por Yukawa, pero pronto se comprobó que los muones no participaban en las interacciones nucleares. El mesón pi, o pión, correspondiente a la partícula de Yukawa, fue descubierto diez años más tarde por Cecil Powell.

A partir de aquí el zoológico de partículas comenzó a poblarse de modo alarmante. El kaón o mesón K (1947), el antiprotón (de masa igual a la del protón y carga negativa, 1955), el neutrino (1956; predicho por Wolfgang Pauli en 1931, sin carga neta y masa cero; más exactamente el neutrino del electrón), el neutrino del muón (1962), la partícula J/ y (1974), la partícula tau (1975), la partícula upsilon (1977), el gluón (1979), los bosones[9] W y Z (1983, predichos veinte años antes por Glashow, Salam y Weinberg), el top quark[10] (1995), el neutrino tau (2000), aparecieron uno tras otro[11]. Para complicar más las cosas, hay partículas como los piones que vienen con carga positiva, negativa o neutra, y además cada una de las partículas tiene su respectiva “antipartícula”.

………

Entretanto proliferaban las partículas subatómicas y se hacía evidente la necesidad de un esquema simple que las organizara, la tecnología procedía en dirección de la energía nuclear útil, montada sobre la postulación de Einstein de que la masa de un cuerpo cualquiera podía ser transformada íntegramente en energía o, puesto de otro modo, que la masa y la energía eran entidades equivalentes, una sola y misma cosa.

Arthur Eddington opinó una vez que la mente humana tardó tanto tiempo para descubrir esta equivalencia entre masa y energía a causa de una diferencia particular de nuestros sentidos corporales. En efecto, la retina es capaz de captar el efecto generado por un solo fotón, que es una cantidad pequeñísima de energía. En cambio, el sentido del tacto, misericordiosamente, no es capaz de detectar presiones por debajo de algunos decigramos. Si no fuese por este hecho, la conciencia cerebral se vería abrumada por las señales provenientes de billones de partículas subatómicas que constantemente bombardean nuestra piel.

En todo caso, a partir de los hallazgos “alquimistas” de Rutherford, y sobre todo luego del descubrimiento del neutrón, en la década de los treinta comenzó una carrera por lograr elementos sintéticos de masa superior a la del uranio. La búsqueda teórica no imaginaba adonde conduciría la experimentación. Los competidores de esta carrera por un posible Premio Nóbel eran el propio Rutherford, Enrico Fermi, los Joliot-Curie y el equipo formado por Otto Hahn y Lise Meitner. Fue esta mujer austriaca la que concebiría en 1938 la “fisión” nuclear, mediante el bombardeo de núcleos de uranio con neutrones. Los experimentos se realizaron en el laboratorio de Hahn en Berlín, pero la explicación de los resultados fue proporcionada por Meitner, por ese entonces en Estocolmo en razón de ser judía. (Las piezas de la correspondencia entre Meitner y Hahn indican a las claras que éste no creía en la fisión nuclear y debió ser convencido por los razonamientos de ella). La era atómica había comenzado.

En la fisión del núcleo de uranio, un átomo de este elemento se divide para dar lugar a dos pedazos—un núcleo de bario y uno de kriptón—algunos neutrones y rayos gama[12]. Lise Meitner se dio cuenta de que a partir de un neutrón incidente sobre el núcleo de uranio se había obtenido varios neutrones, y que tal cosa podía en principio establecer una “reacción en cadena”: los nuevos neutrones impactarían otros núcleos de uranio para producir más neutrones y así sucesivamente. Esta característica de la fisión del uranio permitió el diseño de “reactores nucleares”—el primero en Chicago por Enrico Fermi y Leó Szílard en 1942—de reacción “controlada” y las bombas atómicas detonadas en 1945 como consecuencia del Proyecto Manhattan. (Alamogordo, Hiroshima, Nagasaki). LEA

Diagrama trasladado de una fotografía de cámara de burbujas que muestra “eventos” de creación de varios pares electrón-positrón y la trayectoria de otras partículas.

[1] Se acredita a Ernest Lawrence la invención del ciclotrón, un acelerador de partículas que las hace girar en espiral mediante la aplicación de un campo magnético. Un aparato más primitivo, el acelerador de Van de Graaff, empleaba la acumulación de enormes cargas de electricidad estática para generar grandes diferencias de potencial o voltajes (hasta un millón de voltios). En física de partículas se emplea una unidad de energía: el electrón-voltio, que corresponde a la que adquiere un electrón acelerado por una diferencia de potencial de un voltio. El ciclotrón alcanza energías de hasta 10 millones de electrón-voltios. Los aceleradores modernos (“lineares” de hasta 3 kilómetros como el de Stanford) o circulares (como el LHC—Large Hadron Collider—de CERN, con una circunferencia de 46 kilómetros), llegan a generar energías de hasta 7 teraelectrón-voltios. (1 tera = 1012, o un billón castellano). Dos haces de partículas enfrentadas producirán (2007) colisiones de 14 TeV.

[2] El tubo de rayos catódicos es la tecnología básica de un osciloscopio, donde un delgado haz de electrones puede moverse bajo la acción de cargas electrostáticas, dibujando así con ondas sobre la pantalla fosforescente las variaciones de voltaje. De allí vinieron también los primitivos tubos de radio y, más adelante, las pantallas de los televisores. Un tubo de rayos X es un tubo de Crookes modificado, y el descubrimiento de esta penetrante radiación representó para Wilhelm Röentgen el primero de los premios Nóbel de Física de la historia. (1901).

[3] Es la misma razón de las estelas que forman los aviones a reacción en la atmósfera superior a su paso en vuelo. La cámara de Wilson ha sido suplantada por la más precisa “cámara de burbujas”. En ésta, un recipiente lleno de hidrógeno o propano en estado líquido es sometido a haces de partículas cargadas, las que esta vez producen un rosario de burbujas formadas por ebullición local

[4] Detectan pulsos de luz emitidos por ciertos materiales bajo el impacto de partículas cargadas o fotones.

[5] Debe haberse notado que en el reino de lo atómico los físicos alemanes (Planck, Einstein, Heisenberg, etc.) aportaban la teoría, pero los ingleses descollaban como experimentalistas.

[6] Nombrada por Henry Baker, quien legara a la Royal Society en 1775 la cantidad de £100 para la conferencia de un miembro que la sociedad escogiese. Es la más prestigiosa conferencia en ciencias físicas en Inglaterra.

[7] Una vez que surgiera el concepto de número atómico, la organización de los elementos en una tabla periódica pudo limar pequeñas asperezas. Anteriormente (Mendelejeff) se ordenaba a los elementos por su peso atómico, y en unos pocos casos—por ejemplo el par argón-potasio, del que el argón es más pesado pero hoy se coloca antes del segundo en la tabla—no cuadraban las propiedades químicas. La ordenación por número de protones (o electrones) restituyó la consistencia a la tabla.

[8] El espín (castellanización de spin, giro) de una partícula subatómica designa su “momento angular”, y es una propiedad o “número cuántico” que permite agrupar a las partículas en familias de propiedades similares.

[9] Los bosones son partículas de espín +1 o –1 y se comportan según fórmulas estadísticas desarrolladas por Bose y Einstein. Los fermiones, como el electrón y el protón, exhiben espín de +1/2 o –1/2, y siguen la estadística Fermi-Dirac.

[10] Hablaremos de los quarks en la octava lección.

[11] Para la década siguiente a la actual se espera, una vez que entren en operación nuevos y mayores hiperaceleradores de partículas, detectar el llamado bosón de Higgs.

[12] El uranio radioactivo empleado para la fisión como “combustible” tiene 235 unidades de masa atómica, mientras que el bario tiene 138 unidades y el kriptón 84, para un total de 222 unidades de masa atómica. La diferencia de 13 unidades es convertida en neutrones (usualmente tres) y radiación gama.

por Luis Enrique Alcalá | Ago 6, 2006 | Física, Otros temas |

El corrimiento hacia el rojo. Hubble y la expansión del universo. Primera postulación del Big Bang. La hipótesis alterna de la creación continua o el steady state.

Todos hemos tenido la experiencia de escuchar la sirena de una ambulancia que se aproxima y nos pasa, para alejarse en pos de algún enfermo o herido. El tono de la sirena es más agudo en la aproximación y más grave en el alejamiento. El fenómeno se explica porque la frecuencia del sonido es percibida como más alta si la fuente se mueve en nuestra dirección (delante del móvil), al amontonarse las ondas en un espacio menor que estaría siendo “comprimido”. A la inversa, este espacio se expande cuando la fuente sonora se aleja (detrás del móvil), y el observador percibe un descenso en la frecuencia hacia tonos más graves.

El efecto Doppler acústico

El fenómeno descrito se conoce con el nombre de “efecto Doppler”, por Christian Andreas Doppler, quien lo postuló en 1842. Aunque Doppler lo propuso para la luz, la primera comprobación experimental se hizo en 1845 con ondas sonoras por el meteorólogo y químico holandés Christian Buys Ballot, quien empleó un grupo de músicos en un tren de Ámsterdam a Utrecht para causar el efecto. (En 1848, el año del Manifiesto Comunista, y de manera independiente, Hyppolite Fizeau, quien haría las más exactas mediciones de la velocidad de la luz en su época, descubrió el efecto Doppler en ondas electromagnéticas, y los franceses lo llaman por esto el efecto Doppler-Fizeau).[1]

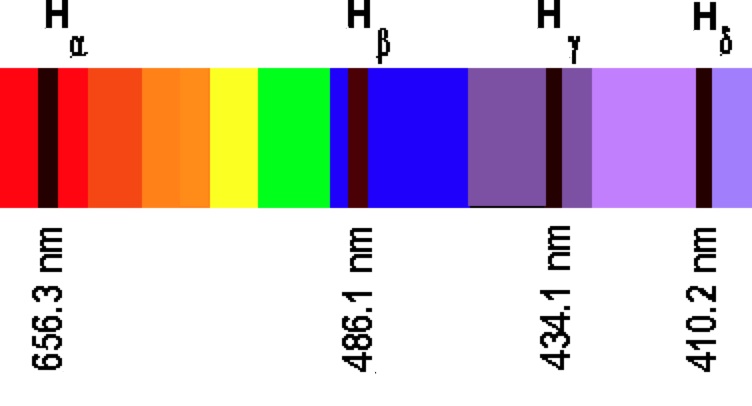

Estos descubrimientos tendrían, setenta años más tarde y en conjunto con los hallazgos de la espectroscopia química, una importancia enorme en el campo de la cosmología. En efecto, cada elemento químico absorbe luz en unas ciertas frecuencias específicas y propias, y este fenómeno se registra como líneas o bandas negras que interrumpen la gama de colores del espectro. Es decir, cada elemento químico pone su “huella digital” en el espectro que genera. Así, es posible determinar espectroscópicamente la composición química de un astro, a pesar de su distancia.

Espectro del hidrógeno. Sus líneas de absorción (a, b, g, d) aparecen en frecuencias específicas, correspondientes a longitudes de onda precisas expresadas acá en nanómetros. (1 nanómetro = 1/109 metros, o una mil millonésima de metro, que es lo mismo que lo que llamamos una milimicra). Mientras menor es la longitud de onda mayor es la frecuencia.

Para la época de la formulación de la teoría general de la relatividad (1916) varios astrónomos en Estados Unidos habían observado espectros de nebulosas y detectado en ellos un desplazamiento de las líneas de absorción espectrales en dirección al extremo del rojo. Campbell, Keeler y Slipher habían observado el fenómeno y derivado la conclusión correcta: las nebulosas eran fuentes luminosas en recesión o alejamiento y, tal como el sonido de la ambulancia, se percibía por tal razón un descenso en la frecuencia: las líneas espectrales se desplazaban hacia el rojo, la zona de menor frecuencia del espectro luminoso. Hasta ese entonces, no obstante, se pensaba que las nebulosas eran estructuras gaseosas constituyentes de nuestra propia galaxia, y los resultados no fueron interpretados en su significado pleno. En 1924, la noticia de que eran en realidad otras galaxias equivalentes a la nuestra, y por tanto estructuras mucho más lejanas, fue anunciada por el astrónomo (y abogado) Edwin Hubble, quien tuvo acceso al nuevo telescopio Hooker de 100 pulgadas del observatorio de Monte Wilson, en California.

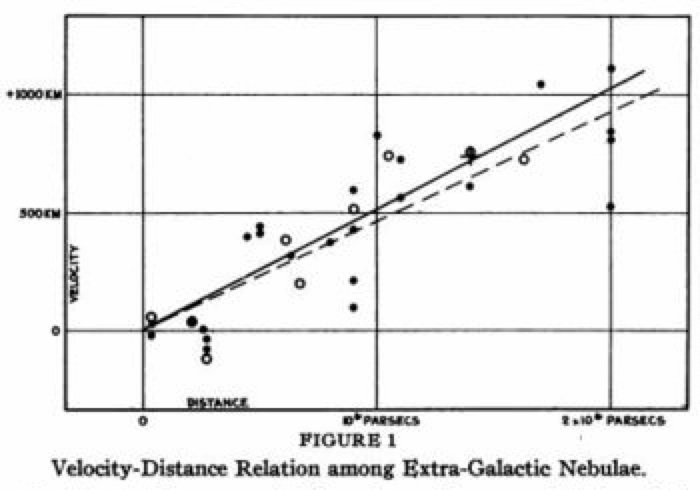

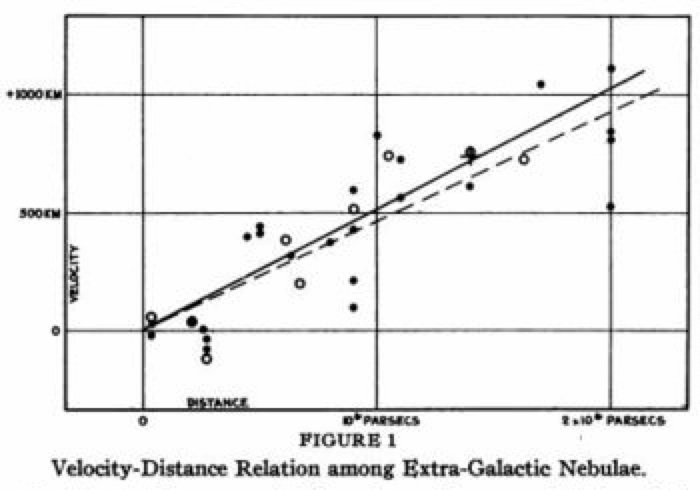

Luego, en equipo con Milton Humason, realizó mediciones de “corrimiento al rojo” de un grupo de galaxias, a las que incorporó las obtenidas por Slipher. Con estos datos Hubble y Humason encontraron una ley empírica que establecía que mientras más lejana era la galaxia mayor era su velocidad de recesión. (Mayor su corrimiento al rojo). Esta “ley de Hubble” fue anunciada en 1929. La relación entre distancia y velocidad venía dada por una constante (constante de Hubble, valor actual de 70 (km/s) Mpc. Mpc = megapársec).

Fuente en aproximación, corrimiento al azul

Fuente estacionaria, espectro normal

Fuente en alejamiento, corrimiento al rojo

El gráfico del trabajo original de Hubble y Humason. (Distancias en pársecs, velocidades en kilómetros por segundo. Un pársec es 3, 08 x 1016 metros, o 3,61 años luz).

El significado de la ley de Hubble sería provisto por la hipótesis adelantada dos años antes por el sacerdote, físico y astrónomo belga Georges Lemaître. En efecto, en 1927 Lemaître presentó para publicación en Annales de la Société Scientifique de Bruxelles, un trabajo revolucionario, en el que postulaba un universo en expansión. (Un Univers homogène de masse constante et de rayon croissant rendant compte de la vitesse radiale des nébuleuses extragalactiques).

La proposición chocaba contra los criterios de Einstein, que creía que su teoría general de la relatividad predicaba un universo estático. (De hecho, introdujo un parámetro en sus ecuaciones, “la constante cosmológica”, para que dieran ese resultado. Luego de conocer las mediciones de Hubble declaró que la introducción de la constante cosmológica había sido el mayor error de su vida). Tampoco Arthur Eddington se sentía cómodo con la teoría de Lemaître, aunque hizo traducir al inglés el trabajo del belga en 1930, y ese mismo año Lemaître dio una conferencia en Londres en la que por primera vez postulara su idea de un “huevo cósmico” o “átomo primitivo”, una singularidad en el tiempo y el espacio en el que toda la materia del universo estaría concentrada en un punto, cuya explosión habría dado origen al universo, desde entonces en expansión. Había nacido la teoría del “Big Bang”.[2]

El Big Bang desde la singularidad primigenia

La proposición de Lemaître daba perfecto sentido a la ley empírica de Hubble, al concebir un proceso físico que explicaba la observable expansión del universo, evidente en el alejamiento de las galaxias entre sí. Más de tres décadas transcurrirían antes de que otro resultado empírico reforzara la idea, que hoy por hoy es la más aceptada de las teorías sobre la formación del universo. Pero antes había que inventar la radioastronomía.

Siete años después de la conferencia en la que Lemaître había propuesto, bajo otro nombre, la ocurrencia del Big Bang, Grote Reber, un ingeniero de radio norteamericano, ensamblaba el primer radiotelescopio parabólico, basado en los trabajos del pionero Karl Jansky. Éste, que trabajaba para los Laboratorios Bell, había recibido la misión de detectar fuentes de electricidad estática que pudieran interferir con las transmisiones radiotelefónicas transatlánticas, y en 1933 consiguió una señal—un hiss o silbido constante—con un ciclo de intensidad máxima de 23 horas y 54 minutos, cuyo origen identificó en el centro de nuestra galaxia, en la dirección de Sagitario. Jansky propuso a los Laboratorios Bell la construcción de una “antena de plato” con un diámetro de treinta metros, para mediciones más finas, pero la compañía consideró innecesaria la inversión y Jansky fue asignado a otras cosas.

El plato de 305 metros de diámetro del radiotelescopio de Arecibo, Puerto Rico, que el autor de estas líneas sobrevolara en 1978. Es operado por la Universidad de Cornell, y ha sido empleado en la búsqueda de señales de inteligencia extraterrestre (SETI, Search for ExtraTerrestrial Intelligence), actividad a la que el astrofísico Carl Sagan dedicara un notable esfuerzo. Un ciudadano común y corriente puede hoy prestar su computador personal para la “computación distribuida” de la enorme cantidad de señales recibidas mediante la descarga de un software gratuito: SETI@home.

Reber, por su parte, que había querido trabajar en Bell Laboratories bajo Jansky sin conseguirlo, optó por construir en el patio de su casa una antena parabólica de nueve metros de diámetro, la que enfocaba su recepción sobre un radiorreceptor suspendido a ocho metros sobre el fondo del plato. Al año siguiente logró con un tercer modelo detectar ondas de radio del espacio exterior y confirmó el hallazgo de Jansky. A partir de aquí Reber se propuso construir un mapa de las fuentes de radio del espacio, obteniendo el primero en 1941. Su trabajo le convirtió en el padre fundador de la radioastronomía. A su muerte en 2002, sus cenizas fueron repartidas entre los principales observatorios de radioastronomía en el mundo.

El primer radiotelescopio construido por Grote Reber en 1937

Entretanto, los Laboratorios Bell continuaron con sus estudios de transmisión y recepción con antenas parabólicas. En 1964 Arno Penzias y Robert Wilson detectaron, con un receptor ultrasensitivo, ondas de radio provenientes del espacio exterior que eran no sólo más potentes que las provenientes del centro de la Vía Láctea, sino también isotrópicas: esto es, provenientes homogéneamente de todas las direcciones del cielo. La radiación equivalía a la producida por un “cuerpo negro” a 2,7 grados Kelvin. Discusiones del hallazgo con un grupo de la Universidad de Princeton concluyeron en que la radiación correspondía a la predicha por las teorías del Big Bang, que sostenían que el espacio estaría lleno por una radiación proveniente del origen del universo.[3]

Los resultados de Penzias y Wilson, anunciados en 1965, fueron honrados con el Premio Nóbel de Física en 1978, una vez que la comunidad científica aceptara su interpretación como restos del Big Bang, o “radiación cósmica de fondo”; en inglés, Cosmic Background Radiation, o CBR[4]. (Edwin Hubble había hecho campaña para que la astronomía fuera considerada una parte de la Física para propósitos del premio, cosa que ocurrió, pero sólo después de la muerte de Hubble en 1953). Junto con la expansión de Hubble, la CBR es el fundamento empírico más fuerte de la teoría de un comienzo del universo observado a partir de una “singularidad”.

Mapa de la radiación cósmica de fondo a partir de los datos ofrecidos este año por la NASA y obtenidos por WMAP (Wilkinson Microwave Anisotropy Probe), instrumento lanzado al espacio en 2001 que sustituyó al COBE (Cosmic Background Explorer) de 1989. La “anisotropía” de la radiación—el grado de su irregularidad—corresponde con gran precisión a lo predicho por una forma bastante aceptada en teorías del Big Bang: el modelo Lambda-CDM (Lambda-Cold Dark Matter). Esa irregularidad permitió la formación de estructuras como las galaxias.

Hoy en día, pues, es de aceptación prácticamente universal que el universo que observamos comenzó hace un poco más de 13 mil millones de años con la súbita expansión de una concentración singular de materia y energía. En 1949, Hermann Bondi, Thomas Gold y Fred Hoyle habían propuesto una teoría alterna, la teoría del “estado estable”, o steady state theory.

La teoría del estado estable postula que el universo, obviamente en expansión a partir de las observaciones de Hubble, mantiene sin embargo su aspecto de conjunto porque constantemente se estaría creando materia. (Es una solución distinta a la propuesta originalmente por Einstein de un universo estático). Esta teoría tenía la “ventaja” de no requerir un origen del universo, y como la cantidad de creación de materia requerida por los datos era muy pequeña, durante la década de los cincuenta tuvo tantos adeptos como la teoría del Big Bang. En la actualidad sólo muy pocos cosmólogos la sostienen, pues la mayoría de ellos se ha pasado a las filas de Lemaître. El físico inglés Stephen Hawking escribió su epitafio, al decir que el descubrimiento de la radiación cósmica de fondo era “el último clavo en la urna de la teoría del estado estable”.

Es seguramente inevitable relacionar la teoría del Big Bang con las cosmogonías de origen religioso, que describen prácticamente todas—Islam, judaísmo, zoroastrismo, hinduismo (Rig Veda)—un origen del universo. Tan poderosa asociación era incómoda para una ciencia que, si no es atea, por lo menos quiere mantenerse alejada de temas teológicos. Esto era lo que perturbaba a Einstein—quien finalmente la aceptó—y lo que motivó a los proponentes de la teoría del estado estable o “creación continua”.

Refinamientos ulteriores de la teoría del Big Bang serán cubiertos en la Lección 10. LEA

Georges Lemaître con Einstein en 1933

Edwin Hubble ante la cámara del Telescopio Hooker en Monte Wilson

[1] El descubrimiento o la postulación independiente y casi simultánea de algún fenómeno o ley es asunto común en ciencia y tecnología, y a veces conduce a disputas agrias por el honor de la primacía. La más famosa controversia de esta clase se dio en torno a la invención del cálculo diferencial, que Newton y Leibniz desarrollaron independientemente. La ley que relaciona volúmenes y presiones de los gases es la de Charles-Gay Lussac; mientras que la que relaciona volúmenes y temperaturas es la de Boyle-Mariotte y, como hemos visto, la idea de la contracción de los cuerpos en movimiento se conoce como contracción de Lorentz-FitzGerald.

[2] El término “Big Bang”, la “Gran explosión”, se debe al astrónomo británico Fred Hoyle, quien trató a Lemaître, Él mismo era partidario de la teoría de la creación continua, o steady state, que propone un universo que se mantiene constante por la continua creación de materia. Su intención al proponer el nombre era burlarse de George Gamow, decidido defensor de las ideas de Lemaître. Hoyle ha sido igualmente un eficaz divulgador de ciencia y un exitoso autor de ciencia-ficción. (Su más famosa novela: The Black Cloud).

[3] Aún antes de las predicciones derivadas de una teoría del Big Bang, Arthur Eddington había estimado una temperatura promedio del universo de alrededor de 3º K en 1926. George Gamow, creyendo que la edad del universo era de 3.000 millones de años, postuló en 1946 una temperatura de 50º K. Hoy en día se acepta la cifra de 13.700 millones de años, y se obtiene la temperatura registrada por Penzias y Wilson suponiendo que proviene del enfriamiento de una temperatura de los fotones de 3.000º K cuando habían transcurrido unos 400 mil años desde el Big Bang.

[4] Más comúnmente se le designa por las siglas CMB, por Cosmic Microwave Background radiation.

por Luis Enrique Alcalá | Ago 5, 2006 | Física, Otros temas, Política |

La fisión nuclear y la bomba de hidrógeno. El mecanismo básico de la energía estelar y la evolución de una estrella. Diagrama de Hertzsprung-Russell y la secuencia principal. Radio de Schwarzschild y límite de Chandrasekhar. Enanas blancas, estrellas neutrónicas (pulsares) y agujeros negros. Noción de singularidad.

El año de 1945 resultó ser crucial en el desarrollo de la energía atómica de uso militar. El 16 de julio de 1945, casi exactamente a las 5:30 a.m. (hora local) los Estados Unidos detonaron en el desierto de Álamogordo, en Nuevo México, el primer artefacto nuclear de la historia, una bomba de plutonio que alcanzó la potencia explosiva de 20 kilotones.[1] Tres semanas más tarde, el 6 de agosto, estallaba sobre Hiroshima la primera bomba atómica de la guerra, esta vez de uranio, y tres días después otra bomba de plutonio destruía el puerto de Nagasaki. Estos eventos produjeron el inmediato fin de la Segunda Guerra Mundial, pues Japón accedió al ultimátum de rendición inmediata e incondicional, sin otra petición que la de que se respetara la majestad del emperador Hirohito.

La formación de la bola expansiva de la bomba explotada en Álamogordo cuando aún no habían transcurrido más de 25 milésimas de segundo desde la detonación.

Los artefactos detonados eran todos de fisión nuclear, el fraccionamiento de átomos de uranio o plutonio con una enorme liberación de energía. El desarrollo tecnológico necesario había comenzado en los Estados Unidos justo al comienzo de la guerra, a raíz de una famosa carta enviada a Franklin Delano Roosevelt por Albert Einstein.

La carta firmada por Einstein el 2 de agosto de 1939 había sido redactada mayormente por Leo Szilard, un físico húngaro que junto con sus compatriotas Edward Teller y Eugene Wigner, temía que Alemania utilizara la fisión nuclear para la fabricación de bombas atómicas. Roosevelt recibió la carta un mes después, justamente al inicio de la Segunda Guerra Mundial, que comenzó con la invasión de Polonia por las fuerzas de Hitler el 1º de septiembre. Roosevelt ordenó la formación del “Comité del Uranio”, que inició investigaciones que al principio marcharon con lentitud, si les compara con las emprendidas por los británicos y los alemanes. Poco antes del ataque a Pearl Harbor, el programa alcanzó su aceleración final, luego de que Vannevar Bush[2] influyera decisivamente sobre Roosevelt.

Un hito del programa lo constituyó la operación segura del primer reactor atómico, bajo la dirección de Enrico Fermi (asistido por Szilard), en un sótano de la Universidad de Chicago.[3] El 2 de diciembre de 1942 se logró la reacción en cadena controlada. Una llamada telefónica del físico Arthur Compton a James Conant (el jefe de Vannevar Bush) anunció en código: “El navegante italiano ha llegado al nuevo mundo. Los nativos son amistosos”. La frase era una clara alusión a Cristóbal Colón, pero también a la nacionalidad de Fermi. El comentario sobre los nativos hacía referencia a la reacción controlada, ofreciendo la buena nueva de que Fermi y sus colegas, así como buena parte de Chicago, no habían sido vaporizados por una reacción fuera de control convertida en explosión.

Para que se produzca una reacción en cadena—bombardeo de material fisionable por neutrones que genera una cascada de neutrones que continúa rompiendo átomos—es preciso contar con una “masa crítica”. En el caso del uranio 235 esa cantidad es de más o menos cincuenta kilogramos; para el plutonio 239 la cantidad es menor: bastan diez kilogramos. Por debajo de estas masas no se sostiene la reacción en cadena.

Fermi contaba, obviamente, con suficiente uranio para formar una masa crítica, y también con mecanismos de control. En primer lugar, los neutrones “lentos” son más eficientes para causar la fisión, y el grafito es un material que convierte neutrones energéticos en neutrones lentos. Luego, es preciso controlar el flujo de neutrones para que se dé una reacción en cadena que no se convierta en explosión. En el primer reactor de Chicago[4] se empleó tubos revestidos de cadmio, que es un eficaz absorbedor de neutrones. La introducción de estos tubos al seno del reactor reduce el flujo de neutrones, y su extracción lo aumenta.

El desarrollo de las armas propiamente dichas se hacía en otra parte. Las bombas no activas debían mantener separadas dos masas subcríticas que juntas harían una masa crítica. Así, se diseñó un cañón interno para la bomba de uranio (Hiroshima), que en el momento de la detonación disparara una masa subcrítica contra la otra. Para las bombas de plutonio (Álamogordo, Nagasaki) se usó más bien la compresión de una masa subcrítica en condiciones normales, mediante un dispositivo de “implosión” con cargas concéntricas. En ambos casos la fisión de átomos y la emisión de nuevos neutrones crecen exponencialmente.

En 1949 la Unión Soviética detonó su primera bomba atómica, y esto a su vez llevó a Harry Truman a ordenar el desarrollo acelerado de un segundo tipo de bomba nuclear: la bomba de hidrógeno, bomba de fusión o bomba termonuclear, cuyo más ardiente promotor era Edward Teller. Así, en 1950 Teller—un carácter difícil—asumió el liderazgo del nuevo programa. En colaboración no siempre tersa con el polaco Stanislaw Ulam, arribó a un diseño práctico en 1952. La primera bomba termonuclear fue detonada el 1º de noviembre de ese año en el atolón de Enewatak, en el océano Pacífico, con un rendimiento de 10,4 megatones.

“Ivy Mike”, el primer dispositivo termonuclear detonado por el hombre. Produjo un cráter de 2 kms. de diámetro e hizo hervir las aguas circundantes durante las próximas doce horas, además de derramar escombros coralinos radioactivos sobre buques estacionados a 45 kms. de la explosión.

Las bombas termonucleares fundamentan su enorme rendimiento energético en la reacción exotérmica—que produce energía—de la fusión de cuatro protones (núcleos de hidrógeno) para formar un núcleo de helio (partícula alfa, compuesta por dos protones y dos neutrones). En el proceso se emiten dos positrones (cada uno retira la carga eléctrica positiva del protón para convertirlo en un neutrón) y dos neutrinos[5] junto con una enorme liberación de energía. Para que los protones puedan vencer la repulsión electrostática que tiende a separarlos, su aproximación se realiza con la explosión “primaria” de una bomba de fisión alojada junto con el combustible fusionable. (Hidrógeno líquido). La terrible bomba atómica, que asoló las ciudades japonesas en 1945, había quedado reducida al papel de mero fulminante en una bomba muchísimo más poderosa. (Las bombas de 1945 alcanzaron una potencia de 20 kilotones, y en general los artefactos de fisión nuclear pueden llegar a rendir hasta 500 kilotones. Una bomba de hidrógeno moderna puede rendir fácilmente 500 megatones, o lo equivalente a la explosión de 500 millones de toneladas de TNT, y para activarse necesita alcanzar la temperatura de 3 millones de grados Kelvin que proporciona la bomba atómica que la enciende).

………

La energía liberada por humanos en los atolones del Pacífico es liliputiense en comparación con la cotidiana emisión energética de estrellas como nuestro Sol. Es precisamente la fusión de núcleos atómicos el motor que produce tan gigantesca radiación. Otra vez Arthur Eddington se adelantó con la proposición, en 1920, de que la energía proveniente del Sol sólo podría obtenerse de la fusión de hidrógeno para producir helio. Después de aportes de George Gamow, Hans Bethe y Carl von Weizsäcker, finalmente se obtuvo un cuadro bastante completo de lo que ocurre en el interior de las estrellas con el trabajo de Burbidge, Burbidge (marido y mujer), Fowler y Hoyle en 1957. (The B2FH paper).

En las estrellas más pequeñas que nuestro Sol (de tamaño intermedio) sólo ocurre la fusión de hidrógeno para formar helio; en estrellas de tamaño mediano el helio puede fusionarse para obtener carbono y oxígeno, y en sucesivas fusiones pueden llegar a formar átomos de hierro. Se necesita estrellas de mayor tamaño, capaces de alcanzar mayores temperaturas, para formar los elementos más pesados.

La evolución de las estrellas desde su formación hasta su muerte depende esencialmente de su tamaño inicial. Las estrellas se forman de la fragmentación y condensación de gigantescas nubes gaseosas—nubes moleculares—formadas en su mayor parte por hidrógeno (protones), en menor medida por helio y algo de metales. Estas enormes formaciones tienden a colapsar bajo la acción de la gravedad, y esta contracción aumenta su temperatura hasta alcanzar unos 50.000 grados Kelvin, lo que permite el inicio de la fusión nuclear. Dependiendo de la masa de la protoestrella, el nuevo astro seguirá uno de varios caminos evolutivos posibles.

Gigantescas nubes moleculares en la nebulosa del Águila de la constelación de la Serpiente. (Cerca de Virgo y Libra). Es de este tipo de nubes que se forman estrellas. Fotografiadas por el telescopio espacial Hubble. (NASA).

El camino es diferente si la nueva estrella es de una masa intermedia, como la de nuestro Sol, o si es mucho mayor o mucho menor. En el caso de una estrella de masa cercana a la de nuestro astro local, la fusión de hidrógeno la hace ingresar a la “secuencia principal”, en la que permanecerá por miles de millones de años quemando hidrógeno. El término “secuencia principal” alude a una ruta dibujada en un útil diagrama conocido como diagrama de Hertzsprung-Russell, que ubica a las estrellas en un plano cuyo eje de ordenadas mide la luminosidad de la estrella (o su color o clase espectral), y el eje de abscisas su temperatura. Creado entre 1911 y 1913 por Ejnar Hertzsprung, un químico y astrónomo danés, y Henry Russell, un astrónomo norteamericano, el diagrama HR se convirtió rápidamente en un instrumento de gran ayuda para la comprensión de la evolución estelar. (Naturalmente, la escala temporal de la evolución de una estrella es muchas veces mayor que la de la evolución humana, por lo que la primera se comprende a partir de observaciones de muchas estrellas distintas, cada una en una fase particular de su evolución).

Un diagrama de Hertzsprung-Russell simplificado. Las estrellas tienden a caer únicamente en ciertas regiones del diagrama. La secuencia principal se desplaza diagonalmente, desde las más jóvenes y luminosas estrellas de arriba a la izquierda, a las menos luminosas y calientes de abajo a la derecha. Las enanas blancas aparecen abajo a la izquierda y las gigantes rojas arriba y a la derecha de la secuencia principal.

Una vez que una estrella promedio se encuentra en la secuencia principal pasará en ella las nueve décimas partes de su vida, convirtiendo hidrógeno en helio dentro de su núcleo, y emitiendo radiación al exterior desde el manto que lo cubre. Es la presión ejercida por la reacción nuclear en su seno lo que contrarresta la enorme presión gravitacional, y mientras este equilibrio existe se detiene el colapso que la había iniciado a partir de la nube molecular. El helio producido, en razón de su mayor densidad, se acumula paulatinamente en el centro de la estrella. A partir de cierta cantidad interfiere con la fusión del hidrógeno restante, y se habla del envenenamiento por helio.

A partir de este momento la estrella reinicia su colapso gravitacional, hasta que la temperatura asciende hasta unos 100 millones de grados, momento en que es suficiente para iniciar la fusión de átomos de helio para producir carbono y oxígeno. El hidrógeno remanente en capas adyacentes al núcleo añade más radiación, y como la masa de la estrella ya es menor[6], su manto se expande y la estrella crece para entrar en fase de “gigante roja”. El color de estas estrellas se debe a que la expansión enfría el manto y la radiación es entonces menos energética.

Si la estrella es lo suficientemente masiva en su origen (unas 8 masas solares), al agotarse el helio volverá a contraerse y aumentar más la temperatura, lo que a su vez permitirá que se inicie la fusión de átomos de carbono. Al llegar al hierro este proceso de sucesivas fusiones de elementos más pesados se detiene, y el núcleo de la estrella exhibe una estructura en “capas de cebolla”.

Las capas sucesivas en el núcleo de una estrella, una vez que se ha producido la sucesión de fusiones de elementos progresivamente más pesados y poco antes de su colapso final.

Si, por lo contrario, la estrella original era pequeña (menor que 0,5 masas solares), nunca habrá temperatura suficiente para que la fusión de helio se inicie, y la estrella permanecerá por mucho tiempo (se calcula que hasta 50.000 millones de años) en forma de enana blanca. El astrofísico hindú Subrahmanyan Chandrasekhar calculó un límite de masa—límite de Chandrasekhar—a partir del cual la estrella no puede contrarrestar su colapso gravitatorio, por lo cual ésta procede a formar una estrella de neutrones (púlsar) o un agujero negro. El límite, 1,44 masas solares, es el tamaño máximo que puede tener una enana blanca. Una enana blanca tiene una densidad muy grande, pero mayor aún es la densidad de una estrella neutrónica, y todavía mucho mayor es la de un agujero negro.

Una estrella neutrónica se forma cuando la masa de la estrella es superior a 8 masas solares. Al agotársele el combustible nuclear explota como una supernova (de gran luminosidad instantánea) y el remanente estelar tiene una densidad tan grande—un centímetro cúbico pesa más de 24.000 kilos—que los protones y los electrones se combinan para formar neutrones. En 1967 Anthony Hewish y Jocelyn Bell descubrieron un tipo de estrella que emitía pulsos de radiación a intervalos regulares[7]. (Púlsar, o pulsating star). Poco después se explicó a los púlsares como estrellas neutrónicas. Provistas de muy intensos campos magnéticos, las estrellas neutrónicas giran a buena velocidad emitiendo radiación por sus polos magnéticos, y son como faros giratorios siderales. La brevedad de los períodos de rotación indica que los púlsares tienen un diámetro de pocos miles de kilómetros[8].

Pero queda todavía un destino diferente y más dramático para estrellas de masas aún mayores que las que formarían una estrella neutrónica. Se trata de la formación de agujeros negros, de tan enorme densidad, que su atracción gravitacional determina una “velocidad de escape” igual o superior a la de la velocidad de la luz[9]. En este caso, nada que esté por dentro del “horizonte de eventos” que rodea al agujero negro, ni siquiera los fotones, podría salir al exterior. Este horizonte viene determinado por un radio calculado por Karl Schwarzschild poco después de que Einstein publicara su teoría general de la relatividad, y depende de la masa del objeto: