por Luis Enrique Alcalá | Ago 4, 2006 | Física, Otros temas |

La ordenación del zoológico atómico mediante la postulación de los quarks de Murray Gell-Mann. El modelo estándar de las partículas. La unificación de electromagnetismo y las interacciones “fuerte” y “débil”. Máseres y láseres. Un éxito diferido de Einstein. Noción general de holografía.

En la época del surgimiento de los Beatles, la difusión de la ideología hippie, la presidencia y muerte de Kennedy, el Concilio Ecuménico; en la muy especial década de los sesenta, la Física, especialmente la física de partículas, estuvo muy activa, y su logro principal estuvo en el ordenamiento del zoológico de las partículas subatómicas, que después de un breve remanso de simplicidad inicial, se nutrió rápidamente con más de doscientas instancias diferentes. El protón, el antiprotón, el electrón, el antielectrón (positrón), el neutrón, el antineutrón, el fotón, el mesón Pi (pión, en sus varios tipos), el mesón K (kaón, también de diversos tipos), los diferentes tipos de neutrinos, los hiperones, la partícula Lambda, etcétera, dejaban rastros numerosos en las placas fotográficas de las cámaras de burbuja de los aceleradores de partículas en el mundo. Esta situación motivó esfuerzos por clasificar, primero, y luego explicar la variedad.

El héroe indiscutido de este emprendimiento es Murray Gell-Mann[1] (Premio Nóbel de Física de 1969), un niño prodigio con gran sentido del humor y una memoria fotográfica, que postuló primero—independientemente también Yuval Ne’eman—el camino óctuple como esquema de clasificación y poco después la hipótesis de los quarks que hoy forma el núcleo del Modelo Estándar de la física de partículas.

Antes del trabajo de Gell-Mann había sido posible distinguir entre dos familias de partículas: unas que se comportaban con arreglo a la “estadística de Fermi-Dirac”, los llamados fermiones; otras cuya distribución energética sigue las reglas de la “estadística de Bose-Einstein”, o bosones[2]. Los fermiones siguen el llamado “principio de exclusión de Pauli”: sólo una partícula puede ocupar un cierto “estado cuántico” en un momento dado. (No puede haber dos fermiones con el mismo conjunto de “números cuánticos”. Un número cuántico describe las energías de las partículas en un átomo. Para un electrón, por ejemplo, se considera el número cuántico principal, el número cuántico azimutal, el número cuántico magnético y el espín, o número cuántico de momento angular). El protón, el neutrón, el electrón, son todos fermiones, con espín 1/2; el fotón es un caso de bosón, con espín 1.

El estudio por Gell-Mann de una clase de partículas conocidas como hiperones (y también los kaones) llevó a formular la existencia de una nueva cualidad cuántica, cuyo nombre ya mostraba la tendencia poético-humorística de los físicos de la época: extrañeza. (Strangeness). La clasificación de estas partículas se entendía mejor si se les atribuía una propiedad, la extrañeza, que se conservaba en ciertas interacciones. (Los kaones y ciertos hiperones siempre son creados en pares, lo que sugería que esa propiedad estaba sujeta a una ley de conservación o simetría, como en el caso de la ley de la conservación de la energía).

Ya para ese momento la Física lograba distinguir tres clases de “fuerzas” (interacciones) en el seno del átomo. (Donde la cuarta interacción fundamental, la gravitación, no toma parte). Éstas eran la interacción electro-magnética (unificación de Maxwell de las interacciones antaño consideradas independientes: electricidad y magnetismo), responsable básicamente de la atracción entre los protones del núcleo atómico y su corona de electrones; la interacción “fuerte”, a la que se debe la atracción entre los nucleones (partículas que forman el núcleo, como los protones y neutrones); la interacción “débil”, causante del fenómeno conocido como radiación o decaimiento “beta”. (Emisión de electrones o partículas beta desde el interior de un átomo).

Adicionalmente, según la masa de las partículas, se las consideraba fundamentalmente de tres tipos: bariones (pesadas, como el protón o el neutrón), leptones (livianas, como el electrón), y mesones (de masa intermedia, como el pión y el kaón). Los bariones, por su parte, son fermiones, así como el electrón (y también el muón y la partícula Tau, ambos leptones como el electrón) mientras que los mesones son bosones. Finalmente, se tiene por hadrones a las partículas que, como el protón y el neutrón, experimentan la interacción fuerte.

Hasta allí la posibilidad de taxonomía antes de los trabajos de Gell-Mann, pero lo taxonómico no es, por supuesto, una explicación. Antes de que la explicación fuera posible había que añadir estructura a la clasificación, la que vino proporcionada por el esquema de camino óctuple.

Dos octetos (en el centro de cada diagrama hay dos partículas) de Gell-Mann. A la izquierda el de los mesones; a la derecha el grupo (bariones) al que pertenecen el neutrón (n) y el protón (p).

Agrupando las partículas según su carga eléctrica y su espín, Gell-Mann logró obtener dos organizaciones en octetos para mesones y bariones (de espín 1/2), y asimismo un decuplet (diez partículas) de bariones más masivos (con espín 3/2). (Partículas delta, partículas sigma, etcétera). El vértice de esta decena correspondía una partícula no detectada hasta entonces. Gell-Mann pronosticó (1962) que tendría una masa de 1.680 eV/c2, carga eléctrica unitaria negativa y un número cuántico de extrañeza de –3, y propuso el nombre de omega-menos para la partícula predicha. Dos años más tarde un acelerador en Brookhaven lograba identificar una partícula con esas características, lo que dio gran credibilidad al esquema del camino óctuple[3] de Gell-Mann y Ne’eman.

La decena de los bariones de espín 3/2, que sugirió a Gell-Mann la predicción de la partícula omega-menos dos años antes de su observación experimental. Los niveles horizontales corresponden al número cuántico de extrañeza (desde 0 hasta –3), mientras que la disposición diagonal corresponde a la carga eléctrica. (De –1 hasta 2).

El siguiente paso consistió en la formulación de una hipótesis revolucionaria, pues postulaba una estructura interna de los bariones como el protón y el neutrón, y de los mesones; es decir, éstas no serían partículas verdaderamente elementales. Más abajo estarían los quarks[4] ¡que tendrían carga eléctrica fraccionaria![5]

El “Modelo Estándar” surgido de la hipótesis de la existencia de quarks[6] ha logrado simplificar de nuevo el mundo de las partículas subatómicas. Para esto los agrupa en tres “generaciones” de partículas: la primera generación se compone de los quarks “arriba” (up o u) y “abajo” (down o d), el electrón y el neutrino del electrón. Con esta generación se forma toda la materia ordinaria: los bariones se componen de tres quarks y los mesones de un quark y un antiquark.

El quark u tiene una carga eléctrica de 2/3; el quark d una de –1/3. Esto permite concebir un protón como formado por dos quarks u y un quark d. (La suma de las cargas es 2/3 + 2/3 – 1/3 = 4/3 – 1/3 = 3/3 = 1). El neutrón estaría formado por un quark u y dos quarks d. (2/3 – 1/3 – 1/3 = 0) y por eso no posee carga eléctrica. Los quarks son en sí mismos fermiones; es decir, su espín es 1/2 o –1/2.

En cambio, el mesón K+ se compone de un quark u y un antiquark d. Como los antiquarks ostentan números cuánticos inversos, el antiquark d tiene carga eléctrica = -(-1/3) = 1/3. Por tal razón el mesón tiene K+ carga eléctrica positiva unitaria. (2/3 + 1/3).

De la misma manera se obtiene la composición de todos los hadrones ordinarios. (Partículas afectadas por la interacción fuerte). Otras partículas requieren la intervención de las dos restantes generaciones de partículas, que a su vez incluyen cada una dos quarks (y sus respectivos antiquarks) distintos de u y d. Estos otros quarks son “encanto” (charm) y “extraño” (strange), y la pareja formada por “fondo” (bottom) y “cima” (top).

La teoría del Modelo Estándar es lo que se conoce como una “teoría de calibración”. (Gauge theory). En esencia requiere la noción de “partículas virtuales” que, intercambiadas por las partículas “normales”, equivalen o dan origen a una fuerza atractiva. Estas partículas son los siguientes bosones : el fotón, la partícula W – , la partícula W + y la partícula Z0. Éstos son los bosones de la interacción electromagnética (el fotón) y la interacción débil. (Los restantes). La interacción fuerte requiere un bosón diferente, al que se llama gluón.

Así como Maxwell fue capaz de unificar electricidad y magnetismo en una sola fuerza o interacción, las interacciones electromagnética y débil fueron unificadas en los trabajos de Sheldon Glashow, el pakistaní Abdus Salam[7] y Steven Weinberg, que compartieron el Premio Nóbel de Física en 1979 por este logro. Según la teoría “electro-débil”, a energías de 100 GeV o superiores ambas interacciones se funden en una sola. Tanto esta teoría como la “electrodinámica cuántica” (la que explica las interacciones electromagnéticas a nivel subatómico) son compatibles con la teoría especial de la relatividad. Asimismo, las teorías de “gran unificación” (GUTs) han tenido éxito en unificar la teoría de la interacción fuerte—“cromodinámica cuántica”, (el “color” es una propiedad de los quarks)—y la electro-débil.

Sólo una de las cuatro interacciones fundamentales, la gravitación, falta por unificarse. Como se observó, las unificaciones han tenido éxito en la compatibilización de la física cuántica y la teoría especial de la relatividad, pero todavía no hay una “teoría cuántica de la gravitación”. Nadie ha observado los “gravitones”, la partícula teórica que mediaría la fuerza de gravedad, como el fotón lo hace con la fuerza electromagnética. A los esfuerzos en esta dirección se les conoce como TOEs (Theories Of Everything). Es lo que buscó Einstein hasta el fin de sus días con su “teoría del campo unificado” y Heisenberg con su “ecuación universal” de la Física. Hoy en día, la llamada “teoría de cuerdas” (String Theory) es la más fuerte candidata a lograr la unificación final, pero a costa de suposiciones que parecen haladas por los cabellos. (Por ejemplo, requiriendo diez u once dimensiones espacio-temporales, en lugar de las cuatro del continuo-espacio tiempo de la relatividad).

De hecho, la simplificación del zoológico de las partículas subatómicas y las interacciones entre ellas ha requerido la aplicación de estructuras matemáticas cada vez más complejas. (Esto solo habría hecho sospechar a Einstein, quien solía decir que Dios era refinado pero no malicioso. Raffiniert ist der Herr Gott aber boschaft ist Er nicht). Las estructuras de esta física de partículas corresponden a la llamada “Teoría de Grupos”—un grupo es un conjunto de números y la definición de una operación matemática que se les aplica—y sirven, sin duda, como malla conceptual lanzada sobre la realidad. Usualmente definen una “simetría” que se conserva en las distintas interacciones.

Una característica particularmente incómoda del Modelo Estándar es su requerimiento de que los quarks estarán siempre en confinamiento. Esto es, que no podrían ser observados aisladamente, pues estarían confinados al interior de los hadrones. Filosóficamente hablando, esto es una fea mancha de la teoría, pues postula un inobservable, postula entidades que jamás podrían ser observadas. Una cosa tal sería rechazada frontalmente por el más positivista de los físicos, Ernst Mach, y por su discípulo, Albert Einstein.

Además de estas dos debilidades—la ausencia de conexión con la gravitación relativista y el inobservable del confinamiento—el Modelo Estándar, desarrollado entre 1970 y 1973, ha entrado en problemas por sus predicciones relativas a la masa de los neutrinos. El modelo predice una masa nula para estas partículas, y recientes experimentos (1998) parecen indicar que aunque esta masa es pequeñísima, no es realmente cero. Hay además, algunas lagunas en la compatibilización del modelo con observaciones de nivel cosmológico.

A pesar de estos inconvenientes, el Modelo Estándar ha sido extraordinariamente exitoso, al predecir con gran precisión partículas no detectadas antes y sus características fundamentales. Por poner un caso, el modelo predijo la existencia del bosón Z, adjudicándole una masa de 91,1874 GeV; la masa observada de esta partícula ha resultado ser de 91,1876 GeV. Se ha pretendido subsanar algunos de estos y otros inconvenientes a través de teorías que han traído más problemas que soluciones. Por ejemplo, mediante la postulación de que los quarks tampoco serían partículas fundamentales, sino que a su vez estarían formados por partículas, los preones, todavía menores. And the beat goes on.

Familias (3) de partículas elementales

………

En el reino de lo tecnológico, por otra parte, la misma década de los sesenta asistía a la irrupción de un invento que hoy en día es para nosotros familiar y cotidiano: el rayo láser. El primero de ellos fue demostrado justamente en 1960, por Theodore Maiman, sobre trabajos de Charles Townes y Arthur Schawlow. El láser, y el máser que lo precediera, hacen uso de un fenómeno anticipado por Einstein en 1916.

Los términos láser y máser son acrónimos: este último viene de la contracción de Microwave Amplification by Stimulated Emisión of Radiation; láser, en cambio, nos habla de Light Amplification.

Cuando un electrón en la corona de un núcleo atómico da un salto cuántico desde un nivel más energético a uno de menor energía, emite un fotón que porta exactamente la energía correspondiente a la diferencia entre los niveles. Esta emisión puede ser espontánea, pero cuando es estimulada por incidencia de fotones sobre el material en cuestión se habla de emisión estimulada. (También puede absorberse un fotón para llevar a un electrón desde un nivel inferior de energía a uno superior).

Saltos cuánticos espontáneos y estimulados

En el caso de la emisión estimulada al fotón incidente se añade el segundo fotón emitido, por lo que el fenómeno se multiplica, en forma análoga a la de una reacción en cadena; la radiación incidente es “amplificada”. La propiedad más importante de la emisión estimulada, sin embargo, es que el fotón emitido tiene exactamente la misma frecuencia del fotón incidente y está en fase con él: esto es, las crestas y valles de sus ondulaciones coinciden exactamente. Por esta razón un rayo láser es monocromático (luz de una sola frecuencia), y además es coherente (ondas en fase). La exactitud de un máser, por ejemplo, es la particularidad que permite su empleo como “relojes atómicos”. (A estos fines se utiliza preferentemente el máser de hidrógeno).

El mecanismo básico del láser es exactamente el mismo del máser. Un láser produce radiación de mayor frecuencia (desde el infrarrojo hasta el segmento electromagnético de los rayos X). Por tal razón ha generado un mayor número de aplicaciones, desde la cirugía ocular hasta la excitación para fines de observación de átomos de sodio en la atmósfera, pasando por la tecnología de los discos compactos y los DVDs.

Rayo láser para excitar átomos de sodio en la atmósfera superior. Base de la Fuerza Aérea de los Estados Unidos en Kirtland, Nuevo México.

Una de las tecnologías potenciadas por el láser es la de la holografía, o producción de hologramas, fotografías que son capaces de reproducir la tridimensionalidad del objeto fotografiado. En la fotografía convencional, la placa o película registran sólo la intensidad de la luz (la amplitud de la onda) y su color (la frecuencia). Un tercer aspecto, que permite almacenar la información volumétrica, es la fase de las ondas luminosas. Con luz coherente del tipo láser, el choque y reflexión de superficies en planos distintos generará desfase en el rayo originalmente coherente. La descodificación de esta información con un rayo similar permite reconstruir la imagen tridimensional original. LEA

[1] Gell-Mann fue cofundador y director del Instituto de Santa Fe (Nuevo México), dedicado al estudio de la complejidad (complexity science) y es autor de un libro sobre este último tema: El quark y el jaguar. En una entrevista concedida a Scientific American dijo no ser una personalidad ni “apolínea” ni “dionisíaca”, sino un híbrido difícil que él llama “odiseico)”, lo que según reporta le ha causado más de un problema con sus colegas: “It’s a lonely place to be”.

[2] Por Enrico Fermi y P. A. M. Dirac en un caso, por Satyendra Nath Bose y Albert Einstein en el otro.

[3] El nombre fue escogido también para travesuras místicas de Gell-Mann, pues la misma designación de camino óctuple existe en el budismo para referirse a una ruta de desarrollo espiritual.

[4] Término tomado de Finnegan’s Wake, de James Joyce: “Three quarks for Muster Mark”.

[5] Una noción análogamente perturbadora vendría en la geometría fractal propuesta por Benoit Mandelbrot, en la que lo que se hace fraccionario es el concepto de dimensión. Esto es, hay estructuras geométricas que tienen, digamos, una dimensión mayor que 1 (la de una línea), pero menor que 2. (La de una superficie).

[6] Postulada independientemente por Gell-Mann y George Zweig. Este último había propuesto el nombre “ases” para las subpartículas, pero Gell-Mann ganó la batalla terminológica con sus quarks.

[7] Visitó a Venezuela en 1981 para recaudar—sin éxito—fondos a favor del Centro Internacional de Física de Trieste.

por Luis Enrique Alcalá | Ago 3, 2006 | LEA, Política |

La cosa se está poniendo muy fea en el entorno planetario. La geopolítica es ahora geotectónica. ¿Cómo evitar el choque de la placa continental de mil doscientos millones de musulmanes contra la de trescientos y tantos millones de estadounidenses? (Más la anexidad inglesa y la israelita). Un salto cualitativo adicional en la nueva guerra del Líbano puede conducir a la apertura de válvulas de escape que tal vez alivien la sismogénica presión.

Sobre un telón de fondo de profundo desarreglo económico—los rendimientos decrecientes de una burbuja de revalorización de bienes raíces, que ha venido financiando la merma en el poder de compra norteamericano por el aparentemente imparable incremento de los precios de los combustibles; el deterioro de la atención hospitalaria a la salud y la complicación en el sistema de seguridad social—los Estados Unidos no estarían muy lejos de un proceso de impeachment de George W. Bush, para replegarse de su sobrextensión por el planeta. Hace nada que la Corte Suprema de Justicia le paró el trote en Guantánamo, y ni siquiera el Chief Justice Roberts, su ostensible aliado, pudo impedirlo. Los Estados Unidos son peligrosos para sus enemigos, pero el gobierno de Bush es ya inadmisiblemente peligroso para los Estados Unidos.

Afganistán, Corea del Norte, Irak, Irán… y ahora la guerra de Israel contra Hezbolá en el Líbano. Son demasiadas emergencias juntas, y ya antes de la emergencia de este último conflicto el embajador de Arabia Saudita en la ONU temblaba ante la posibilidad de una triplicación de los precios del petróleo como secuela de cohetes lanzados sobre el estrecho de Ormuz.

El polemólogo favorito de doctorpolítico contempla un terrible «peor caso» si se repiten «los cañones de agosto», el «efecto dominó» de trabados intereses nacionales que no pudo ser detenido por la más febril actividad diplomática en vísperas de la Gran Guerra de 1918. Si se interrumpe el paso de tanqueros en el neurálgico estrecho, predice, tendremos a los marines ocupando el Zulia o induciéndolo a la secesión tras el escudo del ejército colombiano, y hasta un golpe de Estado en Brasil para llevar sus tropas hasta Maturín, en procura del aseguramiento de los yacimientos de la Faja Petrolífera del Orinoco.

Es con esta nitroglicerina con lo que el delirante Presidente de Venezuela juega, llamando «subanimales» a los imperialistas de los Estados Unidos desde Vietnam, y declarando que «si nos invaden» resistiremos como los vietnamitas. ¿Quién le ha dado derecho de meternos en brete tan preocupante y peligroso? Si los Estados Unidos se dirigen, aparentemente, a su colapso—ya la ocupación de Irak ha costado 800 mil millones de dólares—y se muestran excedidos ¿qué puede pensarse de esta república «quinta» y «bolivariana» que se amorocha con Irán, Bielorrusia y Vietnam, que interfiere en México, Nicaragua y Perú, que soborna a Rusia, Bolivia y Argentina?

LEA

por Luis Enrique Alcalá | Ago 3, 2006 | Física, Otros temas |

La búsqueda de una teoría del campo unificado (Einstein) y de la ecuación general (Heisenberg). A Theory Of Everything. (TOE). Hacia una relatividad cuántica. Noción de teoría de cuerdas. Cuantización del espacio y el tiempo.

En su Autobiografía, Werner Heisenberg escribió: “Hasta entonces, siempre habíamos creído en la vieja doctrina de Demócrito, que puede resumirse como: ‘En el principio era la partícula’. Se había supuesto que la materia visible estaba compuesta de unidades más pequeñas, y que si se dividía a éstas lo suficiente, debiéramos llegar a las unidades más pequeñas, que Demócrito había llamado ‘átomos’, y que ahora podían llamarse ‘partículas elementales’—es decir, ‘protones’ o ‘electrones’. Pero quizás esta filosofía estaba enteramente equivocada. Quizás no existían elementos más pequeños que ya no pudieran ser divididos. Quizás la materia podía ser dividida todavía más, hasta que finalmente ya no fuese una división real sino un cambio de energía en materia y las partes ya no fueran más pequeñas que lo que hubiera sido dividido. Pero ¿qué había al principio? ¿Una ley de la naturaleza, matemáticas, simetría?”

La última palabra de este trozo resultó ser clave en la formulación teórica del mundo subatómico, y en general en la Física. La búsqueda y matematización de simetrías fundamentales está en la base de las teorías acerca de las partículas elementales y su interacción. Heisenberg, por su parte, construía sobre la intuición de Emmy Noether, un matemático de la Universidad de Gotinga, que en 1918 adelantó la siguiente correlación: “Toda ley de conservación es una consecuencia de una simetría de las leyes naturales”.

La idea de que la naturaleza conserva ciertas magnitudes a pesar de las transformaciones es bastante antigua. Incluso Heráclito, que decía que todo estaba en movimiento—Panta rei—buscaba encontrar algo constante detrás de los cambios aparentes. Llegaría el siglo XVII para que Gottfried Wilhelm von Leibniz postulara que ese factor constante era la energía. (Conservatio virium). Las colisiones de los cuerpos cambian las direcciones del movimiento, pero la energía permanece constante, como es constante igualmente durante el movimiento de un péndulo. Pero esto se observa en la colisión de los cuerpos elásticos, no así en la de los inelásticos, en la que aparentemente desaparece una parte de la energía cinética. Parecían caber sólo dos explicaciones: o se producía una transformación de la energía al nivel de las partículas pequeñas que componen un cuerpo—lo que era inobservable para la época—o la conservación de la energía era simplemente una ilusión.

Fue a mediados del siglo XIX cuando Julius Robert Mayer retomara el asunto para declarar que la energía era una entidad que no podía ser creada o destruida. Finalmente, en 1905 Albert Einstein encontraba que materia y energía eran una misma cosa, y desde ese entonces se habla de la conservación de la materia-energía. Antes, James Clerk Maxwell había encontrado que la electricidad y el magnetismo eran dos manifestaciones de un mismo fenómeno. La unificación aparentaba ser el camino de la Física; toda la segunda mitad del siglo XX alojó una constante búsqueda por unificaciones más fundamentales.

Es así como Heisenberg emprendió, en la década de 1950, la búsqueda de una “fórmula universal” de la Física, e hizo esto a partir de las simetrías fundamentales que daban origen a las leyes de conservación. Si se establece una jerarquía de las leyes físicas, son las leyes de conservación las que ocupan el pináculo de generalidad, al ser de aplicación más universal. Así comentaba el punto Heisenberg en Der Teil und das Ganze—La parte y el todo—un recuento histórico de la aventura científica de la primera mitad del siglo XX, en la que él había sido importantísimo protagonista: “…[si] las leyes de conservación, para la energía o para la carga eléctrica, son de carácter absolutamente universal, se aplican a todas las esferas de la Física, y surgen de propiedades de simetría en todas las leyes de la naturaleza, entonces se sugiere a sí mismo el pensamiento de que estas simetrías son elementos determinantes en el plan según el que fue creada la naturaleza”.

Y en otra parte avanza: “Las partículas elementales en la filosofía de Platón recibían su simetría de lo que se llamó el ‘grupo del espacio’, el grupo de las revoluciones en el espacio tridimensional. Esto, por tanto, involucra una simetría estática, directamente intuitiva. La física moderna, no obstante, incorpora al tiempo en su observación de la naturaleza desde un principio. Desde Newton, la física se ha preocupado con la dinámica de los fenómenos. Está basada en la opinión de que, en este mundo constantemente cambiante, las leyes—antes que las formas geométricas—es lo que debe ser duradero. Estas leyes son básicamente construcciones más abstractas, que se aplican, sin embargo, al espacio y el tiempo… La teoría definitiva de la materia estará—como en Platón—caracterizada por una serie de importantes demandas de simetría… Estas simetrías ya no pueden ser elucidadas simplemente mediante figuras e imágenes, como era posible con los cuerpos platónicos, pero esto puede hacerse con ecuaciones”.

El neoplatonista que era Heisenberg procuró, armado de este punto de vista, arribar a una ecuación general de la Física de la que pudieran extraerse todas las demás. A fines de 1957 informó a su amigo y colega de toda la vida, Wolfgang Pauli, acerca de una nueva ecuación de campo a la que había arribado. El habitualmente escéptico Pauli reaccionó esta vez con entusiasmo, pero el trabajo conjunto, que convirtió la “ecuación de Heisenberg” en la “ecuación de Heisenberg-Pauli”, nunca conduciría a nada, a pesar de que una conferencia prematura de Heisenberg en Gotinga suscitara elogiosos comentarios periodísticos que anunciaban “el fin de la Física”.[1]

Heisenberg hablaba de una “teoría del campo unificado”, y hay por tanto que entender qué es un campo para la Física. Un campo es una región del espacio en la que se manifiesta alguna magnitud física, como puede ser una perturbación eléctrica o una atracción magnética. Cada punto del espacio—o si se quiere más generalmente, del espacio-tiempo einsteniano—recibe la asignación de una cantidad de esa magnitud, por lo que el campo es verdaderamente continuo y extendido sin límites. Llena, por decirlo así, todo el espacio, aunque con fuerza variable en distintas regiones. El campo eléctrico y el campo magnético, recordemos, había sido reunido en un solo campo electromagnético gracias a los trabajos de Maxwell. Lo que pretendía Heisenberg era añadir a esta unificación lo requerido para describir correctamente la conducta de las partículas.

El mismo Einstein trabajó los últimos años de su vida, justamente, en una “teoría del campo unificado”, tratando, esta vez, de unificar las ecuaciones del campo electromagnético y su teoría general de la relatividad, que había provisto una novedosa explicación del fenómeno de la gravitación. Ya asentado en el Instituto de Estudios Avanzados de Princeton, buscó, también sin éxito, esa unificación de gravedad y electromagnetismo. El intento rendía, invariablemente, valores infinitos para ciertas variables, lo que no tenía sentido físico.[2]

Después de la década de 1950, sin embargo, los físicos han tenido éxito al producir nuevas unificaciones. El trabajo implicó reunir en una sola teoría varias de las cuatro interacciones—antes llamadas “fuerzas”—fundamentales del universo observable. Estas cuatro interacciones son la interacción fuerte (que mantiene unidas las partículas integrantes del núcleo atómico a pesar de la repulsión electromagnética de los protones), la interacción débil (responsable del decaimiento beta, la radiación de electrones o partículas beta desde el núcleo), la interacción electromagnética y la gravedad. Cada una de éstas es explicada en una “teoría de calibración” (gauge theory) que postula un campo y unas partículas que “median” la interacción: es decir, la interacción se produce por el intercambio de las partículas de mediación.

Pues bien, después de la integración de Maxwell entre electricidad y magnetismo, la próxima se produjo entre el electromagnetismo y la interacción débil. Esto es, hay ahora una sola teoría de la que se deducen tanto los comportamientos electromagnéticos como las interacciones débiles, así como las partículas características de ambas interacciones: el fotón, partícula mediadora del electromagnetismo, y los bosones W y Z, que median la interacción débil.[3]

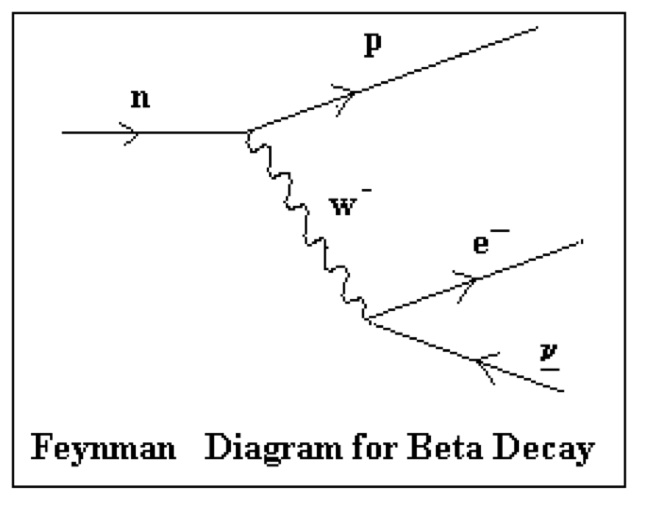

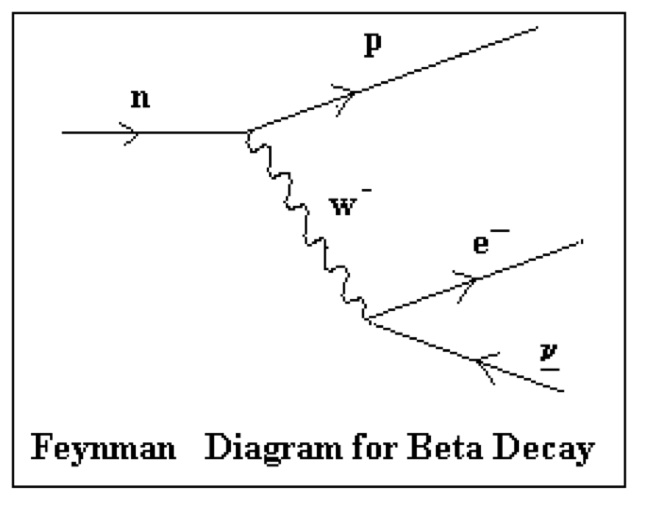

Los distintos bosones

Una interacción débil típica es la que convierte un neutrón (ligeramente más pesado que un protón) en un protón (positivo) y un electrón (negativo) junto con un antineutrino. En esta interacción se conserva la carga eléctrica (una ley de conservación, o una simetría, operando), pues la suma de las cargas opuestas del protón y el electrón equivale a la carga cero del neutrón, y el antineutrino que se produce es eléctricamente neutro. Es esta interacción la que se conoce como decaimiento beta (beta decay) puesto que la emisión de electrones (partículas beta) desde el núcleo fue llamada así por Ernest Rutherford originalmente.

Diagrama de Feynman del decaimiento beta. Un neutrón (a la izquierda del diagrama) pierde un bosón W negativo y se convierte en protón. El bosón da origen a un electrón y un antineutrino. (A la derecha y abajo). La línea ondulada que representa al bosón indica que se trata de una partícula “virtual”.

En cambio, la interacción fuerte que mantiene unidos los nucleones (partículas del núcleo atómico) ocurre por la mediación de partículas virtuales llamadas gluones. Éstos no portan carga eléctrica y son, como el fotón, de masa nula. La teoría electrodébil, explicativa de tanto el electromagnetismo como la interacción débil, no incluye explicación para los gluones y, por tanto, no es una teoría que explique la interacción fuerte.

La interacción fuerte requirió una teoría distinta, la cromodinámica cuántica, para dar cuenta de sus mecanismos y partículas. Estrictamente, describe la interacción entre los quarks (y antiquarks) y los gluones mismos, pero en términos amplios se la tiene como responsable de la interacción entre hadrones. (Tanto los bariones—el protón, el neutrón—como los mesones, tales como el mesón K). A este aspecto de la interacción fuerte entre hadrones se le conoce como interacción fuerte “residual”, siendo la que afecta a los quarks y los gluones mismos la interacción fuerte fundamental, o interacción de “color”.

Una tabla que resume las cuatro interacciones fundamentales en el universo.

La tarea de unificar las interacciones, sin embargo, no se detuvo allí. Un paso ulterior fue la construcción de una GUT (Grand Unification Theory), la que predice que a energías superiores a 1014 GeV la interacción fuerte, la interacción débil y el electromagnetismo se revelan como una sola fuerza, sujeta a una sola simetría englobante. Una sola ecuación predice la conservación de la carga eléctrica, la “fuerza débil” y la “hipercarga”. El trabajo matemático está hecho (hay varios modelos), pero no hay evidencia todavía que permita asegurar que una GUT pueda realmente describir a la naturaleza. Además, la gravitación espera aún por su integración o unificación.

En particular, el Modelo Estándar está a la espera de un peculiar bosón, el llamado bosón de Higgs, que hasta los momentos no ha sido detectado y es predicho, sin embargo, por la teoría. Los físicos de partículas albergan la esperanza de que el nuevo Gran Colisionador de Hadrones (Large Hadron Collider, LHC) que construye CERN (Comision Européenne pour la Recherche Nucléaire) logre la hazaña.

La peculiar partícula fue postulada por el físico inglés Peter Higgs (de allí su nombre) en 1964. Existiría un “campo de Higgs” que se extendería por todo el universo, en el que las perturbaciones producidas por el bosón de Higgs y sus interacciones con las restantes partículas darían origen a la más fundamental de las propiedades de la materia: la masa. (En particular, el bosón de Higgs[5] es necesitado por el Modelo Estándar para explicar la diferencia de masa entre la del electrón y las de los bosones W y Z).

Pero ni aun de esta manera se habría logrado la unificación de la cuántica con la teoría general de la relatividad. La masa que se generaría a partir del bosón de Higgs es masa inercial—la resistencia opuesta por un cuerpo a la incidencia de fuerzas—y la que maneja la teoría general de la relatividad es masa gravitacional, la causante de la atracción de la gravedad. En la práctica ambas masas son idénticas, pero los físicos no pueden explicar por qué es esto así.

Lo que sí se sabe es que la física de partículas está íntimamente ligada al origen del universo y su evolución. En el Big Bang todas las interacciones serían una sola, y de ésta irían “desacoplándose” las cuatro conocidas hoy a medida que el universo se expandía y disminuía su temperatura.

Emergencia de las "fuerzas" en el tiempo

En teoría el comienzo del universo correspondería a una “era de la relatividad cuántica”, con temperaturas superiores a 1032 grados Kelvin y energías superiores a 1019 GeV. Por debajo de estas cotas se desacoplaría la gravedad y la expansión experimentaría la fase “inflacionaria” hasta que se alcanzaran 1027 grados Kelvin y las energías hubieran descendido por debajo de 1014 GeV.[6] Al descender la temperatura por debajo de estos niveles, se habrían desacoplado la interacción electrodébil y la interacción fuerte. Por último, al rebasarse la temperatura de 1015 grados Kelvin (100 GeV) la interacción débil y la interacción electromagnética se habrían separado.

Actualmente hay una candidata a ser la gran teoría unificadora, la TOE o Theory Of Everything, una teoría cuántica de la relatividad: la “teoría de supercuerdas” , que postula que las verdaderas partículas serían cuerdas verdaderamente minúsculas, cuyas oscilaciones, en un espacio no de cuatro, sino de once dimensiones, darían origen a todo lo observado. O sea, que los quarks también tendrían una estructura, y que sus componentes serían estas supercuerdas. El nivel de abstracción matemática de esta teoría es realmente elevadísimo, y conduce a especulaciones como la de la existencia de múltiples universos y la de bootstrap particles, partículas que se levantarían a sí mismas, como el Barón de Munchausen, halándose a sí mismas “hacia arriba”.

Más recientemente, ha comenzado a estudiarse la noción de que el espacio y el tiempo tampoco serían de magnitud continua sino discreta; es decir, que estarían cuantizados. Probablemente, además, las matemáticas fractales, definidas por Benoit Mandelbrot en The Fractal Geometry of Nature, comiencen a decir algo para describir la estructura diversa del universo. Si el espacio y el tiempo son pulverulentos y no entidades continuas, pueden ser tratados como estructuras fractales, que tanto éxito han tenido en el tratamiento de sistemas complejos y caóticos. Una ecuación de gran simplicidad puede dar origen a estructuras complejísimas, y entonces haya sido tal vez necesario a Dios escribir una sola ecuación para desencadenar la numerosa y rica complejidad del cosmos.

Las esperanzas—y los temores también—están puestas en Suiza, donde CERN construye el LHC que deberá entrar en funcionamiento en noviembre de 2007. Aquí se está jugando con fuego o, literalmente, con el árbol de la sabiduría, el árbol del bien y del mal. Físicos japoneses han anunciado su proyecto de crear un “universo bebé”, y hay quienes temen que el LHC pueda crear un cuerpo negro que nos hará desaparecer a todos o, incluso, al universo entero. Por ahora se invierte una ingente cantidad de fondos en su construcción.

Arthur C. Clarke, el astrofísico inglés de mente visionaria, logró una vez con un cuento de ciencia-ficción la distinción que sus colegas estimaron: la mejor narración de ciencia-ficción de todos los tiempos. Los nombres de Dios cuentan de un equipo de expertos en computación que lograron inventariar, finalmente, todos los nombres de la divinidad. Mientras descendían del monasterio tibetano donde habían llevado las computadoras que hicieron el cálculo, comenzaron a ver, de noche, cómo empezaban a apagarse las estrellas. LEA

[1] Una expresión análoga a la del libro de Francis Fukuyama, El fin de la historia.

[2] En Física, especialmente en física de partículas, se emplea un “truco” que consiste en operar con las cantidades infinitas—sumas algebraicas, promedios—para arribar a valores finitos. A este procedimiento se le conoce con el nombre de “renormalización”.

[3] El bosón Z es eléctricamente neutro. Hay un bosón W de carga positiva unitaria (W +) y un bosón W de carga unitaria negativa. (W –).

[4] Richard Feynman (1918-1988), Premio Nóbel de Física en 1965, introdujo los diagramas que llevan su nombre para presentar gráficamente las interacciones de las partículas subatómicas. Se parecen mucho a los rastros que dejan las partículas en una cámara de burbujas.

[5] En 1993 el ministro británico de Ciencias, William Waldegrave, solicitó que le explicaran “en una página”, qué demonios era el bosón de Higgs. Varias de las explicaciones aprobadas, algunas con metáforas, ayudaron a Waldegrave a juzgar la sabiduría de invertir en aceleradores de partículas más poderosos que los existentes. Pueden ser leídas en http://www.phy.uct.ac.za/courses/phy400w/particle/higgs.htm

[6] La fase inflacionaria de la expansión del universo es una corrección introducida a los primeros modelos del Big Bang para explicar las heterogeneidades que dieron origen a las galaxias.

por Luis Enrique Alcalá | Ago 3, 2006 | Cartas, Política |

Una cierta corriente de la Sociología entiende a esta ciencia como el estudio de los grupos, independientemente de su tamaño. (Desde una pareja hasta una nación). Y ha sido observación de este enfoque que la tríada, el grupo formado por tres entidades o personas, es uno de los grupos más inestables. En teoría, las tres comienzan como pares, pero pronto dos de las tres se encompinchan, se vuelven camaradas, se enamoran. Esto deja a la tercera excluida, relegada, obligada a seguir lo que la díada decida.

El tercero relegado se defiende entonces con una campaña de seducción sobre uno de la díada interna hasta que logra arrancarlo y formar una nueva díada, dejando un nuevo tercero excluido, undsoweiter (y así sucesivamente). Es ésa la dinámica de la tríada.

Para el término del mundial de fútbol de Alemania, el tercero excluido era Teodoro Petkoff. Rosales primero y en minutos Borges se plegaron al ultimátum primarista de Súmate, dejando a Petkoff desubicado: continuaba jugando pero se le había declarado en posición adelantada, íngrimo delante de la meta y con toda la defensa contraria en sus talones. Sus dos compañeros de ataque se habían replegado tras ésta, abandonándolo. La díada Borges-Rosales encontraba difícil reunirse con él, o asistía a sesiones acordadas con harto retraso.

Hoy sin embargo, Borges vuelve a recular y alude a la debilidad de unas primarias de baja asistencia porque «la gente tiene miedo», opina que la sentencia del Tribunal Supremo de Justicia del viernes pasado, estipulando que Rosales no debe estar en el ejercicio del cargo de gobernador si quiere postularse, debe ser tomada en cuenta y que él será el candidato único. (Dicho sea de paso, el TSJ tenía que decidir como lo hizo. La Constitución no dice nada sobre una necesaria separación de su cargo de un presidente en ejercicio que quiera reelegirse; en cambio incluye un artículo específico, el 229, que dice así: «No podrá ser elegido Presidente o Presidenta de la República quien esté de ejercicio del cargo de Vicepresidente Ejecutivo o Vicepresidenta Ejecutiva, Ministro o Ministra, Gobernador o Gobernadora y Alcalde o Alcaldesa, en el día de su postulación o en cualquier momento entre esta fecha y la de la elección». Como se ve, tampoco exige la renuncia del gobernador del Zulia, tan sólo que no esté «de ejercicio»; ni siquiera dice «en el ejercicio». Si se quiere ver en esto una injusta ley del embudo, pues hay razón, pero no debiera haber sorpresa. Como en el caso de tantos dictadores de antaño en nuestro país, la constitución que nos rige fue hecha a la medida del presidente Chávez).

Borges se descoloca él solo, porque lo que debe andar cocinándose es un pacto entre Rosales y Petkoff. Éste no puede oponer a su par zuliano que es el mejor ubicado en las encuestas: Rosales es el primero de los tres y Petkoff el último de los tres, y hay mucho menos distancia ideológica entre Petkoff y Rosales que entre Petkoff y Borges. El autor de Las dos izquierdas difícilmente podría explicar su apoyo a un candidato de centro-derecha. Y así como Borges no podía dejar de atender al llamado de Súmate, tampoco podría dejar de apoyar al líder de Únete (UNT o Un Nuevo Tiempo), si Petkoff le pica adelante.

Así que lo más probable es que no haya primarias (Primero Justicia y COPEI han insinuado que Súmate no puede organizar las primarias exitosamente ni en Altamira), que Súmate eche la culpa del fracaso a los candidatos (como ya lo ha venido preparando) y a la campaña del gobierno en su contra, que Carlos Blanco ya ha reclamado. Lo más probable es que sea Rosales el candidato de la terna, y Súmate tendrá que decidir si continúa cerca de él, que a fin de cuentas era su candidato preferible, o si se radicaliza consistentemente hacia las posturas abstencionistas de Acción Democrática, Pablo Medina o Álvarez Paz. Pero aun cuando Súmate decida esta radicalización, que la separaría del candidato unitario-trinitario, Rosales quedaría marcado como el candidato «de oposición», esto es, como el candidato del 15% de los electores. (Que a estas alturas pueden ser pensados como escindidos en un 10% de participacionistas y un 5% de abstencionistas a ultranza).

………

En ocasión reciente (Carta Semanal #190, del 15 de junio de 2006) fue mencionado acá un hallazgo del encuestador Eugenio Escuela, quien había encontrado, en registro de opinión del mes de mayo, que la mitad (50,25%) de quienes respondían a una pregunta por ubicación política se tenían por colocados en el centro. Si se añade a quienes se confesaron de centro-derecha (14,06%) y a quienes se entienden de centro-izquierda (14,42%), se llega a la suma de 78,73%, prácticamente las cuatro quintas partes de quienes respondieron. (El 70% de los entrevistados).

Después de esa perla se dio a conocer (El Nacional, Descifrado) la encuesta de Hinterlaces que presentaron a cuatro manos Oscar Schemel y el asesor político norteamericano Dick Morris, sobre datos levantados en junio. A pregunta sobre ubicación en chavismo, oposición o categoría que no es ninguna de las otras dos, 35% dijo ser chavista, 15% opositor y 49% «ni-ni». Por otro lado, el mismo estudio medía una intención de voto de 55% a favor de Chávez, 7% para Rosales, 5% por Borges y 4% por Petkoff. (Para Smith, 2%, después de ¿diez millones de pasos?) Pero también encontraba que 17% quería «otro distinto» (más que el trío BPR unido), y 10% estaba por el candidato Nosabe Ninguno Nocontesta.

La Ficha Semanal #57 (Manual del outsider, 2 de agosto de 2005) y la Carta Semanal #68 (El outsider), del 9 de enero de 2004, trataron de la atractriz del outsider, un cauce disponible como salida eficaz, como viraje pronunciado de la dinámica política en la Venezuela de estos días. Y hace dos semanas se reproducía acá (Carta Semanal #195) un capítulo escrito el año pasado para un libro (Chávez es derrotable) editado por don Fausto Masó: Tío Conejo como outsider. Éste, a su vez, refrescaba un concepto expuesto en el #131 de la Carta Semanal de doctorpolítico (31 de marzo de 2005): «Siendo que Chávez tiene el mayor control del poder posible en Venezuela—político, militar, económico—una oposición al estilo cacical debe fracasar. Es un brujo, no un cacique, quien puede suceder a Chávez a corto plazo. (2006). No es otro ‘tío tigre’ menor que pretenda discutirle la posición alfa a Tío Tigre en su manada. Es Tío Conejo». Es difícil pensar en otra figura a la que le queden mejor el disfraz y el carácter de Tío Conejo que a Benjamín Rausseo.

Er Conde der Guácharo, hasta donde se la ha visto actuar, no ha incurrido en desatinos, y desde su humor—»MVR lo que significa es Me Volví Rico», «la diferencia entre Chávez y yo, que somos ambos feos y de pelo malo, es que yo vivo en Venezuela»—ha sido el más corrosivo competidor que se haya levantado ante «el líder del proceso». Sería verdaderamente Tío Conejo si estuviera pendiente de su seguridad, pues aparentemente sólo su desaparición física impediría que sus dardos desinflen la pomposidad mussolinista de Chávez y sus pretensiones de némesis de George W. Bush.

………

De Wikipedia: «El Guácharo (Steatornis caripensis) es un ave sudamericana de la familia Steatornithidae (única especie) y son conocidos como las aves de las cavernas o los pájaros aceitosos, una derivación de su nombre en otras lenguas europeas (p.ej. latín steatornis; alemán: Fettschwalm; inglés: oilbird.) Es la única especie de su familia y género, la única ave frugívora nocturna de su orden (los Caprimulgiformes), y una de las pocas aves, y la única nocturna, que navegan por los ecos en condiciones de baja luz.

Vive en colonias en el interior de profundas cavernas. Durante el vuelo nocturno fuera de las cavernas, arranca sus principales alimentos (nueces de palma) con su poderoso pico ganchudo. Mientras vuelan en cavernas oscuras, los guácharos emplean un sistema de orientación por ecos similar al sonar, produciendo ‘cliqueos’ audibles de frecuencia de 7.000 ciclos por segundo. Se puede oír fácilmente cuando el pájaro está en vuelo. A las 10 semanas de nacidas, las crías tienen 50 por ciento más de peso que sus padres. El cuerpo de los polluelos está lleno de grasa y se sabe que éstos comen un cuarto de su peso cada noche.

El guácharo vive en varias partes de la cordillera de los Andes desde la isla de Trinidad por lo menos hasta Bolivia; también se ha reportado en Brasil.

El guácharo fue descrito por Alejandro de Humboldt durante su viaje a Sudamérica en 1799. Lo observó en la Cueva del Guácharo, en Caripe, Venezuela. El nombre científico de la especie, Steatornis caripensis, significa ‘ave grasosa de Caripe’. La Cueva del Guácharo es el centro del Parque Nacional Cueva del Guácharo, y del Monumento Nacional (el primero establecido en Venezuela) ‘Alejandro de Humboldt’.»

El 8 de mayo de 2003 se hacía en la carta #35 la siguiente observación: «Un cierto matiz avícola ha teñido recientemente la política nacional. Desde el orgulloso anuncio de la importación de tres mil toneladas de pollo que ofreciera Chávez Frías, pasando por su previo dibujo de los estratégicos gallineros verticales y las ejecutorias criminales del prócer revolucionario Manuel Arias—alias ‘Pollo Ronco’—hasta las imágenes gallináceas que maneja con insistencia Henrique Salas Römer». Pero aunque la candidatura de Rausseo es aun mucho más ornitológica que la del jefe de Proyecto Venezuela, no tiene nada de gallinácea, como acabamos de ver.

………

Al anochecer del día que el coronel Soto alcanzara su efímera fama—cuando una patrulla de policía militar quiso prenderle y debió retirarse con el rabo entre las piernas, impedida por una acción de enjambre, por una espontánea aglomeración de vehículos y ocupantes protectores—y fue a tener en hombros hasta la Plaza Francia y más tarde a las afueras de La Casona, el conductor de un programa radial llamó a un analista político para hacerle la siguiente pregunta: «Dime ¿tú crees que el coronel Soto es el líder que la sociedad civil ha estado esperando?» Semejante interpelación, por supuesto, era un signo inequívoco de la sequía dirigencial del territorio no chavista, que hasta ahora no había visto candidatos que resonaran con el alma venezolana.

En cambio, ahora asistimos al despegue de un famoso cohete que, según parece haber medido Eugenio Escuela, en cuestión de días hace que la intención de voto por Chávez haya mermado hasta 40% y alcance por su cuenta 30% a su favor. Unos cuantos días más y tendremos un empate técnico, y si el cohete continúa en ascenso, Chávez quedará asolado en el piso del 35% chavista medido por Hinterlaces y habrá sido superado por Rausseo.

Como ha apuntado acertadamente el profesor Antonio Cova, Rausseo ha cortado el nudo gordiano de la abstención al mostrar el tramojo del método ucraniano contra un intento de fraude electoral, en señal de doble filo: una advertencia al gobierno y una superación de los abstencionistas, sin siquiera discutir con ellos. E Ignacio Ávalos así lo caracteriza: «Tipo popular, de físico criollo a más no poder, ideal, argumentan, para echarle una vaina a Chávez, al margen de que no se sepa de sus ideas políticas, de su diagnóstico sobre el país, mucho menos de las proposiciones que tiene para gobernarlo. Pero no importa, es el Chávez de los que no quieren a Chávez».

Es más bien otra cosa que esto último. En un país organizado como Schemel-Morris lo han medido, la polarización entre Chávez y un «candidato único de oposición» daría el triunfo al primero, pero, en contra de lo intuitivo, en una campaña entre tres—Chávez, Rosales, Rausseo—el primero pudiera perder sin que todo su poder sea capaz de impedirlo. Rausseo, aunque no lo ha dicho, es el más genuino ofertante hacia los «ni-ni», hacia el centro que es la inmensa mayoría nacional.

Hace seis meses no quise poner atención a un amigo siempre sorprendente que me advertía: «Hay un grupo que está reuniendo un ‘pote’ para lanzar al Conde del Guácharo, pues estima que a la procacidad de Chávez sólo puede oponérsele otra, y cuidado como se convierte en un fenómeno electoral». Pero ahora estoy a punto de creer que Rausseo puede suceder a Chávez y Castro puede ser sustituido, no por su hermano Raúl, sino por Álvarez Guédez. Ya sintonizan con el eco de orientación serísimos abogados. Uno de ellos querría sugerir al bunker de Musipán que se considere el nombre del accidentado Jorge Rodríguez como Ministro de Vivienda: si fue capaz de meter dos millones de habitantes en una sola casa…

Chávez será el miedo, Rosales tomará prestado el lema teodorista «contra el miedo», Rausseo será la risa, que bastante falta nos hace y nunca pudo Salas Römer devolverle a Venezuela.

LEA

por Luis Enrique Alcalá | Ago 2, 2006 | Física, Otros temas |

Cosmología inflacionaria. Hiperestructuras en el espacio. El “Gran Atractor”.

La primera formulación rigurosa de una teoría del Big Bang predecía un universo perfectamente liso y homogéneo. Mientras la información empírica que soportaba esa explicación acerca del origen y evolución del universo se restringía al hallazgo de Penzias y Wilson—detección, en 1964, de una radiación uniforme y en todas las direcciones equivalente a una temperatura de 2,7 grados Kelvin (ver Física 6)—aquella predicción no representaba mayor problema. La teoría primitiva, sin embargo, no podía explicar muy bien la irregularidad del universo: la existencia de galaxias y otras estructuras y, por otra parte, las más recientes observaciones—telescopio Hubble y COBE—determinaron un cierto grado de irregularidad o anisotropía que no se derivaba fácilmente de la formulación original. Más aún, en la década de 1970, varias otras objeciones y dudas se acumularon para requerir una modificación en la teoría inicial.

Uno de estos problemas es el llamado “problema del horizonte”: la irregularidad o granularidad del universo es en realidad muy pequeña. A escalas cósmicas es en verdad bastante homogéneo. El problema de la teoría primera del Big Bang era explicar esta observación, que en términos axiomáticos se conoce como principio cosmológico: a grandes escalas el universo es homogéneo e isotrópico, no tiene direcciones preferidas ni localizaciones privilegiadas. A observadores situados en puntos distintos del espacio, el universo se aparecería esencialmente idéntico. (La aceptación axiomática del principio cosmológico, por cierto, más la hipótesis de que el universo es finito, conducen a una evolución cósmica equivalente a la postulada por la teoría del Big Bang).

Una homogeneidad semejante sería la esperada en el caso de una mezcla de gases en equilibrio térmico, encerrada en algún envase apropiado. Acá ha habido tiempo para que las moléculas del gas intercambien energía cinética hasta que todas tengan la misma temperatura. Esto es, hasta eliminar la anisotropía. Pero en el caso del Big Bang la expansión misma, sin encerramiento que la contenga, no da tiempo a que todas las regiones del universo primitivo entren en contacto, y por tanto no hay manera de que lleguen al equilibrio térmico. Si esto es así ¿cómo es que se observa un universo tan homogéneo?

Conocedor de esta dificultad, Georges Lemaître, quien primero postulara el escenario del Big Bang con su idea del “huevo cósmico” o “átomo primitivo”, creyó que la uniformidad vendría dada por una serie repetida de expansiones y contracciones: es decir, por una secuencia de Big Bangs. Esto daría tiempo para alcanzar la uniformidad. A esta hipótesis se la llamó “el universo Fénix”, pues el universo renacería y volvería a renacer con cada ciclo de expansión-contracción). En forma análoga, Richard Chase Tolman ofreció la imagen de un “universo oscilatorio”. Por su parte, Charles Misner postuló un “universo licuadora” que homogeneizaría su composición. Todas estas explicaciones crearon más problemas de los que pretendían resolver. Los ciclos de Lemaître o Tolman, por ejemplo, conducían a una acumulación de entropía que no corresponde a lo observado[1], mientras que la idea de Misner llevaba a un universo más caótico. Había que buscar otra solución.

Luego, estaba el problema del universo plano, o de la “geometría del universo”. Ésta viene determinada, según la teoría general de la relatividad, por la cantidad de materia presente en el universo. La atracción gravitacional producida por la presencia de materia actuaría como un freno a la expansión del mismo. Si hubiera suficiente materia esta expansión terminaría por anularse y se iniciaría una contracción (Big Crunch) que llevaría todo al comienzo, a la singularidad. Si, por lo contrario, la cantidad de materia fuera insuficiente, entonces el universo se expandiría eternamente. Hay un valor intermedio de esta densidad de materia, la “densidad crítica”, que haría que la rata de expansión llegara a cero, y entonces a partir de cierto punto el universo preservaría su tamaño, sin contraerse o expandirse. (La primera condición corresponde a una geometría esférica—de Riemann—a un universo cerrado que tarde o temprano se contraería. La segunda condición implicaría un universo abierto, siempre en expansión, en una geometría hiperbólica o de Lobachewtski. Si el universo ostenta exactamente la densidad crítica, entonces sería “plano”, en una geometría euclidiana. Las observaciones más recientes están más próximas de esta última hipótesis).

Tres geometrías: Riemann, Lobachewtski, Euclides

Más precisamente, la densidad crítica ha sido determinada con el valor de 1029 gramos por centímetro cúbico, y el cociente de la densidad real sobre el valor de esta densidad crítica se designa como W. Un valor de W ligeramente mayor de 1 en un universo primitivo habría conducido rápidamente al colapso; un valor ligeramente inferior a 1 habría impedido, con una expansión demasiado rápida, la formación de las galaxias y las estrellas. Las mediciones actuales del cociente W lo establecen entre 0,98 y 1,06. El universo es plano, y este resultado no podía ser predicho por la primitiva teoría del Big Bang.

Todavía recibiría esta formulación original una tercera objeción. Sus ecuaciones predecían la formación de “monopolos” magnéticos. (Un imán sin polo sur, por ejemplo). Pero nunca ha sido observado un monopolo, ni siquiera en las reacciones más energéticas en el interior de los más grandes aceleradores de partículas.

Todas estas objeciones fueron salvadas por la introducción de la teoría de la fase de expansión “inflacionaria” del Big Bang. Consistió en postular una brevísima fase de expansión mucho más acelerada que la observada por Hubble como la actual, en los primerísimos instantes después de la gran explosión, una fase de expansión exponencial. Propuesta inicialmente en 1981 por Alan Guth, fue desarrollada luego, de forma independiente, por Andreas Albrecht, Andrei Linde y Paul Steinhardt. La inflación propone que el universo observable se originó en una región relativamente pequeña que estaba causalmente conectada. (Esto es, que podía ser recorrida a la velocidad de la luz en un tiempo finito). En ella, efectos cuánticos causarían minúsculas fluctuaciones térmicas, que actuarían como “semillas” que en último término causarían la irregularidad necesaria para la formación de las galaxias y las estrellas.

Esta rapidísima expansión—por un factor de 1026—por otra parte, tiene la virtud de homogeneizar el conjunto, y de eliminar cualquier curvatura “excesiva” del universo, haciéndolo plano, como lo observamos hoy. Es decir, la hipótesis de la inflación resuelve el problema del horizonte, el problema del universo plano y también elimina la incómoda predicción de monopolos magnéticos que no han sido observados jamás.

Estamos hablando, en todo caso, de tiempos inimaginablemente breves. Los cómputos actuales de la teoría proponen una duración total de la fase de inflación de no más de 10-33 segundos. Esto habría bastado para causar el tipo de universo que observamos.

En verdad, toda la teorización acerca del origen del universo nos remite a magnitudes realmente minúsculas, presentes en lo que se denomina el universo o la escala o la época de Planck. Por ejemplo, se emplea la denominada longitud de Planck (lp), que equivale aproximadamente a 1,6 x 10-35 metros. El tiempo de Planck (10-43 segundos) se define como el que tardaría un fotón en recorrer la longitud de Planck a la velocidad de la luz. Son estas escalas las presentes al inicio del universo. De hecho, para la física cuántica, no tiene sentido hablar de ningún instante anterior a un tiempo de Planck, y para ella la realidad física comienza a los 10-43 segundos después del Big Bang.

Dicho de otra manera, las leyes físicas, incluidas las relativísticas y las cuánticas, dejan de tener sentido para duraciones menores que el tiempo de Planck o para distancias inferiores a la longitud de Planck. La época de Planck se entiende justamente como la fase entre 0 y 10-43 segundos durante la cual no existían las partículas elementales y las cuatro interacciones que hoy conocemos (fuerte, débil, electromagnética y gravitación) estaban unificadas. La época de Planck dio paso a la también brevísima fase inflacionaria, cuyo comienzo vendría marcado por la separación (decoupling) de la interacción fuerte de la electrodébil. Para dar una idea de las brevedades, un segundo después del Big Bang comenzaría la “época de la nucleosíntesis” (formación de los primeros núcleos atómicos), que habría durado no más de media hora y habría sido precedida por la “época de los leptones”, la “época de los hadrones”, la “época electrodébil” y la fase inflacionaria[2] más el tiempo de Planck.

………

Entre las predicciones más exitosas de la teoría del Big Bang (ajustada con la inflación) está la de las cantidades observadas en el universo de los distintos elementos químicos. En 1948 Ralph Alpher, bajo la dirección de George Gamow—un partidario temprano de las ideas de Lemaître—realizó cálculos acerca de las cantidades de hidrógeno, helio y otros elementos partiendo de la hipótesis del Big Bang, los que correspondían estrechamente a los valores observados[3].

A pesar de que el estudio postulaba un mecanismo de formación de elementos (captura de neutrones) que a la postre resultó insostenible, logró calcular correctamente las proporciones observadas de hidrógeno y helio, que componen el 99% de la “materia bariónica” (la que normalmente conocemos) presente en el universo.

Pero hay materia no bariónica: electrones libres, neutrinos, minúsculos cuerpos negros y otras especies exóticas de partículas. Es la existencia de esta “materia oscura”, junto con la “energía oscura” (no detectable porque ni emite ni absorbe suficiente radiación electromagnética), lo que completa la cantidad necesaria de materia para que el universo sea plano, y no uno condenado a una perpetua expansión y adelgazamiento. La materia bariónica representa sólo 4% de la energía presente en el universo, la materia oscura un 22% y la energía oscura, detectada en ciertas supernovas, el 74% restante.

Diagrama de la NASA que computa la energía oscura en 70% de la masa-energía que compone al universo. Por contraste, la masa total de las estrellas corresponde a solamente 0,5% de la masa-energía universal, o la octava parte de la presente en forma de hidrógeno y helio libres en el espacio. La materia no bariónica sería una cuarta parte del total.

¿Qué puede decirse de la arquitectura a gran escala del cosmos? Data ya de cierto tiempo atrás la observación de que las galaxias son agregados de estrellas y polvo interestelar, pero también se conoce desde hace tiempo la agrupación de galaxias en agregados o superagregados (clusters, superclusters) de galaxias, separados entre sí por enormes extensiones de vacío. Durante un tiempo se supuso que los superagregados eran las estructuras de mayor escala en el universo. En 1989, sin embargo, trabajando con datos del corrimiento hacia el rojo de las galaxias, Margaret Geller y John Huchra reportaron la existencia de una “Gran Muralla”, una descomunal lámina formada por galaxias cuyas dimensiones son de 500 millones de años luz de largo por 200 de ancho y 15 de espesor.

Luego de este hallazgo, las observaciones más recientes nos retratan un universo compuesto de gigantescas “burbujas” de vacío, delimitadas por láminas como la de la Gran Muralla o por “filamentos” integrados por galaxias, en los que los superagregados de galaxias son nódulos de mayor densidad aparentes en algunas regiones. Por encima de estas megaestructuras, por ahora, no parece haber estructuras mayores. Así se habla, a la escala de las murallas y filamentos, del “Fin de la Grandeza”.

En nuestro vecindario, y hacia el centro del superagregado local al que pertenece la Vía Láctea, se ha detectado una poderosa “anomalía” gravitacional. A este fenómeno se le ha dado el nombre de Gran Atractor—si se prefiere el más hermoso femenino, la Gran Atractriz—que afecta el movimiento de las galaxias relativamente próximas en una extensión de cientos de millones de años luz de ancho. Este Gran Atractor, descubierto en 1986, debe corresponder a una concentración especialmente densa de decenas de miles de galaxias, de modo de proporcionar una atracción gravitacional tan enorme como la medida. Su posición está entre las constelaciones de Centauro e Hidra, a una distancia de nosotros de entre 150 y 250 millones de años luz.

Una fotografía tomada desde el Observatorio de Europa del Sur en la dirección del Gran Atractor. Los objetos azulados son estrellas. Varias galaxias relativamente próximas se muestran en el campo como objetos de tono rojizo.

La exploración de estas inmensidades y la “arqueología” cósmica del Big Bang conducen inevitablemente a discusiones de carácter cosmogónico o religioso. La física cuántica, como vimos, rehúsa pronunciarse sobre lo que hubiera acontecido antes de que hubiesen transcurrido 10-43 segundos desde el instante inicial del Big Bang. En otros términos, ése sería el tiempo con el que contaría Dios para crear el universo entero, si es que fue esa entidad la que puede describirse como detonador del Big Bang y determinante de las constantes físicas—la velocidad de la luz, la de la gravitación universal, la constante de Planck, la de “estructura fina”—que a su vez determinan, junto con las cuatro interacciones del cosmos, la realidad y la evolución del universo.

Una lección de la geometría fractal, sin embargo, nos advierte que es perfectamente posible crear formas matemáticas de inconmensurable riqueza y complejidad a partir de fórmulas simplísimas. La iteración de la fórmula X = X2 + c que genera el llamado conjunto o curva de Mandelbrot[4], revela esta particularidad de las estructuras fractales, y ya sabemos que las formas fractales son las adecuadas para describir y modelar estructuras complejas como las del árbol circulatorio humano o de una hoya hidrográfica. Esta situación conducirá, probablemente, a una búsqueda por determinar empíricamente el “fractal del universo”: un solo número que explique la abrumadora diversidad del cosmos, cuyo retrato se hace cada vez más complejo. LEA

El conjunto de Mandelbrot. Sucesivas ampliaciones de cualquiera de sus regiones revelan una estructura de infinita complejidad.

[1] La entropía es una noción clave de la termodinámica, en la que designa una medida del grado de desorden de la materia. Un cristal, más organizado que una mezcla de gases, tiene mucho menos entropía que esta última. En todo intercambio calórico la entropía aumenta, y este cambio es irreversible. Con exactamente el mismo nombre—y la misma forma matemática—Claude Shannon propuso una “entropía” de la información, en su “Teoría de la Información”, adelantada en1940.

[2] Muy poco después de la época inflacionaria habría tenido lugar la formación de los quarks y los antiquarks. Éstos permitirían la “época de los hadrones”, cuando partículas como el protón y el neutrón habrían venido a la existencia.

[3] El artículo—The Origin of Chemical Elements—fue publicado en Physical Review bajo los nombres de Alpher, Gamow y el de Hans Bethe. La inclusión de este último, que contribuyó posteriormente con la teoría, fue una travesura de Gamow, para hacer un juego de palabras: Alpher, Bethe, Gamow, como las tres primeras letras griegas: alfa, beta, gamma. En un libro de 1952 (The Creation of the Universe—Gamow explica que Bethe, al conocer algunos problemas posteriores de la teoría “consideró seriamente cambiarse el nombre a Zacarías” y que, en cambio, R. C. Herman, que ayudó a Alpher con más refinados cálculos posteriores, rehusó “tercamente cambiarse el nombre a Delter”.

[4] Benoit Mandelbrot, matemático investigador del Thomas Watson Research Center de la compañía IBM, inició una revolución conceptual con su The Fractal Geometry of Nature (1982). En lecciones sobre este tema y sobre las teorías del caos y la complejidad, describiremos sus hallazgos y aportes especiales.

intercambios