por Luis Enrique Alcalá | Ago 22, 2006 | Fichas, Política |

LEA, por favor

La Facultad de Humanidades y Educación de la Universidad del Zulia cumplía treinta y cinco años de fundada en el año de 1994. Para esa ocasión, su Escuela de Comunicación Social organizó un coloquio sobre el tema «El comunicador necesario», con el objeto de discutir el enfoque primario en la formación de comunicadores. El punto central del debate era si debía formarse a un comunicador generalista o a un especialista.

El coloquio se celebró los días 19 y 20 de mayo de 1994, y tuve la suerte de participar en él como expositor inaugural. La Ficha Semanal #107 de doctorpolítico contiene el texto de mi intervención. Aunque su argumentación estaba concretamente dirigida a discutir sobre la formación del comunicador social en los albores del siglo XXI, exactamente la misma argumentación del texto puede hacerse para la formación superior inicial de cualquier universitario, y específicamente puede argumentarse—una opción a favor del generalista—en el caso de la formación del político. En 1990 el suscrito había compuesto un estudio sobre la calidad de la educación superior en Venezuela, donde observaba cosas como la siguiente:

«El sistema educativo tiene… una estrategia para protegerse de la obsolescencia de los conocimientos especializados. Luego de la carrera universitaria habitual, ofrece niveles cada vez más especializados y profundos: master o magister, doctorados, postdoctorados. Pero también se hace obsoleta la concepción general del mundo, de eso que los alemanes llaman Weltanschauung. Y para esto no existe remedio institucionalizado… Los norteamericanos tienen una estrategia de educación superior diferente a la de nuestras universidades, copiadas del estilo francés. Luego de lo que sería equivalente a nuestra escuela secundaria, su high school, el alumno norteamericano que ingresa a la universidad todavía debe pasar cuatro años de una educación de corte general. En sus colleges, pertenecientes a una universidad que también ofrece «estudios de graduados» (master en adelante), o en colleges independientes, los alumnos continúan en la exploración general del universo. Si bien ya se les facilita la expresión de intereses particulares, a través de un campo que enfatizan como un major, la salida es la de un grado de Bachellor in Science o de Bachellor in Arts, que refleja una gruesa división análoga a la de nuestros bachilleres en ciencias y en humanidades. Pero con una enorme diferencia. El tiempo dedicado al aprendizaje general es marcadamente superior en el bachellor estadounidense que en el bachiller venezolano. La edad en la que el bachellor debe escoger finalmente un campo de profesionalización es más madura que la que exhibe nuestro típico bachiller de 17 años. Luego, en dos años tan solo que toma el master de profesionalización, se obtiene un profesional capaz y más consciente de su papel general en la sociedad. La solución general al problema descrito debe pasar por la institucionalización en Venezuela de un sistema similar al del college norteamericano».

El coloquio de la Escuela de Comunicación Social de la Universidad del Zulia fue un evento refrescante y muy satisfactorio. Entre sus actividades se incluyó un concierto de la Orquesta Sinfónica de Maracaibo en memoria de Sergio Antillano, periodista y maestro de periodistas que había fallecido recientemente. La orquesta ofreció una brillantísima exposición de su pièce de résistance de esa noche: Las difíciles «Metamorfosis Sinfónicas sobre un tema de Carl Maria von Weber» de Paul Hindemith. Comunicación y arte son hermanas de gran vigor en la culta Maracaibo, y esa noche volvieron a estar juntas en el hermoso Museo de Arte Contemporáneo de Maracaibo que creó Lya Bermúdez, reconocida con justicia, este mismo año de 2006, con el Premio Nacional de Artes Plásticas.

LEA

…

Comunicador, político, médico general

Desde que escuché en la voz noble de Ana Irene Méndez la idea de este coloquio que celebra los 35 años de la Facultad de Humanidades y Educación, pensé que el tema y el concepto del mismo eran la expresión de una decisión producto de cerebros inteligentes. Aquellos indican que esta Facultad, que sin la comunicación no sería una institución universitaria, quiere repensar qué comunicación necesitamos y cuál es, en consecuencia, el comunicador necesario. Que me hayan invitado, además, a disertar de primero sobre un tema que me es tan placentero, la dialéctica de lo general y lo especial, sugiere una mágica conexión: con esta tierra, con esta gente. Es un grandísimo honor para mí, un motivo de íntimo orgullo, abrir este interesantísimo coloquio de la Facultad de Humanidades y Educación. Y como eran Ana Irene y Nerio quienes me invitaban, la excitación del ego se moderaba con la suave sensación de la amistad. Fue un gesto valeroso y conmovedor de Ana Irene, que jamás olvidaré, el que fuese a buscarme a mi casa, pocos días después de que yo cesase en mis responsabilidades de Editor Ejecutivo en el Diario Metropolitano La Columna (por discrepancias con algunos eclesiásticos y un banquero), para invitarme a que hablase a sus alumnos de la Escuela de Comunicación Social, cosa que hice semanas después durante un rato cuya longitud sorprendió a los alumnos, a Ana Irene y a mí.

Es pues el caso de una relación amorosa entre esta Universidad y yo, a la que he venido a conversar, con ésta, seis veces al menos en los últimos cinco años. Yo debiera programar ya mi peregrinación anual a esta Meca lacustre, aunque pensándolo bien, sería estupendo para mí que la frecuencia fuese mucho mayor. La vez anterior ha sido una precursora directa de este coloquio, pues se dio en ocasión de que el Vicerrectorado Académico de la Universidad del Zulia quisiera discutir sobre la reforma de pénsum en esta casa de luz.

Yo he estado, entonces, involucrado en esta tierra en cosas de la comunicación, y he participado en ella en cosas de la educación. Es una fortuna poder estar metido en ambas, en este coloquio, al mismo tiempo.

Las dicotomías son generalmente sospechosas, pues generalmente nada que exista es ejemplo de uno solo de los polos de una dicotomía. Centralización y descentralización, como explicaba Stafford Beer, coexisten en todo organismo biológico viable.

El bien y el mal usualmente cohabitan el alma de la gente, y es difícil encontrar los tipos puros o ideales. A pesar de eso, las dicotomías son útiles modos de discutir sobre la realidad y, en el caso de una orientación generalista o especializante en los procesos formativos y profesionales, esta distinción corresponde a una verdadera disyuntiva.

Desde que García Márquez comenzó una historia por su desenlace en «Crónica de una muerte anunciada», nos hemos acostumbrado a este orden inverso de las presentaciones argumentales. Comenzaré, pues, por declarar muy temprano mi preferencia personal por uno de los dos términos de la dialéctica generalista-especialista. Permítanme hacerlo a través de la relación de un cierto hallazgo pedagógico.

Era el año de 1975 cuando un pequeño grupo de investigadores operaba un experimento educativo, auspiciado por la Fundación Neumann, cuyo propósito ostensible era el de encontrar modos de convertir un mal aprendedor en un buen aprendedor, siguiendo la distinción de Postman y Weintgartner en «La enseñanza como una actividad subversiva».

Una de las varias hipótesis del proyecto de investigación, portador del nombre código de «Proyecto Lambda», era el de que el orden y método general de aproximación a la enseñanza de las distintas disciplinas, tenía mucho que ver con el deplorable rendimiento promedio de los alumnos en casi cualquier universidad venezolana. Es así como uno de los miembros del equipo, profesor de Química en dos universidades caraqueñas, acometió la conducción de un curso en Termodinámica guiado por un esquema secuencial distinto del habitual que, como sabemos, consiste en empezar el primer día por el primer tema de un programa para tratarlo durante varias semanas, para pasar luego al segundo tema por varias semanas más, y así sucesivamente.

En cambio, el Dr. Juan Forster optó por exponer a sus alumnos, en menos de una semana, una visión general del campo de la Termodinámica. Esta disciplina, como toda ciencia, consiste en verdad en una media docena de conceptos clave: energía, calor, entropía, etc. Cada uno de estos conceptos genera un amplio capítulo que se despliega luego con el detalle de los especialistas. Lo que hizo el Dr. Forster, como lo había hecho yo un año antes con alumnos de la Escuela de Educación de la Universidad Central de Venezuela, fue mostrar a sus alumnos una temprana visión desde la cima, lo que permitió a éstos percibir la arquitectura del campo y entender las relaciones generales entre los conceptos fundamentales del territorio termodinámico. A continuación, readoptó el método convencional de la explicación detallada secuencial.

El hallazgo fue el siguiente: los alumnos sujetos a esta experiencia no sólo mostraron un rendimiento superior en sus calificaciones académicas en comparación con los alumnos de un curso tradicional de Termodinámica, sino que aventajaron considerablemente a estos últimos en materia de tiempo. Cuando el curso llegaba al mes de abril de 1976, sus alumnos del curso piloto llevaban una ventaja de casi dos meses sobre los alumnos del curso regular, y al mes siguiente habían concluido el programa, lo que les dio tiempo suficiente para repasar con holgura lo ya visto.

Es decir, la percepción global del campo estudiado desde el mismo inicio de la experiencia, aumentó considerablemente la eficiencia pedagógica.

Esta experiencia, junto con sesgos personales que admito, me hacen un decidido partidario de los generalistas, sin que por eso desconozca que los especialistas son necesarios y tienen un grande e indudable valor. Si yo hubiera completado la carrera de Medicina que llevé hasta la mitad, habría escogido ser un médico internista general, y seguramente opté al final por la Sociología en razón de la generalidad de este campo. Así que admito un marcado sesgo personal a favor de una formación de orientación general. Que este enfoque no es sostenible para muchos casos de carreras y profesiones, es definitivamente obvio. Pero que para el caso de la enseñanza de la Comunicación Social la estrategia adecuada es la que enfatiza la formación general, es la tesis que intentaré sustentar en lo que sigue.

………

Preguntarse hoy por el comunicador necesario, en este Coloquio de la Facultad de Humanidades y Educación de la Universidad del Zulia, no debe ser un ejercicio insensible a la historia, intemporal, sin referencia o intención respecto de la época actual y de la que ya se avizora en el futuro con bastante claridad. Pienso en cambio que queremos inquirir por el comunicador necesario en esta bisagra de edades que viene siendo el fin de milenio que nos aloja. Por eso tiene pertinencia que establezcamos los rasgos sobresalientes de esta transición histórica, a fin de pensar acertadamente sobre la formación del comunicador necesario.

En el espacio del que dispongo destacaré solamente dos de los múltiples rasgos de la época actual, de este cierre y esta apertura de siglo y de milenio, que en particular me parecen pertinentes al dilema que se me ha encomendado comentar.

El primero de estos rasgos tiene una relación muy directa y esencial con los objetivos de una escuela de Comunicación Social, y es que estamos asistiendo a una brusca expansión del tejido nervioso societal, que no es otro que el tejido comunicacional: satélites, computadoras, módems y telefacsímiles, sensores remotos, fibras ópticas, telefonía celular, medios de almacenamiento compactos y compresión de la información.

Así como la embriología comparada muestra cómo es que el desarrollo de un sistema nervioso progresivamente cefalizado es el signo del crecimiento y humanización de la conciencia, así el desarrollo de la esfera comunicacional, a escalas inéditas de planetización, introduce toda una mutación histórica cualitativa y cuantitativamente insólita, por lo que no sé qué mosca ha llevado a Fukuyama a declarar el fin de la historia. Ahora es cuando la historia verdaderamente comienza.

Por un lado, pues, este desarrollo de las redes de comunicación a escalas imprevistas—salvo para algunos observadores privilegiados como Pierre Teilhard de Chardin—determina una situación radicalmente nueva y exige la presencia de un comunicador que se entienda a sí mismo como miembro de una función planetaria.

Permítanme confiar a Uds. lo que creo fue la variable crucial en el éxito del Diario Metropolitano La Columna entre septiembre de 1989 y abril de 1990, lapso que especifico y acoto porque entiendo que muchas cosas cambiaron en ese periódico a partir de esa última fecha.

De todos los posibles aciertos que el equipo de proyecto tuvo, seguramente fueron las hipótesis acerca del lector de Maracaibo lo que determinó el logro alcanzado. Eran dos las hipótesis: la primera establecía que el lector de Maracaibo es un lector inteligente, que prefiere que se le eleve y no que se le chabacanice. Pero la segunda era aún más importante: y esta fue la hipótesis que nos guió a dirigirnos a ese lector en tanto ciudadano del mundo. Ya no pensar en el lector maracaibero como el eterno sojuzgado del centralismo caraqueño, sino como ciudadano del mundo, parte integral de la conciencia del mundo, responsable por el planeta entero.

En cuanto el lector de Maracaibo entrevió esa verdad, en cuanto supo que su casa era el planeta, desbordó su lealtad en favor de un periódico que lo entendía de ese modo. Eso ya es historia: entre septiembre de 1989 y febrero de 1990, La Columna pasó de una circulación de cero a una de 49.700 ejemplares diarios de circulación pagada y dos meses más tarde se hacía acreedor al Premio Nacional de Periodismo.

El ámbito planetario, pues, hoy en día una realidad tan pronta e inmediata como el localismo más extremo, exige un comunicador de visión y vocación universales.

………

Pero junto con este rasgo crucial de la época, observamos otro igualmente marcador. La época que nos toca habitar es singularmente difícil porque en ella se produce la crisis de tantos paradigmas que es propio hablar de toda una metamorfosis de la episteme general.

Obviamente, empleamos el término paradigma en el sentido que le dio Thomas Kuhn en «La estructura de las revoluciones científicas», y el concepto de episteme según la noción desarrollada por Michel Foucault en «Las palabras y las cosas».

El siglo XX se inicia, en términos epistémicos, con una ruptura paradigmática en el propio año de 1900, cuando Max Planck introduce el concepto de discontinuidad de la energía calórica. A partir de allí, Einstein generaliza en 1905 la noción de quanta a todas las manifestaciones de la energía e introduce el modelo de la relatividad, que en 1916 incluye ya una teoría de lo gravitatorio que sustituye sin destruirlo al esquema newtoniano; en 1921 Ludwig Wittgenstein busca establecer los límites del pensamiento mismo; en 1927 Werner Heisenberg postula su principio de indeterminación; en 1931 Kurt Gödel anuncia a los matemáticos que más allá de cierto punto de riqueza semántica un sistema matemático será forzosamente inconsistente.

Esta revolución en la física continúa vigente, como siguen en despliegue asombroso los nuevos ríos epistémicos de la biología: la genética como ingeniería, la ecología.

Y lo mismo ocurre en las ciencias de la acción humana, como la política, y más allá de cada una de estas disciplinas la ciencia de lo complejo, de lo caótico, produce verdaderas rupturas y reacomodos de la episteme: el contenido total de lo pensable por esta época.

Es así como estamos asistiendo, Sr. Fukuyama, a una nueva época, a una nueva edad de la historia. Cuando aprendíamos Historia Universal en la escuela primaria nos enseñaban a dividirla en dos eras, la Prehistórica y la Histórica, y a dividir a la vez a ésta en cuatro edades: Antigua, Media, Moderna, Contemporánea. Pues bien, es tiempo de que tomemos conciencia de que estamos, no ya cerrando un siglo, no ya cerrando un milenio y abriendo otro, sino en el mismo comienzo de una nueva edad de la historia, la que me atreveré, en este auditorio de la Facultad de Humanidades y Educación de la Universidad del Zulia, a bautizar con un nombre: la Edad Compleja.

Ante esta vastísima e intrincada metamorfosis no hay mejor o más inteligente estrategia que la búsqueda de una formación general más rica y avanzada, más modernamente orientada, que la que obtiene el venezolano que cursa los estudios de bachillerato. Intentar dominar esa transformación desde una profesionalización excesivamente temprana, a partir de la base clásica que determinan los actuales programas de educación secundaria en Venezuela, es una tarea imposible.

Nuestro bachiller, nuestro mejor bachiller, es una cabeza clásica, formada en la física de Newton, detenida en el tiempo histórico del siglo XIX. El énfasis es puesto en lo canónico, en lo clásico, en el pensamiento antiguo. Se privilegia a Platón, a Hobbes, a Dalton, a Darwin, mientras se regatea la noticia sobre Einstein, Gell-Mann, Mandelbrot o Prigogine.

Es preciso impartir instrucción sobre el trabajo de los más recientes pensadores, y si en algún caso esto es más necesario es en el caso de la formación del comunicador social. Naturalmente, el adiestramiento en las más modernas herramientas de la comunicación es tarea imprescindible. No es correcto graduar comunicadores de la prehistoria informática. Pero tal vez sea más esencial, junto con la enseñanza del análisis textual y la redacción y la edición, junto con la información sobre los medios—que ahora se confunden y solapan en el concepto de multimedia—programar una educación intensa y general del estudiante en el borde mismo de la episteme actual.

Esta es una misión que debiera cumplir el sistema de educación superior, no una escuela de Comunicación Social. Pero nuestras universidades están estructuradas de forma tal que lo que enseñan—en la mayoría de los casos—es una profesión que ha dejado atrás, a la responsabilidad de la educación media, esa formación general.

Tal vez entonces, una escuela como la Escuela de Comunicación Social de la Universidad del Zulia pueda acometer un reacomodo de su pénsum de estudios que sirva de modelo al resto de la Universidad, tomando sobre sí una responsabilidad que, en principio, no corresponde a una escuela de profesionalización. En ese caso, las estrategias de compresión y aceleración de la formación general serían muy útiles. Un diseño mínimo comprendería una cátedra de estudios generales a lo largo de la carrera, junto con un programa de formación de profesores de la Escuela con una óptica generalista, que en todo caso siempre sería necesario. Mi recomendación precisa se restringiría, entonces, a la incepción de este programa de actualización o formación de profesores. Con unos profesores actualizados en la episteme de este fin de siglo sería más productivo un debate interno acerca de la reforma del pénsum de Comunicación Social, así como fluiría más naturalmente, insertado en cada instancia particular, en cada materia y actividad de la carrera, el «bachillerato superior» que nos está haciendo falta.

Que esto es posible dentro de la Escuela de Comunicación Social, dentro de esta Facultad de Humanidades y Educación que ha arribado a su trigésimo quinto aniversario, es acto de fe que ofrezco junto con mi entera disposición a contribuir a su conversión en realidad.

LEA

_______________________________________________________________

por Luis Enrique Alcalá | Ago 17, 2006 | LEA, Política |

No parece auspicioso para un partido político relativamente recién nacido exhibir fuertes divisiones en su seno. Que un grupo de importantes dirigentes de Primero Justicia desconozca a las autoridades del partido—o a sus decisiones—no augura nada bueno para una organización que, al decir de Carlos Ocariz y sus muy precisos cálculos, aportará exactamente 3.963.008 votos, ni uno más ni uno menos, a la candidatura de Manuel Rosales.

En la sala Ana Julia Rojas del Ateneo de Caracas, Ramón López, Gerardo Blyde, Liliana Hernández, Leopoldo López, Ramón José Medina y Delsa Solórzano, declararon, por boca del primero (Coordinador General de Primero Justicia en Caracas), que desconocerán «a aquellos que arbitraria e ilegítimamente pretenden conducir al partido de espaldas a la militancia y a las bases. No reconocemos sus decisiones e instrucciones». Se referían, primariamente, a Julio Borges, y a la decisión de separar a Blyde de la Secretaría General del partido.

No se trata de militantes cualesquiera. Además de que Ramón López es autoridad partidista, Liliana Hernández y Ramón José Medina, venida una de Acción Democrática y el otro de COPEI, han sido dirigentes emblemáticos—otrora diputados de la Asamblea Nacional—así como lo han sido el más vistoso de la pareja de alcaldes justicieros, Leopoldo López, Delsa Solórzano—ex consultora jurídica de la Coordinadora Democrática—y nadie menos que Gerardo Blyde, hasta hace nada Secretario General de Primero Justicia. (Blyde, que es persona en extremo inteligente, saltó a la notoriedad en 1999, cuando un recurso suyo ante la extinta Corte Suprema de Justicia forzara una nueva redacción del decreto de Chávez para un referendo consultivo sobre la elección de una asamblea constituyente. Luego jugaría por un tiempo como segundo de Alberto Franceschi—ex diputado constituyente, ex militante de Proyecto Venezuela y de Acción Democrática, ex trotskista—en la idea de constituir una nueva fuerza política, antes de sumarse a las filas de Primero Justicia).

Esta división viene preparándose desde hace un buen tiempo. Ya el año pasado Julio Borges conjuró un alzamiento de la misma fracción con ayuda de los secretarios regionales de Primero Justicia. Se exigía al partido elecciones de base para relegitimar sus autoridades y Borges logró posponerlas para 2007. Ahora irrumpe el cisma sobre líneas políticas, y Blyde ha sido acusado de abstencionista. Para desmentir tal especie, el grupo reunido en el Ateneo anunció su apoyo a la candidatura de Rosales.

También antes de estos más recientes incidentes, una competencia entre Borges y Leopoldo López por la candidatura presidencial de Primero Justicia se había hecho notar. Entre el 10 y el 23 de septiembre de 2005 Alfredo Keller había levantado los datos de encuesta cuyos resultados fueron conocidos poco después. Al preguntar por nombres de personas que fuesen reconocidas como líderes, Julio Borges fue mencionado por el 40% y Leopoldo López, demasiado cerca, por 39%.

LEA

por Luis Enrique Alcalá | Ago 17, 2006 | Complejidad, Otros temas |

Benoît Mandelbrot

Una introducción general a los novísimos conceptos de la Teoría del Caos. Poincaré, Julia y Fatou; Lorenz y Mandelbrot. Los fractales: la herramienta matemática del caos y la complejidad.

En el año de 1972 se publicaba Stabilité structurelle et morphogénèse, la obra cimera del matemático francés René Thom (1923-2002). Anunciada como una revolución, trataba de ciertas transformaciones repentinas en formas básicas, especialmente las formas biológicas. Comoquiera que estas transformaciones implicaban una ruptura entre formas sucesivas, se las llamó “catástrofes”,[1] y de hecho se dio en decir que Thom había inventado una “Teoría de Catástrofes”. No pasaría mucho tiempo, sin embargo, hasta que las esperanzas puestas en esta teoría—que resolvería el misterio de las formas y sus cambios, de sus metamorfosis—se mudaran al campo de otra teoría nueva, que por casualidad también tenía un nombre ominoso: la Teoría del Caos.

Pero antes de que la noción de caos dominara la imaginación de los científicos, el esfuerzo de Thom fue saludado como el portador de un nuevo paradigma. El mismo Thom exponía el asunto en la introducción de su libro:

El uso del término «cualitativo» en ciencia y, sobre todo, en física tiene resonancia peyorativa. Fue un físico quien me recordara, no sin vehemencia, la sentencia de Rutherford: «Lo cualitativo no es otra cosa que pobre cuantificación»… La historia ofrece otra razón a la actitud del físico hacia lo cualitativo. La controversia entre los seguidores de la física de Descartes y los de la de Newton llegó a su cúspide a fines del siglo XVII. Descartes, con sus vórtices, sus átomos ganchudos y nociones similares, explicaba todo pero no calculaba nada; Newton, con su ley de proporcionalidad inversa, calculaba todo pero no explicaba nada. La historia ha avalado a Newton y relegado las construcciones cartesianas al dominio de la especulación curiosa. Ciertamente, el punto de vista newtoniano se ha justificado plenamente a sí mismo desde el punto de vista de su eficiencia y su capacidad de predecir, y por tanto de actuar sobre los fenómenos. En el mismo espíritu, es interesante releer la introducción a los «Principios de Mecánica Cuántica» de Dirac, en la que el autor desestima como sin importancia la imposibilidad de ofrecer un contexto intuitivo para los conceptos básicos de los métodos cuánticos. Pero estoy seguro de que la mente humana no estaría plenamente satisfecha con un universo en el que todos los fenómenos estuvieran gobernados por un proceso matemático que fuera coherente pero totalmente abstracto. ¿No estaríamos entonces en el País de las Maravillas? En una situación en la que el hombre se vea privado de toda posibilidad de intelectualización, esto es, de interpretar geométricamente un proceso dado, o bien buscará crear, a pesar de todo, a través de interpretaciones adecuadas, una justificación intuitiva del proceso, o bien se hundirá en resignada incomprensión que el hábito trocará en indiferencia… El dilema que toda explicación científica confronta es éste: magia o geometría. Desde este punto de vista, los hombres que luchan por comprender nunca tendrán hacia las teorías cualitativas y descriptivas de los filósofos, desde los Presocráticos hasta Descartes, el punto de vista intolerante de una ciencia cuantitativa dogmática.

Así que el libro de Thom era también un manifiesto. Era una rebelión ante una ciencia analítica, casada con una matemática de cálculo, que despreciaba todo lo que cálculo no fuera. Pero a pesar de que Thom rozó nociones que luego serían de gran importancia para el tratamiento matemático de sistemas que exhiben comportamiento caótico—la de “atractrices”, por ejemplo—su “Teoría de Modelos”[2] no era la matemática que se necesitaba. Sólo hubiera tenido que buscar en su propio país, pues los franceses Henri Poincaré (1854-1912), Gaston Julia (1893-1978) y Pierre Fatou (1878-1929) fueron los verdaderos precursores de lo que hoy llamamos Teoría del Caos y de la noción matemática de fractales.

Un típico diagrama de René Thom, que compara la morfogénesis de dos especies de levadura. Es de notar en el eje de ordenadas la mención de un “parámetro interno cualitativo”: la forma.

La preocupación de Thom es la forma, y la conversión de una forma en otra a través de bruscas transiciones a las que denominó catástrofes. Es esto lo que modela su topología. Reconoce, ciertamente, algunos precursores, entre los que destaca D’Arcy Thompson (1860-1948), el autor de On Growth and Form (1917), una obra descriptiva que ponía de manifiesto la comunidad de formas entre entidades de distintísimo substrato.[3] En cambio, no hace mención de Laws of Form (1969) del inglés G. Spencer Brown (1923-), obra que trata el problema como parte de la lógica.[4] Su autor describía así su contenido: “El tema de este libro es que un universo salta a la existencia cuando un espacio es amputado o descompuesto”.

………

Dos figuras relativamente recientes son, en cualquier caso, los reales “descubridores” o pioneros del campo dual de caos y fractales: Edward Lorenz, del lado fenomenológico, y Benoît Mandelbrot del lado simbólico o matemático.

Por lo que respecta a Lorenz (1917-), matemático norteamericano dedicado a la meteorología, su tropiezo “serendípico” con el caos es ya bastante conocido. En 1959 manipulaba el clima artificial y meramente simbólico de sus modelos matemáticos en su primitivo computador Royal MacBee. Había formulado ecuaciones que relacionaban variables como temperatura y presión atmosférica y confiado al computador el tedioso cálculo de las interacciones, el que imprimía tablas de resultados y hasta un escueto gráfico que mostraba las oscilaciones del clima a lo largo del tiempo. El computador de Lorenz no tenía mucha capacidad: sólo podía calcular hasta seis posiciones decimales. Pero el impresor era aun más lento, y por tal razón se le pedía que imprimiese los sucesivos valores sólo hasta los tres primeros decimales.

Un buen día Lorenz notó un segmento de gráfico que llamó su atención, por lo que se dispuso a correr el modelo de nuevo en el computador, a fin de examinar con mayor atención el episodio de su interés. Pero en lugar de arrancar los cálculos desde el inicio, dada la lentitud del cómputo, decidió tomar como condiciones iniciales valores previos de las variables cercanas a la zona interesante de las curvas. Así, tomó las hojas impresas, seleccionó un punto en el tiempo, previo pero no muy lejano, leyó los valores correspondientes, los ingresó manualmente a la máquina y arrancó el cómputo. Luego, para evitar el tedio, se fue a tomar café.

Cuando Lorenz regresó a su laboratorio se llevó una sorpresa mayúscula. El impresor trazaba ahora trayectorias enteramente distintas para las variables, y el gráfico no se parecía en nada a lo que originalmente había despertado su curiosidad. Al principio creyó que la causa sería un desperfecto repentino en el computador, o tal vez un error en su sistema de ecuaciones. Poco después encontró la verdad: en realidad no había especificado exactamente las mismas condiciones iniciales, pues leyó valores impresos con tres decimales redondeados, cuando entretelones el computador calculaba seis posiciones decimales. El error de una diezmilésima en la condición especificada para el nuevo cómputo había generado, con el paso del tiempo, discrepancias de gran magnitud. Había nacido la ciencia del caos.

Rápidamente Lorenz sacó la consecuencia: los sistemas complejos revelan una gran sensibilidad a las condiciones iniciales, y una pequeñísima diferencia en éstas puede acarrear a la larga diferencias descomunales.[5] La metáfora con la que este carácter de los sistemas complejos se popularizó adoptó ropaje, naturalmente, climatológico. Se la bautizó como el principio del ala de mariposa: en un sistema tan complejo como el clima, el aleteo de una mariposa en China puede causar un temporal en California.[6]

¿Por qué era esto el preludio de una revolución? Una de las consecuencias de la sensibilidad a las condiciones iniciales que exhibe la dinámica de los sistemas complejos—compuestos por gran número de elementos—es que son fundamentalmente impredecibles. Pero esta impredecibilidad no se deriva, en este caso, de una esencia azarosa, como sí es el caso de los sistemas probabilísticos de la física cuántica. Acá un sistema regido por leyes estrictamente deterministas y que pudiera, habitualmente, “portarse bien”, puede atravesar fases caóticas que son absolutamente impredecibles, porque no se puede conocer con precisión arbitraria su condición inicial.

Era con esto, justamente, con lo que se había topado Poincaré. Al formular su teoría de la gravitación universal, Isaac Newton, reconociendo naturalmente que sobre la trayectoria de la Tierra no solamente influye la masa del Sol, sino las de los restantes planetas del sistema solar—y en estricto sentido la de cualquier otro objeto en el espacio—optó por calcular las atracciones mutuas para una abstracción de sólo dos cuerpos interactuantes, puesto que la introducción de uno solo adicional excedía la capacidad de cálculo de las matemáticas de su época. (The two-body problem). Poincaré trabajó, para un premio que Oscar II de Suecia estableciera, sobre el n-body problem, en su caso referido a la interacción de sólo tres cuerpos. Aun en un sistema en apariencia tan sencillo como el de tres astros, Poincaré encontró incertidumbres irresolubles. Es decir, se encontró con el caos determinista. Un sistema con reglas o leyes físicas perfectamente determinadas puede conducir a la impredecibilidad, a una situación en la que la dinámica ni es lineal, ni es periódica, ni es probabilística, y sin embargo es impredecible.

Pero el trabajo de Lorenz condujo a un hallazgo tal vez más sorprendente todavía. Al analizar el curso de sus ecuaciones para los distintos valores con los que las alimentara, encontró que no cualquier resultado era posible, sino sólo unos específicos que, trazados en un sistema de coordenadas, describían una curva con un alto grado de orden, con un dibujo muy preciso. Debajo del trazado caótico subyacía un orden estricto.

La atractriz de Lorenz es una curva de dos lóbulos que describe una trayectoria que nunca se repite, y que representa los sucesivos estados del clima modelado en sus ecuaciones.

Antes de Lorenz ya se tenía la noción de atractriz: un punto, una curva o una región del espacio hacia el que tiende un sistema determinado. (Una hoya de atracción—en sentido hidrográfico, como la hoya de los afluentes de un río principal—es una forma de atractriz). Un modelo sencillo de un sistema de atractrices lo constituye un péndulo que oscila a poca distancia de una base hexagonal, en cuyos vértices se han colocado imanes de aproximadamente igual intensidad magnética. Tomando el péndulo entre los dedos se le dota de un impulso inicial que, al soltarlo, lo hace describir una trayectoria que bajo la acción de los imanes es típicamente errática. Al agotarse el impulso inicial el péndulo se detiene sobre uno de los vértices (una de las atractrices). Incluso en un sistema tan sencillo como éste, no es posible predecir cuál será la atractriz que predominará al final, aun cuando la trayectoria del péndulo, transportada a un sistema de coordenadas, describe una curva particular y definida. Para el tipo de atractriz con el que Lorenz se encontró, el meteorólogo matemático acuñó el concepto de atractriz extraña.[7]

Después de estas cosas climáticas sobrevendría una nueva sorpresa: muchos otros sistemas, de naturaleza o substrato enteramente diferente al del clima terrestre, exhibían igualmente comportamiento caótico, determinado pero impredecible. Por ejemplo, la evolución de poblaciones dentro de un sistema ecológico, o el flujo turbulento, o el ritmo cardiaco—que de su periodicidad regular, registrada en los electrocardiogramas que nos son ya familiares, puede degenerar en la señal caótica de la fibrilación—o el movimiento de precios de una bolsa de valores, o el pink noise que los ingenieros de sonido emplean para calibrar equipos, o ciertas reacciones químicas “disipativas” (de energía), o la distribución espacio-temporal de los sismos, o la de las revoluciones sociales[8] y las guerras, son todos sistemas que exhiben fases caóticas, impredecibles. Por si esto no fuera suficiente, poco después se encontró que el comportamiento de estos sistemas, todos de naturaleza distinta, sigue un mismo patrón matemático.

Por ejemplo, prontamente se notó que, si bien las variaciones en estos sistemas parecen totalmente erráticas, había secuencias de variación que se repetían, que eran muy parecidas a otras anteriores o posteriores al paso del tiempo. Había en estos fenómenos una autosimilaridad: se parecen a sí mismos en momentos distintos del tiempo.

Lorenz, por supuesto, era matemático, y fue capaz de reconocer que su atractriz no era común, de allí el apelativo de extraña, que le endilgó. Pero tendría que venir otro matemático para hacer la formulación definitiva sobre la matemática que era capaz de describir adecuadamente fenómenos tan disímiles y tan parecidos a la vez.

Benoît Mandelbrot (1924-), matemático de origen polaco y nacionalidad francesa—aunque vive desde hace mucho en los Estados Unidos—publicó en 1982 la summa de una nueva y revolucionaria geometría: la geometría fractal.

Mandelbrot había venido estudiando dos conjuntos aparentemente disímiles de fenómenos. Por una parte, el comportamiento histórico de los precios del algodón, en los que esperaba desentrañar algún concierto; es decir, un proceso temporal. Por la otra, la irregularidad de las costas; esto es, un problema espacial o geométrico. Acometió ambos problemas mientras era investigador del Thomas J. Watson Research Center de la compañía IBM.[9]

En el primer caso encontró la propiedad de autosimilaridad ya mencionada. Específicamente, encontró que los precios del algodón no seguían una distribución gaussiana o “normal”, sino una “distribución estable de Levy”. (Una distribución “estable” se caracteriza porque la suma de muchas instancias de una variable aleatoria exhibe exactamente la misma distribución pero a otra escala, o sea, exhibe “invariancia a la escala”; en otros términos, exhibe autosimilaridad espacial, se parece a sí misma a distintas escalas).[10]

Pero es que exactamente lo mismo halló al acometer el estudio de la irregularidad de una costa—How Long Is the Coast of Britain? Statistical Self-Similarity and Fractional Dimension, 1967—tomando base en trabajos de Lewis Fry Richardson, quien ya había señalado que la longitud de una costa dependía del tamaño de la unidad de medida.

Una menor unidad de medida computa una longitud mayor

Al discutir lo postulado por Fry Richardson, Mandelbrot asoció la observación con un concepto de “dimensión fraccionaria”, o dimensión de Haussdorf. Ciertas figuras son caracterizadas por tener una “dimensión” intermedia entre las que conocemos habitualmente, y que son estipuladas con números naturales: un punto tiene dimensión 0, una línea dimensión 1, un plano dimensión 2, un cubo dimensión 3, etcétera. Ciertas estructuras, calculada su dimensión con ciertos métodos, tienen una dimensión que es, digamos, más de uno pero menos de dos. Por caso, la dimensión “fractal” de las costas de África del Sur es de 1,02, mientras que la de la costa occidental de Inglaterra es medida en 1,25. Del mismo modo, el árbol arterial humano tiene una dimensión fractal de aproximadamente 2,7, a pesar de ocupar él mismo un espacio tridimensional.[11]

Es justamente esta dimensión fractal, o fractalidad, lo que define la irregularidad característica de ciertas formas. La de las costas es una, la de las cadenas montañosas otra, la de las hoyas hidrográficas otra distinta. Y es esta dimensión fractal, por último, la que determina la autosimilaridad. Vista a distintas escalas, la línea de una costa se parece a sí misma.

Seis años después del artículo sobre la dimensión de la costa de Inglaterra, proponía Mandelbrot el término fractal—derivado del latín fractus (fracturado) que nos da fracción—en Les objets fractals, forme, hasard et dimension. Y en 1982 la obra más general y completa The Fractal Geometry of Nature.

Fue su estudio de estructuras matemáticas entrevistas a comienzos del siglo XX por Gaston Julia y Pierre Fatou, lo que llevó a Mandelbrot a describir la estructura matemática que le dio más fama: el conjunto o curva de Mandelbrot. Los precursores franceses habían descubierto las bases fundamentales de esa estructura, pero carecían de una herramienta lo suficientemente poderosa como para visualizarla: el computador. Esta curva, como muchas otras estructuras fractales, es producida por recursión, esto es, por iteración o repetición de un mismo cálculo, el que se realimenta con cada nuevo resultado. La fórmula esencial ya había sido propuesta por Fatou:

X = X2 + c

Un número X es elevado al cuadrado y se le suma un cierto parámetro fijo c. Este resultado es a su vez elevado al cuadrado y sumado a c, y así sucesivamente. Cada resultado es marcado en un sistema de coordenadas y esto define una curva muy extraña en el plano. (Una curva de Mandelbrot, a escala general, se muestra más abajo).

La gran síntesis no tardaría en darse: las matemáticas fractales, que definen una autosimilaridad espacial, son las adecuadas para modelar e interpretar la autosimilaridad temporal de los sistemas caóticos. La geometría fractal es el lenguaje del caos. LEA

La curva que define el conjunto de Mandelbrot, el icono del caos. El “borde” que limita el espacio en color negro, amplificado incesantemente, revela una complejidad inagotable, al tiempo que exhibe la propiedad general de los fractales y los sistemas complejos: su autosimilaridad.

[1] El término “catástrofe” tiene un sentido técnico-matemático en el campo de la rama matemática conocida como Topología. En términos muy gruesos y analógicos, la topología es la rama de la geometría que se ocupa de las propiedades morfológicas que permanecen invariables bajo deformaciones continuas. Si se imagina a un cuerpo como una taza construida con una buena plastilina, es posible deformarlo sin rasgarlo para convertirlo en un aro, y la taza y el aro son entonces topológicamente equivalentes: ambos tienen un agujero por el que se pasa de un lado al otro. El aro es en sí mismo un agujero; el asa de la taza es otro. En cambio no sería topológicamente equivalente la montura de unos lentes, puesto que tiene dos agujeros en lugar de uno.

[2] El subtítulo del libro de Thom es, precisamente, “Esquema de una Teoría General de Modelos”.

[3] Por ejemplo, un corte transversal de la cabeza de un fémur revela laminillas óseas (trabéculas) dispuestas en arcos ojivales de gran semejanza con un arco de arquitectura gótica; o la anatomía de una medusa corresponde a la forma que genera una gota que cae en el seno de un líquido viscoso. Thompson, sin embargo, se limitó a registrar estas analogías taxonómicamente, sin proporcionar una teoría que explicase las similitudes. Tal vez por esto él mismo escribió: “Este libro mío tiene poca necesidad de prefacio, puesto que en verdad no es más que un prefacio de principio a fin”.

[4] El libro de Thom aparece (1972) tres años después del de G. Spencer Brown, pero Jorge Luis Borges ha opinado que “Uno crea sus propios precursores”. Laws of Form se convirtió en objeto de culto en la década de los setenta, y fue incluido en un curioso libro con el título de Whole Earth Catalogue, uno de cuyos editores fue un antipático pero interesante promotor cultural de nombre John Brockman. El autor de esta lección fue miembro, junto con Brockman, de una indisciplinada asociación de intelectuales basada en Nueva York: The Reality Club, del que éste fue fundador.

[5] Esta característica de los sistemas complejos salva, justamente, la trascendencia de lo individual, de lo más pequeño, aun en medio de la mayor enormidad. El más pequeño acto individual determina la forma del futuro, y por tanto la complejidad no es excusa para prescindir de la ética personal, así como el conjunto no puede ser pretexto para dañar a la parte.

[6] Una conferencia de Lorenz en 1972 llevó por título Does the flap of a butterfly’s wings in Brazil set off a tornado in Texas? En un cuento de Ray Bradbury (A Sound of Thunder), recogido en “The Science Fiction’s Hall of Fame”, unos excursionistas que viajan con una máquina del tiempo a un “parque jurásico” se salen del área permitida y pisan inadvertidamente algo de hierba y una mariposa en el pasado remoto. Al regresar al presente comprueban que las cosas son distintas a las que dejaron, y la sociedad democrática en la que vivían acaba de elegir a un candidato que suena muy parecido a Hitler. El artículo técnico de Lorenz sobre la sensibilidad a las condiciones iniciales de un sistema dinámico se publicó en 1963, con el título Deterministic nonperiodic flow.

[7] En inglés, strange attractor.

[8] Los acontecimientos del 27 y el 28 de febrero de 1989, por ejemplo, son más fácilmente comprensibles si se les interpreta como un caso de proceso caótico, antes que como resultado de una acción subversiva intencional. El 27 de febrero de 1989 pudo observarse la propagación de la avalancha desde Guarenas, exacerbándose por la transmisión del evento a través de los medios de comunicación social, pero también a través de una cadena informal de transmisión de información: los mensajeros motorizados, que exhiben desde hace mucho una rápida solidaridad de conducta y que fueron propagando el descontento desde Guarenas a Petare, de allí a Chacaíto, a la estación del Metro en Bellas Artes, y así sucesivamente.

[9] Mandelbrot ingresó a IBM en 1958, y trabajó por 32 años en el Watson Center. Hoy en día es Fellow Emeritus de ese instituto.

[10] Una lata de Toddy, la popular bebida achocolatada, muestra la figura de un bebé que sostiene en sus manos una lata de Toddy, la que naturalmente tendrá también otro bebé más pequeño que sostiene otra lata, und so weiter.

[11] En lecciones posteriores describiremos con detalle la noción de dimensión fractal y nos familiarizaremos con un método particular de calcularla.

_______________________________________________________

por Luis Enrique Alcalá | Ago 17, 2006 | Cartas, Política |

Los extremos se tocan, es dicho que se aprende temprano. Esto es, los dos lados de una polarización se parecen, usan procedimientos parecidos, actúan de forma similar. En su época, Georg Wilhelm Friedrich Hegel destacaba cómo los más encarnizados enemigos, a través de la lucha, terminaban pareciéndose entre sí. Este fenómeno permitió que, a comienzos de 2004, la psicóloga jungiana Magaly Villalobos presentara una ponencia ante un congreso de su disciplina, en la que describía la generación de discursos mitológicos por parte del polo gobiernero y el opositor. (Desde el animismo marialióncico y santero del gobierno hasta la involucración de la Virgen María—que incluyó estampitas blandidas por Gente del Petróleo—por parte de la oposición radicalizada). La Dra. Villalobos tituló su ponencia Caimanes de un mismo caño.

Esta semana puede compararse las emisiones de dos de estos caimanes: Ricardo Estévez, directivo de Súmate, y Tibisay Lucena, Presidenta del Consejo Nacional Electoral. Pudiera hacerse, incluso, el análisis gestual, el cotejo de sus lenguajes corporales, pero atengámonos al contenido de sus discursos. Veamos primero las pontificales declaraciones de Estévez.

El representante de Súmate (según registra El Universal) declaró que «no se han (sic) asegurado ninguna de las condiciones indispensables» para una elección presidencial transparente y confiable el próximo 3 de diciembre. Al aclarar que Súmate sólo exigía el cumplimiento de la ley, acusó al organismo electoral de no haber «comunicado al país que realmente está pensando en cumplir la ley de cara a este proceso electoral». Una revisión de la legislación electoral, sin embargo, no consigue ningún artículo en el que se prescriba que el Consejo Nacional Electoral deba «comunicar al país» que realmente piensa cumplir la ley. (Más allá de los juramentos de ley que cada funcionario hace al asumir su cargo). Si a ver vamos, la Alcaldía de Chacao tampoco ha comunicado tal cosa a los habitantes de ese municipio.

La implicación oculta, por supuesto, es que si el organismo electoral no comunica al país que «realmente está pensando en cumplir la ley» es porque realmente no está pensando en cumplir la ley. Estévez pudiera pasearse por el siguiente hecho: Súmate tampoco ha comunicado al país que realmente esté pensando en cumplir la ley «de cara a este proceso electoral».

Luego Estévez propuso—en nombre de Súmate, naturalmente, aunque Estévez no certificó que la ONG esté pensando realmente en eso—la creación de un «comité de seguimiento técnico» conformado «realmente—éste debe ser el adverbio favorito de Estévez—de manera plural, es decir, tanto por organizaciones asociadas al oficialismo como a la oposición». Y entonces dice: «Hasta ahora lo que hemos visto por parte del CNE es que no tiene la más mínima intención siquiera de conformar ese comité», no sin agregar que Súmate «sólo participaría si se garantiza una conformación balanceada con los distintos actores».

Un nuevo examen de las leyes y disposiciones electorales del país no consigue, de nuevo, la estipulación de un tal «comité de seguimiento técnico», por lo que la acusación se reduce a criticar al CNE por no tener «la más mínima intención» de constituir algo que no está contemplado en la ley. (Que es lo que supuestamente Súmate «exige»). Es, por otra parte, difícil de entender cómo alguien puede ser responsable de no tener la más mínima intención, «hasta ahora», de hacer algo antes de que sea propuesto. (De paso, Estévez da por sentado que si el tal «comité de seguimiento técnico», no contemplado en la ley, es finalmente creado, entonces Súmate debe ser invitada a conformarlo y de una vez regaña y advierte que no participará sino en tales o cuales condiciones).

Más adelante, para abonar a su tesis de que «ninguna» de las condiciones esenciales a un proceso electoral confiable están dadas, Estévez cuestionó la auditoría practicada al Registro Electoral en los siguientes términos: «Ocurrió lo que habíamos alertado desde un principio, que ese estudio es tan superficial que simplemente no responde lo que todos los venezolanos nos estamos preguntando, que es si los electores que están en el RE realmente existen». (Esto a pesar de que El Universal reporta: «Aclaró que conocieron los resultados de la investigación a través de la presentación del informe hecho público la semana pasada, si bien aún no han podido revisarlo en detalle»).

Apartando el hecho de que nadie puede afirmar seria y responsablemente qué es «lo que todos los venezolanos nos estamos preguntando», Estévez deja de mencionar los resultados de la opinión conjunta de la Universidad Central de Venezuela, la Universidad Simón Bolívar y la Universidad Católica Andrés Bello, reportada acá el 20 de julio en el #195 de la Carta Semanal de doctorpolítico: «La discrepancia entre valores observados y esperados permite inferir que una importante proporción de los datos de los electores contenidos en el RE tiene errores al menos desde 1998… Las estructuras por edad del RE y Proyecciones de Población, tanto a nivel nacional como por entidad federal, son consistentes… Se hicieron pruebas de consistencia de las estructuras de esas dos poblaciones aun corrigiendo los problemas con los grupos extremos y los resultados mejoran, no obstante que la significación de las pruebas con los datos sin corregir ya era bastante aceptable… No se observaron evidencias de que exista correlación entre errores y preferencias políticas en eventos comiciales nacionales… Los resultados sugieren que los errores no parecen estar relacionados con la intención del voto en un evento comicial presidencial», etcétera. (Destacado nuestro).

Pero Estévez, aunque «no ha podido revisarlo en detalle», sugiere que pudieran no existir los electores que están en el registro electoral. (Por mi parte, puedo certificar que me encuentro debidamente anotado en ese registro, y que he practicado reiteradamente el cartesiano cogito ergo sum, estableciendo que sí existo. Es de suponer que Estévez está en la misma condición, pues en caso contrario ya lo habría dicho: él, Alejandro Plaz, María Corina Machado, aparecen en el registro y también existen y votan, a juzgar por hechos públicos, notorios y comunicacionales). Mantenida la ubicación correcta de la carga de la prueba, no es que el CNE debe demostrar que 17 millones de electores inscritos en el RE existen en realidad, sino que Estévez o Súmate tendrían que demostrar que ciertos electores registrados realmente no existen. (Y según la peculiar construcción de Estévez debieran demostrar la inexistencia de 17 millones de personas).

Pero todavía añade Estévez, según reporta El Universal: «Asimismo, dijo que aunque el conteo total de las boletas de votación está garantizado en la Ley Orgánica del Sufragio y Participación Política, el CNE no se ha pronunciado sobre esa materia». Acá Estévez parece sugerir que el CNE planea no realizar el conteo total de las boletas, pero en realidad lo que insinúa es que este conteo debe hacerse manualmente, o que la ley exige que se abra la totalidad de las cajas con tales boletas para cotejarlas con las actas de votación.

En ninguna parte dice la ley tal cosa. El Artículo 154 de la Ley Orgánica del Sufragio y Participación Política dice: «El proceso de votación, escrutinio, totalización y adjudicación será totalmente automatizado». (Establece un proceso manual para aquellos casos en los que tal automatización no sea posible «por razones de transporte, seguridad, infraestructura de servicios». Es por tal cosa que Acción Democrática prometió, a comienzos de año, que introduciría, «por iniciativa popular», un proyecto de reforma de la Ley Orgánica del Sufragio y Participación Política, el que por cierto tendría que ser discutido por una Asamblea Nacional que AD—que no ha introducido el tal proyecto—considera deslegitimada).

También, por supuesto, hizo Estévez una referencia a la auditoría de la elección. Dice El Universal: «Sobre las auditorías, el directivo de Súmate dijo que aunque se ha hablado del porcentaje de votos que será auditado no se ha precisado cómo se realizará. ‘Lo más importante de la auditoría en caliente es saber qué se va a hacer con los resultados de esa auditoría. Si los resultados de la auditoría son distintos a los resultados emitidos por la máquina de votación, ¿qué va a pasar con los resultados reales?’, explicó».

Ya que Súmate-Estévez (no confundir con Sumito Estévez) exige al CNE el cumplimiento de la ley, he aquí lo que dice la ley sobre el punto (Artículo 168): «El proceso de escrutinio será mecanizado… Cualquiera sea el sistema de escrutinio mecanizado que se adopte, el mismo deberá ser auditable». No se encuentra en la ley especificación alguna acerca de la temperatura de auditorías, y por lo que respecta a lo que va a pasar «con los resultados reales», la ley tiene amplias y expresas disposiciones relativas al procesamiento de impugnaciones de los actos electorales. Estévez pudiera contestarse a sí mismo su pregunta leyéndola, sin necesidad de convocar a rueda de prensa para decir tantas pistoladas juntas. Que cumplen el propósito, naturalmente, de remachar la matriz de opinión que procura establecer: que las elecciones de diciembre serían inválidas, con la esperanza de extraer de tal cosa una «crisis de gobernabilidad».

El punto final de su intervención, según registran los medios, fue una cuña publicitaria de su organización: «Además, Estevez informó que están dispuestos a asesorar técnicamente a Manuel Rosales, como a cualquier otro candidato que lo requiera, sin perder su independencia». (El Universal). «Súmate declaró que mantiene su independencia e interactuará (con) los candidatos, brindará asesoría y dará recomendaciones al candidato Manuel Rosales sobre las condiciones, así como cualquier otro aspirante, incluso al chavismo». (Globovisión).

Claro, Súmate se encuentra técnica y formalmente desempleada. Reducida a la condición de buhonera una vez que fracasara estrepitosamente en su proyecto de elecciones primarias, paga ahora avisos para asegurar que «construye democracia» y se ofrece como consultora. Técnica, of course.

………

Del otro lado del mismo caño también hay caimanes, y uno en particular es hembra. La Gran Caimana Tibisay Lucena ha terciado en el debate sobre el empleo de las benditas máquinas captahuellas. («Cazahuellas», de acuerdo con otra terminología). Saliendo al paso de observaciones muy pertinentes del rector Vicente Díaz, Lucena ha declarado: «Es imposible que los electores declinen emplear las captahuellas. Está establecido en la ley. Incluso en la norma constitucional que señala que uno de los principios fundamentales del Poder Electoral es la celeridad del voto y de una vez abre el desarrollo que luego se hace en la Ley Orgánica del Poder Electoral e incluso en la Ley Orgánica del Sufragio y de Participación Política, donde todos los procesos electorales son automatizados en cada una de sus fases». (El Universal).

La rectora-caimana-presidenta está peladísima. Es verdad que, como se ha apuntado, «El proceso de votación, escrutinio, totalización y adjudicación será totalmente automatizado». Pero exactamente la misma ley que prescribe tal cosa establece explícita y específicamente un procedimiento para la debida identificación de los electores a la hora de votar. Dice así el Artículo 159 de la Ley Orgánica del Sufragio y Participación Política: «El Consejo Nacional Electoral definirá el procedimiento del acto de votación, el cual tomará parte del Reglamento General Electoral, y estará enmarcado en los siguientes principios: 1. Se dejará constancia de la identidad de los electores que se presenten a votar en el Cuaderno de Votación, mediante la impresión de su huella dactilar y su firma, la cual se comparará con la firma impresa en la Cédula de Identidad, a menos que exista alguna imposibilidad física o intelectual, de su parte, para dar cumplimiento a esta norma, con antelación a su votación».

Esto es, lo que la ley exige—la misma que establece la automatización—es que los ciudadanos impriman su huella dactilar en el cuaderno de votación; en ningún caso establece que tal huella deba ser examinada por ninguna máquina. Así que perfectamente los ciudadanos podemos negarnos a registrar nuestra huella por cualquier medio distinto del mero cuaderno de votación.

Por lo que respecta a la Ley Orgánica del Poder Electoral, en ella no se encontrará por ninguna parte la palabra «huella». Existe sí, una mención a la cédula de identidad de los electores cuando describe las funciones de la Oficina Nacional de Supervisión del Registro Civil—que estará dirigida, en redacción perogrullesca, por un Director o Directora. (De libre nombramiento y remoción)—y que deberá (Artículo 63): «4. Supervisar y fiscalizar el proceso de tramitación y expedición de las cédulas de identidad y pasaportes, vigilando que se cumpla correcta y oportunamente». Más nada.

En el país de Tascón, con un sistema que—según comprobó Leopoldo González, del mismo Grupo La Colina al que pertenece Vicente Díaz, en Fila De Mariches—es capaz de guardar en sus bancos de memoria la secuencia de la votación, en procesos electorales en los que la diputada Iris Varela se da el lujo de amenazar a los empleados públicos que no vayan a votar sin que sea objeto de sanción alguna, la Presidenta del Consejo Nacional Electoral no puede ignorar el terrible efecto de distorsión que las máquinas captahuellas introducen. Mucho menos puede alegar deshonestamente que las mismas están prescritas por la ley.

En resumen, lo aducido por Estévez y Lucena sólo se explica a partir de dos hipótesis alternas: que son intelectualmente deshonestos y manipulan a conciencia, o que, simplemente, son muy brutos.

LEA

por Luis Enrique Alcalá | Ago 16, 2006 | Historia, Otros temas |

Introducción a vuelo de pájaro a la historia del siglo XX. La mise en scène: la Guerra Franco-Prusiana y la Belle Époque. La era de Bismarck. Irrupción del existencialismo: de Søren Kierkegaard a Friedrich Nietzsche.

La cosmología más reciente ha requerido postular, en explicación del universo observable, que hubo una época “inflacionaria” de la expansión original: una fase en la que la dispersión de la materia alejándose de sí misma procedió mucho más rápidamente que lo previsto por la ley de Hubble.[1] El siglo XX inició, en el mismo sentido, una época inflacionaria de la humanidad. Todo se hizo mucho más veloz: el crecimiento de la población, el del desarrollo tecnológico, el del traslado por tierra, mar y aire, el de los artículos de consumo y el de sus costos y sus precios, el del conocimiento científico, el del gasto energético, el de la contaminación ambiental y el de la posibilidad de autodestruirnos. Todo fue, a ritmo febril sin precedentes, más grande y numeroso, más rápido y potente: las guerras, las artes médicas, la capacidad terrorista, la internacionalización del comercio, la democratización al tiempo que la autocracia. El siglo XX fue, no cabe duda, un especialísimo punto de inflexión en la curva de la historia.

Los actores en el escenario del planeta, sea que se trate de protagonistas o de extras, somos muchísimos más que los que había en 1900. En los momentos somos unos 6.600 millones de pasajeros de la nave Tierra, cuando a comienzos de siglo éramos unos 1.600 millones. Le tomó a la humanidad un millón y medio de años para llegar a este tamaño, y sólo cien para añadir 5.000 millones y cuadruplicarse. Este explosivo crecimiento, que aún no se ha detenido, se produjo sobre todo en las áreas más pobres.

El crecimiento de la población mundial

La explosión demográfica, por otra parte, coincidió con una equivalente del consumo energético. Primero el carbón, y luego muy principalmente el petróleo, alimentaron la expansión poblacional.

Crecimiento del consumo energético

Crecimiento por fuentes de energía

El incremento de una población, expresado por la tasa de crecimiento, es producto de la diferencia entre la tasa de natalidad y la de mortalidad. La tasa de natalidad, tomada para el conjunto del planeta, no varió demasiado durante el siglo XX—aunque sí en las últimas décadas de éste, decreciendo—pero lo que determinó la eclosión de los habitantes fue un marcado descenso de la tasa de mortalidad, a consecuencia de los adelantos sanitarios que permitieron grandes éxitos en el combate de las enfermedades de origen infeccioso. Los continuados avances de la tecnología médica, por otro lado, continúan aumentando la esperanza de vida al nacer.

Mecanismo de la explosión demográfica

Parece ser, sin embargo, que el crecimiento de la población de las especies, la humana incluida, describe una curva logística (en forma de S): de crecimiento muy lento al principio, es sucedida por una fase de crecimiento exponencial que culmina en un techo que nuevamente la nivela. Es así como se espera que esto ocurra también con la raza humana, y que con el descenso de la tasa de natalidad en dirección de niveles de mero reemplazo poblacional[2] se alcance una nivelación, que algunos estiman en 11.000 millones de personas. En todo caso, si algo puede caracterizar al siglo XX es el muy acelerado crecimiento de la población, la que como un supertanquero de gran masa, es preciso frenar con mucha anticipación para detenerla. Todavía quedan unos cuantos años de crecimiento, aun cuando la natalidad ya ha descendido.

La curva logística crece al comienzo a ritmo muy similar al de una curva exponencial

Pero hemos dicho que muchas otras cosas también crecieron a ritmo desenfrenado durante el siglo XX. En la Primera Guerra Mundial, por caso, tripulantes de los aeroplanos militares debían dejar caer de sus manos las escasas bombas que lanzaron, y hasta disparar a su inicio con revólveres, casi a boca de jarro, a los aviadores enemigos. En cambio, se estima hoy que el arsenal nuclear existente es aproximadamente igual al de la década de 1980, y los modelos meteorológicos muestran que la mitad de ese polvorín es capaz de causar un invierno artificial de proporciones cataclísmicas, al incluir la traslación, por inversión de los ciclos eólicos normales, de nubes de hollín y polvo que harían barrera a más del 90% de la radiación solar incidente (con lo que muy pronto la superficie terrestre descendería a temperaturas de subcongelación), y de nubes intensamente radiactivas.[3] El cálculo de bajas en una guerra de este tipo ha llegado a rendir cifras tan altas que sus gráficos requirieron la aséptica y desalmada nomenclatura de “megamuertes” (megadeaths, un millón de muertos) introducida por Hermann Kahn en su libro—con título que hacía eco de la clásica obra de Clausewitz—On Thermonuclear War. Esto ha traído el siglo XX.

Pero también creció en el vigésimo siglo cristiano la propia capacidad de cálculo, con el vertiginoso incremento del poder para computar. No hace mucho que los ingenieros sacaban sus cuentas sin más auxilio que el de una regla de cálculo, pues los primeros computadores electrónicos datan de la década de los 40, y hoy se calcula su capacidad en miles de millones de operaciones aritméticas por segundo.

En 1965 la revista Electronics Magazine publicaba un artículo de Gordon E. Moore,[4] en el que este ingeniero electrónico hacia la observación (y predicción) de que la densidad de transistores en los circuitos integrados—chips—respecto de su costo mínimo unitario se duplicaba cada dieciocho meses.

La ley de Moore

Por supuesto que los computadores pueden emplearse en menesteres militares, pero su uso civil es cada vez más extenso, y la aparición del computador “personal” (1976) ha significado una nueva explosión, esta vez en la demografía digital. Del crecimiento sosegado de la electrónica a comienzos de siglo,[5] se pasó en breve tiempo a una carrera tecnológica acelerada, y en general lo inventado en el siglo XX empequeñece en magnitud a la inventiva humana de un millón y medio de años de existencia. Cálculos similares al de Moore se predica para las más dinámicas entre las ciencias. Para la década de 1980 se estimaba que el conocimiento total en Biología se duplicaba en el espacio de dos años, y más rápidamente aún en campos novísimos como la ingeniería genética.

A este siglo XX tan denso en sufrimiento y avance, se llegó desde una puesta en escena en el XIX que es preciso refrescar. Comoquiera que la civilización occidental ha sido el asiento del mayor progreso y dominio, este recuento es casi exclusivamente de la historia europea. A ésta se le pronostica ya una declinación, como postula Arnold Toynbee en su Estudio de la historia[6] para toda civilización existente o por existir. (Las fases por las que atraviesa toda civilización serían, para Toynbee, las de génesis, crecimiento, tiempo problemático, estado universal y desintegración). Algunos autores, incluso, sostienen que ya esa erosión ha comenzado, y tienen al siglo XX por el crisol primigenio de un nuevo y más englobante proceso: la emergencia de una civilización planetaria o mundial, a partir de la fusión cultural entre Oriente y Occidente[7].

………

La mecha larga del conflictivo comienzo del siglo XX fue encendida en Alemania en la segunda mitad del siglo XIX. Este país, cuyo Primer Reich se convirtiera en Sacro Imperio Romano el día de Navidad del año 800, con la coronación de Carlomagno a manos del papa León III, era en 1850 un archipiélago de más de trescientos principados, cuya unificación pretendía ser liderada por los Habsburgo, la casa reinante de Austria, en un proyecto de la Gran Alemania. En lo que hoy conocemos como Alemania sólo había un estado con el músculo suficiente como para frustrar los deseos austriacos: el reino de Prusia. Napoleón había acabado formalmente la existencia de mil años del Sacro Imperio Romano, incorporando la ribera izquierda del Rin a Francia y organizando la Confederación del Rin bajo su dominación y empujando a Austria fuera del extenso territorio de la liga, que se extendía del Báltico a los Alpes. En esa reorganización Prusia había permanecido incólume, como estado buffer ante Rusia.

Varios factores impulsaban la aspiración de la unidad alemana. El Romanticismo, para empezar, que tuvo por pioneros a grandes escritores alemanes—Goethe el cimero—fue un acicate para el espíritu nacionalista. Las ideas del liberalismo también hicieron lo suyo: la burguesía alemano-occidental aspiraba a un gobierno constitucional y políticas económicas que le fueran favorables, y como el estado de cosas no las proveía, deseaba un estado nacional unificado que las concediera. Luego, a la caída de Napoleón fue posible establecer, gradualmente, el Zollverein o unión aduanera, primero en Prusia, luego con la adhesión de principados menores y, finalmente, con la de principados mayores de Alemania del sur. Para coronar este proceso de integración económica, a partir de 1830 se instaló en el país una red ferrocarrilera que a su vez impulsó el surgimiento de industrias y, sobre todo, bancos que operaban más allá de las ciudades donde se fundaban.

Así las cosas, hubo tempranos intentos de unificación. Prusia logró un éxito parcial en 1850, cuando en Erfurt se aprobó una constitución para una Kleindeutsch o pequeña Alemania, que excluía a Austria, bajo presidencia prusiana. Pero esta iniciativa contó de inmediato con la oposición de Austria, que procedió a restaurar la Dieta de la vieja Confederación Germánica. La guerra entre Prusia y Austria pudo ser impedida por la constelación de fuerzas favorables a Austria: los estados alemanes del sur preferían la confederación laxa propuesta por los austriacos y Rusia se mostró inclinada a terciar a favor de estos últimos. En noviembre de 1850 los prusianos encajaron la “humillación de Olmütz”, donde debieron aceptar la disolución la Unión de Erfurt y la presidencia de Austria en la reestablecida Confederación Germánica.

En 1861 subió al trono[8] Guillermo I de Prusia, bajo quien se intentó la modernización del ejército, comandado por los generales von Roon y von Moltke. Esta pretensión fue opuesta por los diputados liberales al Landtag (cámara baja) con temores de que el ejército se convirtiese en fuerza represiva, y éstos bloquearon por más de dos años la aprobación de los créditos necesarios. A punto de abdicación en 1862, Guillermo I siguió el consejo de von Roon y llamó al gobierno a Otto von Bismarck.

Bismarck pertenecía a la clase terrateniente aristocrática, los Junker, que proveían la mayor parte de los oficiales del ejército y también los principales funcionarios de la administración. Había sido representante de Prusia ante la Dieta de la Confederación Germánica por nueve años (1851-1859), y en ella pudo calibrar a los diplomáticos austriacos y confirmar la baja opinión que tenía de la práctica parlamentaria, adquirida en la asamblea de Frankfurt en 1848, el año de revoluciones en Europa. Luego fue embajador en Rusia (1859) y en Francia (1862), de donde fue llamado para encargarse del gobierno prusiano en calidad de Ministro Presidente.

Fue Bismarck, de tendencia claramente conservadora, el exponente epónimo de la Realpolitik, o política de poder. A un comité de la Dieta de Prusia dijo en una ocasión: “Las grandes cuestiones del día no se decidirán con discursos y votos de mayoría—eso fue el error de 1848 y 1849—sino con sangre y con hierro”. Así se bautizaba él mismo, pues mucho antes de que Margaret Thatcher fuese tenida como “la Dama de Hierro”, ya Bismarck había pasado a la historia como “el Canciller de Hierro”. Cuando esa misma Dieta se rehusó de nuevo a la aprobación de los créditos para el ejército, un recién estrenado Bismarck simplemente la ignoró: sin el menor miramiento cobró los impuestos y los gastó en la modernización de sus fuerzas armadas.

Los objetivos de Bismarck no eran, al menos al comienzo, los de un pangermanista, sino los de un prusiano que quería maximizar el poder y la reputación de Prusia. Era para esto que buscaba ganar el apoyo de los restantes estados alemanes mientras disminuía la influencia de Austria, aunque para esto tuviera que alentar a quienes querían una Alemania unida. En cuidadosa preparación, buscó la pelea con Austria y la ganó, aprovechándose de “la cuestión danesa”.

Los ducados de Schleswig y Holstein eran propiedad personal hereditaria del rey de Dinamarca, pero su población era mayoritariamente alemana y, de hecho, Holstein era miembro de la Confederación Germánica. La corona danesa quiso incorporar definitivamente a Schleswig e imponer una constitución en Holstein, intenciones que reavivaron el sentimiento nacionalista alemán. Bismarck no tardó en aprovechar esta reacción, y persuadió a los austriacos a que le acompañaran en una guerra contra Dinamarca. La derrota total de esta última dio aliento a tres objetivos de Bismarck: aumentó su prestigio con los nacionalistas alemanes, demostró la eficiencia de sus tropas con un bautismo de fuego y estableció las bases para una próxima y más estratégica guerra contra Austria. En efecto, Dinamarca tuvo que ceder tanto Schleswig como Holstein a la pareja vencedora, adjudicando el primero de los ducados a Prusia y el segundo a Austria. Aunque, en teoría, la soberanía sería ejercida conjuntamente, en la práctica Prusia ocupaba y administraba Schleswig y Austria debía hacer lo propio con Holstein. Pero este último ducado estaba enclavado en territorio prusiano, y Viena estaba demasiado lejos. Después de prepararse de nuevo cuidadosamente en el terreno diplomático—se amistó con Rusia apoyándola en la supresión de la rebelión polaca de 1863, insinuó a Francia ganancia territorial en la Renania tras una guerra alemano-prusiana que ganara Prusia y concluyó una alianza con Italia, a la que prometió Venecia—penetró en Holstein con su ejército.

Como es natural, Austria mordió el anzuelo, y persuadió a la Dieta de la Confederación Germánica para que declarara a Prusia un agresor. Bismarck denunció entonces que se había violado la constitución federal y declaró muerta a la Confederación. Aunque la mayoría de los estados alemanes se alineó con Austria, y esta alianza hacía esperar la derrota de Prusia, la preparación de esta última se impuso en una guerra de siete semanas, para sorpresa de toda Europa. El ejército prusiano fue desplegado con rapidez y penetración con un uso inteligente de las líneas ferroviarias, y su empleo de fusiles de cerrojo, de carga mucho más rápida que los mosquetes austriacos que debían ser alimentados por la boca, determinó una ventaja tecnológica y táctica que fue decisiva. Después de arrollar a Hanover y volverse sobre los estados alemanes del sur, la acción definitiva, un enfrentamiento directo de Austria y Prusia, tuvo lugar en Bohemia, donde la batalla de Königgrätz (3 de julio de 1866) resultó en una victoria aplastante de Prusia.

Bismarck coronó el esfuerzo con un golpe diplomático maestro: se opuso a los deseos de Guillermo I y su propio estado mayor, que querían llevar el avance hasta la capital imperial de Viena, y compuso un rápido armisticio de trato condescendiente hacia Austria, para no añadir vinagre a la herida y prevenir una intervención de Francia, que sorprendida por la celeridad de una guerra que estimó prolongada había procurado entrometerse en plan de mediador. Austria tuvo que ceder Venecia a Italia que, como sería su costumbre en las guerras del siglo XX, había sido derrotada en el terreno y sin embargó se alzó con su premio. Ningún otro sacrificio territorial se impuso a los austriacos, aunque sí debió pagar una indemnización. Prusia, por su parte, y además de Schleswig y Holstein, incorporó a sus dominios a Hanover, Hesse-Cassel, Nassau y Frankfurt. En adición contó con mano libre para reorganizar a su antojo el resto de los estados alemanes del norte. En premio a la hazaña, la Dieta de Prusia votó entusiastamente a favor de los créditos que antes había negado, en medio de un furor de nacionalismo resurrecto.

La triunfante campaña de Prusia contra Austria, sin embargo, dejó un asunto pendiente. Luego de completar la reunificación al norte de Alemania, los estados alemanes del sur se vieron forzados a una alianza con Prusia, la que aceptaron a regañadientes sólo porque Austria ya no podría defenderles. El catolicismo sureño[9] resentía el protestantismo prusiano, y la única protección a la que podría aspirar era la de Francia. Bismarck entendió que tendría que ganarle una guerra a Napoleón III.

Como siempre metódico, Bismarck dispuso primeramente el terreno diplomático. Luis Napoleón también veía una guerra contra Prusia como inevitable, pero su intento de establecer alianzas que lo fortalecieran no tuvo éxito. Austria, derrotada, no podía pelear de nuevo tan pronto, y los húngaros, que ahora tenían status equivalente en la “Monarquía Dual” (Austria-Hungría), no querían saber nada del asunto. Los designios de Francia, que buscaba compensarse mediante la anexión de Bélgica y Luxemburgo, aseguraron la antipatía de Inglaterra contra ella cuando Bismarck se apresuró a advertir a los ingleses de las intenciones francesas. Italia estaba agradecida a Prusia, y ésta aseguró el beneplácito de Rusia en la eventualidad de una guerra con Francia.

Sólo faltaba un pretexto. El trono español estaba vacante, y había sido ofrecido al príncipe Leopoldo de Hohenzollern-Sigmaringen, pariente de Guillermo I de Prusia. El monarca alemán aconsejó a su familiar que rehusara la oferta, precisamente para no herir la susceptibilidad de Napoleón III. Pero en la primavera de 1870 Bismarck maniobró para que el ofrecimiento fuese renovado. Un nuevo e inexperto gabinete francés interpretó el asunto como insulto, y exigió que Guillermo I se excusara formalmente en representación del embajador francés, que fue hasta Ems, donde el monarca alemán descansaba, para entregar la solicitud. Guillermo se rehusó cortés pero firmemente y telegrafió a Bismarck para explicar los pormenores. El maestro de la Realpolitik editó el telegrama para que sonara como nueva injuria a los franceses y lo filtró a la prensa.

La reacción no se hizo esperar. Reaccionando a la afrenta del “despacho de Ems”, el emperador francés declaró la guerra a Prusia el 19 de julio de 1870. De inmediato Francia fue invadida por tres ejércitos alemanes que llegaron rápidamente tras las líneas francesas. Sitiaron un gran ejército francés en la fortaleza de Metz y rodearon otro en Sedán, conducido por el mismo Napoleón cerca de la frontera belga. Después de aguantar dos días de bombardeo inmisericorde, el segundo emperador de los franceses capituló con cien mil hombres el 2 de septiembre de 1870. La derrota significó la abdicación de Napoleón III y la proclamación de la Tercera República en Francia, que prolongó una lucha inútil por unas semanas más.

En mayo de 1871 el Tratado de Frankfurt arrancaba Alsacia y una parte de Lorena a Francia, e imponía a este país el pago de indemnizaciones de guerra y la humillación de una ocupación, sufragada por los vencidos, hasta tanto la obligación fuera saldada. En injuria adicional, Bismarck arregló la proclamación de Guillermo I como emperador alemán en el Salón de los Espejos del Palacio de Versalles, a escasos kilómetros de París. Había nacido el Segundo Reich, y de allí en adelante Bismarck, que había provocado tres guerras para conseguirlo, se consagró durante casi veinte años más a preservar la paz en Europa. Le bastaba aplicar su regla de oro: en una Europa de cinco potencias—Austria, Rusia, Francia, Inglaterra y Alemania; para fines prácticos Italia no contaba—había que estar à trois, es decir, acompañado de dos aliados.

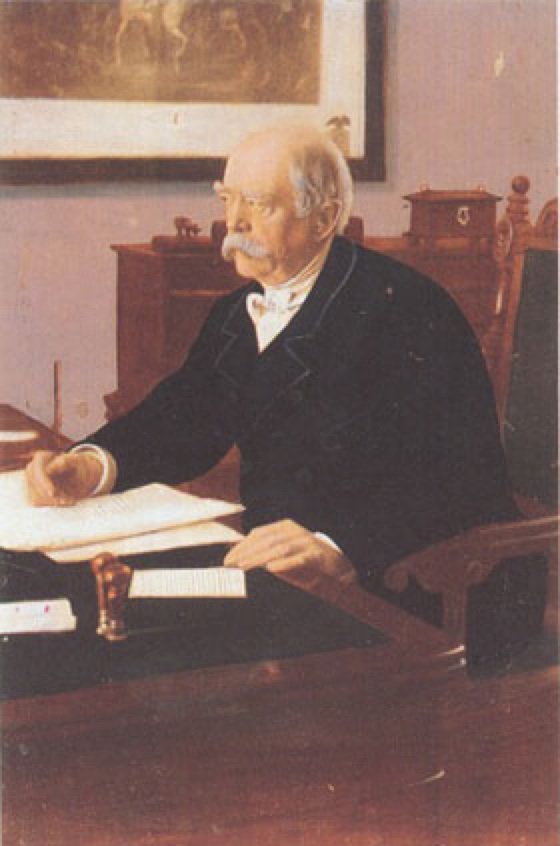

Otto von Bismarck en su despacho en 1866, el año de la guerra entre Austria y Prusia